Ist dieses Bild echt oder nicht? Forensische Methoden zur Fake-Erkennung

Wie erkennt man KI-generierte Bilder? Diese Frage treibt nicht nur mich, sondern auch einige meiner Kolleginnen und Kollegen um. Neulich wurde ich gefragt, was ich vom Image Verification Assistant von Mever halten würde. Meine ehrliche Antwort: Erst einmal nichts, da ich das nicht kannte.

Ich machte mich jedoch sogleich schlau: Mever steht für Media Analysis, Verification and Retrieval group und damit für eine Abteilung am Information Technologies Institute. Das wiederum ist eine 1998 gegründete gemeinnützige Organisation in Thessaloniki, die unter der Schirmherrschaft des Staates steht und sich mit Informatik, Telematik und Telekommunikation beschäftigt. Dessen Werkzeug wiederum wird im journalistischen Kontext zur Bildüberprüfung eingesetzt. Aber – und das wird schon auf den ersten Blick klar –, man darf von ihm keine simple Antwort im Stil von «Ja, dieses Bild ist KI-generiert» oder «Nein, dieses Bild ist authentisch» erwarten.

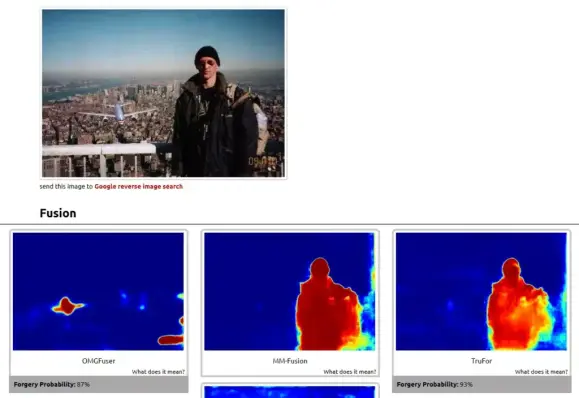

Stattdessen liefert es automatisiert die Resultate diverser Tests, die auf das fragliche Bild angewandt werden. Einige der Prüfungen mit den kombinierten Algorithmen weisen Fälschungswahrscheinlichkeit (Forgery Probability) in Form einer Prozentangabe aus, doch für die Interpretation sind wir auf uns selbst gestellt. Für sinnvolle Aussagen kommen wir nicht darum herum, uns mit den Testverfahren auseinanderzusetzen.

Eine bekannte Bildfälschung eines Mannes, der angeblich bei 9/11 auf einem der Twin Towers stand – hier eindeutig als falsch erkannt.

Das werde ich gleich ausführlich tun. Doch zuvor folgt hier – für die Ungeduldigen unter meinen Leserinnen – mein vorläufiges Fazit:

Der Image Verification Assistant ist ein Werkzeug, das unbedingt ein Lesezeichen wert ist. Es liefert uns Indizien, die uns helfen, die Glaubwürdigkeit eines Bildes zu beurteilen. Diese Indizien können deutlich ausfallen oder vage sein. Ein klares Resultat ist zu erwarten, wenn Material manipuliert wurde, das bereits im komprimierten JPEG-Format in den sozialen Medien kursierte und bei dem bestimmte Partien verändert oder ausgetauscht wurden. Deutlich weniger effektiv ist die Methode, wenn die Änderungen an unkomprimiertem Bildmaterial ausgeführt wurden: Manipulationen an RAW-Aufnahmen dürften sich kaum feststellen lassen. Hier würde höchstens die Noiseprint-Analyse einen subtilen Hinweis liefern können.

Auf den journalistischen Alltag bezogen, dürfte das selten zum Problem werden. Die routinemässig zu prüfenden Bilder weisen keine Manipulationen auf höchstem Niveau auf. Sie werden mit dem Material ausgeführt, das greifbar ist – und das sind JPEG-Dateien aus dem Web und den sozialen Medien.

Wie aus ersten Indizien ein echter Verdachtsfall wird

Wie ich bei meinen Tests (weiter unten) nachweise, schlagen die Algorithmen auch bei harmlosen Motiven an. Das führt uns zur wichtigen Einsicht, dass die forensische Beurteilung nicht bloss anhand der Tests erfolgen kann. Ein Verdachtsfall ergibt sich, wenn mehrere Befunde zusammenkommen:

Einer der Algorithmen meldet eine hohe Wahrscheinlichkeit für eine Manipulation.Dieser Befund wird durch die gesamte forensische Analyse gestützt.Der Befund erscheint in der menschlichen Begutachtung plausibel, insbesondere, weil wir uns einen Reim darauf machen könnten, was das Motiv hinter einer Fälschung sein könnte. Sprich: Die Algorithmen zeigen die Manipulation für einen massgeblichen Bildbereich an: für eine Person, einen bestimmten Vorgang, ein Symbol oder sonst ein aussagekräftiges Bildelement.Der Abschluss sollte die visuelle Beurteilung bilden: Realweltliche Unstimmigkeiten sind deutlichere Hinweise auf eine Fälschung als die Werte einer technischen Analyse.Was nun die Entdeckung von KI-Deepfakes angeht, eignet sich der Image Verification Assistant nur bedingt. KI-Bilder entstehen wie echte Fotos aus einem Guss; sie werden nicht nach dem klassischen Splicing zusammengebaut. Meistens werden sie nicht im JPEG-Format ausgeliefert, sondern unkomprimiert als PNG: Es gibt daher keine Artefakte, die überprüft werden könnten. Vielleicht könnte wiederum das Noiseprinting herangezogen werden, weil bei einer KI-generierten Aufnahme das Muster fehlt, das für einen echten Fotosensor typisch ist. Diese Bilder sind gewissermassen zu glatt.

Auch KI-Generatoren hinterlassen verräterische Spuren

Allerdings hinterlassen auch generative Bilderzeugungsmodelle gewisse «mikroskopische» Muster, die eine Identifizierung ermöglichen. Man spricht von GAN-Fingerprints, die sich aber von klassischem Bildrauschen unterscheiden. Diese werden von spezialisierten Detektoren wie der hier vorgestellten Sight Engine benutzt. Das erlaubt es, sogar das verwendete Modell mit einer gewissen Sicherheit zu benennen.

Es gibt dennoch gewisse Überschneidungen bei den Methoden, die in einem Hybrid-Ansatz genutzt werden könnten: Ich denke an logische Inkonsistenzen, die sowohl bei KI-Bildern als auch bei herkömmlichen Bildfälschungen auftreten: In beiden Fällen kann ein unplausibler Schattenverlauf ein Warnsignal sein: Wenn bei einer Bildfälschung in Photoshop insbesondere ein Gesicht ausgetauscht wurde, kommt es oft vor, dass der Lichteinfall nicht übereinstimmt und die Schatten auf Nase, Hals und Stirn nicht der Umgebung entsprechen. Auch bei KI-generierten Bildern sind die Lichtbedingungen oft nicht konsistent.

Das festgehalten, geht es wie angedroht ans Eingemachte: Wir tauchen ab in die schöne Welt der verlustbehafteten Bildkompression, die abgesehen vom «Noiseprinting» entscheidend ist für die forensischen Analysen. Als Nichtmathematiker stosse ich beim Verständnis relativ schnell an Grenzen. Doch auch für Laien wird klar, wie raffiniert diese Methoden sind. Sie reduzieren die Datenmengen digitaler Bilder so beträchtlich, dass an Übertragungen via Internet zu Zeiten des Analogmodems überhaupt zu denken war. Gleichzeitig sind sie der Dreh- und Angelpunkt für die Erkennung von Bildmanipulationen. Denn die Kompression hinterlässt in der Bilddatei eine Spur, die über die ganze Fläche identisch sein muss. Falls sie es nicht ist, deutet das auf eine Bearbeitung oder auf die Verwendung von Bildmaterial aus verschiedenen Quellen hin.

Die technischen Methoden zur Entlarvung von Bildfälschern

Das sind einige der Methoden, die beim Image Verification Assistant zum Zug kommen:

Die Error Level Analysis (ELA) macht unterschiedliche Kompressionsraten innerhalb eines Bildes sichtbar. Eine Eigenschaft des JPG-Formats ist die verlustbehaftete Bildverkleinerung, die je nach Kompressionsrate unterschiedlich ausfallen kann. Bei Bildmanipulationen wird typischerweise Material aus unterschiedlichen Quellen kombiniert. Wenn solche Unterschiede sichtbar gemacht werden können, ist das ein deutlicher Hinweis auf eine Manipulation.

Ähnlich funktioniert die Erkennung der JPEG Ghosts (GHOST). Auch sie setzt auf die Erkennung von Partien im Bild mit unterschiedlichen Kompressionsgraden (Qualitätsstufen). Dabei wird das Bild mehrfach in unterschiedlichen Stufen komprimiert, wodurch die Unterschiede bei ursprünglichen Qualitätsstufen als eine Art Geist sichtbar werden.

Die Methode des Noiseprint & PRNU setzt beim Kamerasensor an. Sie liefern herstellungsbedingt kleine Unregelmässigkeiten, die für uns Menschen unsichtbares, sehr dezentes Bildrauschen sorgen (PRNU steht für Photo Response Non-Uniformity). Dieses lässt sich sichtbar machen und müsste über das ganze Bild hinweg einheitlich sein. Grössere Unterschiede deuten wiederum darauf hin, dass die entsprechenden Partien aus einer anderen Quelle stammen oder aber durch Bildbearbeitungsmethoden so stark verändert wurden, dass das ursprüngliche Sensorrauschen verloren ging.

Die Double Quantization (DQ) / JPEG Blocking setzt beim JPEG-Format und der Tatsache an, dass für die Kompression Bilder in Blöcke von 8×8 Pixel zerlegt werden, die über die Quantisierungstabelle eingedampft werden. Durch lokale Bearbeitungen können an diesen Blöcken Veränderungen auftreten, die bei einem integral gespeicherten Bild nicht zu erwarten wären. Daraus lässt sich entsprechend eine Manipulation ableiten.

Die CMFD-Methode (Copy-Move Forgery Detection) sucht nach mehrfach vorhandenen Bildbereichen innerhalb eines Bildes. Die weisen auf eine beliebte Bildbearbeitungsmethode hin: Mit dem Stempelwerkzeug oder einem anderen Tool werden unerwünschte Elemente zum Verschwinden gebracht, indem man sie mit harmlosen Partien aus der gleichen Aufnahme überdeckt.

Ich habe den Image Verification Assistant auf einige meiner schon häufiger benutzten Bilder angesetzt, mit folgenden Ergebnissen:

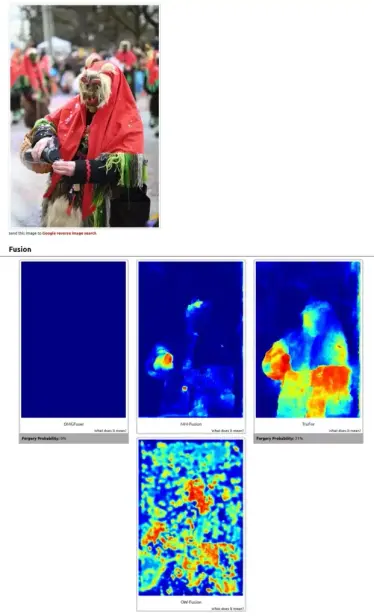

1) Ein unbearbeitetes Fasnachtsfoto direkt aus meiner Kamera

Zu erwarten wäre ein komplett unauffälliges Resultat. Das ist nicht der Fall. Einige der Tests schlagen an, u. a. der Noiseprint-Algorithmus. Im Bereich Fusion, wo mehrere der Resultate kombiniert werden, gibt der Trufor-Algorithmus eine Fälschungswahrscheinlichkeit von 21 Prozent an. Das ist erstaunlich hoch und zeigt, dass authentische Aufnahmen nicht vor verdächtigen Mustern gefeit sind.

Ein echtes, unbearbeitetes Foto liefert einige Verdachtsmomente.

2) Eine KI-generierte Illustration

Die Testresultate für diese von Dall-e erzeugte Grafik ergeben kein klares Bild, was manipuliert sein könnte. Der Trufor-Wert weist immerhin eine Fälschungswahrscheinlichkeit von 56 Prozent auf. Ein Test mit einem dedizierten KI-Detektor ergibt hingegen das klare Resultat: «Likely AI generated».

Die Algorithmen sind nicht auf diese KI-Illustration ausgelegt.

3) Das echte Foto eines KI-Plakats

Ein Agenturfoto des KI-generierten Werbeplakats der FDP zeigte schon früher die Grenzen der technischen Mittel bei der Fake-Erkennung auf: Das Bild selbst ist authentisch, auch wenn es das abfotografierte Motiv nicht ist. Das Resultat von Image Verification Assistant ist unauffällig; Trufor gibt eine Fälschungswahrscheinlichkeit von zwölf Prozent aus, OMGFuser meldet 16 Prozent.

Bei diesem Motiv liefert die Prüfung einen uneinheitlichen Befund.

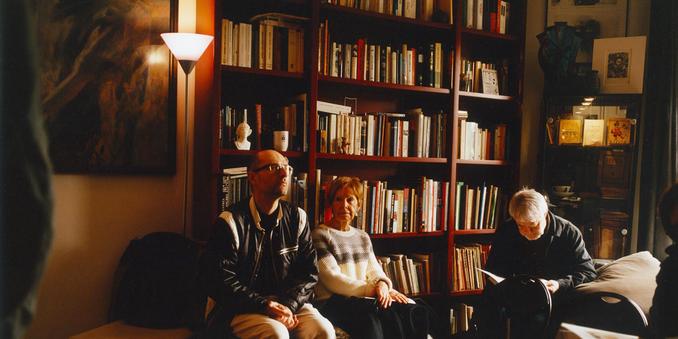

4) Ein kostenloses Stockfoto-Bild

Das fragliche Bild (hier als Beitragsbild verwendet) hat einen gewissen Kitschfaktor, wie ihn Bildgeneratoren mögen. Sie stammt jedoch von 2018, als die Bildgeneratoren noch nicht existierten. Image Verification Assistant unterstellt ihm eine hohe Fälschungswahrscheinlichkeit: 23 Prozent gemäss Trufor-Algorithmus und sogar 64 Prozent beim OMGFuser-Modul. Letzteres schlägt bei der Sitzbank an; die sieht für den Algorithmus höchst verdächtig aus.

Die Algorithmen stören sich an der Sitzbank – die aufs menschliche Auge harmlos wirkt.

Für mein Auge als menschlicher Betrachter ist dieser Befund nicht nachzuvollziehen. Die Aufnahme wurde sicherlich bei Belichtung und Farbe kräftig nachbearbeitet, aber eine weitergehende Manipulation ist nicht zu erkennen. Natürlich ist es nicht auszuschliessen, dass der Urheber an der Bank herumgedoktert hat. Vielleicht erschien ihm deren Farbe nicht passend fürs Gesamtbild, oder sie war in Wirklichkeit aus Plastik und hätte die Stimmung komplett zerstört. Das wäre zwar bedauerlich, würde dem Zweck eines Symbolbilds ohne tiefere Botschaft jedoch keinen Abbruch tun.

Beitragsbild: Ein gesicherter Fingerabdruck. Auch für die digitale Spurensicherung spielt er eine entscheidende Rolle (Immo Wegmann, Unsplash-Lizenz).

#FakenewsDeepfakes #Longread