Обучение скрытых слоёв S–A–R перцептрона без вычисления градиентов. Часть 2

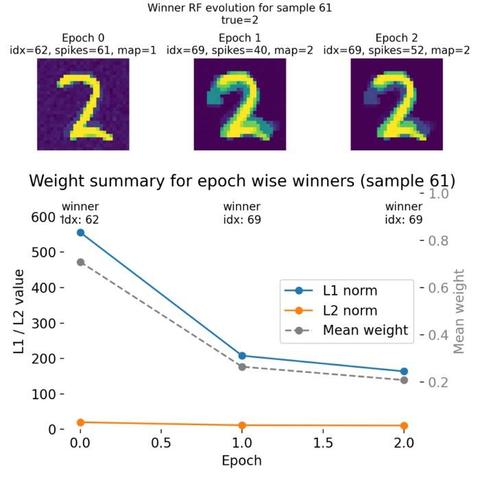

Предисловие. Опубликовав первую часть понял, что само обучение перцептрона мало кого интересует, пока не будет экспериментальных результатов. И это разрешило мою дилемму о том, как сократить изложение для хабра. Мы пропустим разделы с объяснением архитектуры перцептрона TL&NL и начнем сразу с 4 раздела моей статьи. 4. Точность прогнозирования В предыдущих разделах, мы стремились уменьшить число признаков (А - элементов), требуемых для решения задачи. И это понятно, т.к. обработка меньшего числа признаков требует меньше вычислительных затрат. Но выделяя только минимальное число признаков (и соответствующих A-элементов), и обучаясь только на части всех возможных примеров, мы рискуем построить слишком грубую модель. Её будет достаточно для решения задачи на обучающем множестве, но она будет плохо предсказывать. Представьте, что мы аппроксимируем окружность, и примеры нам показывают, что это многоугольник и во время прогнозирования мы исходим из того, на сколько углов мы обучили свою сеть. Поэтому, задача исследования в этом разделе состоит не в минимизации А-элементов, а в нахождении такого их количества, которое стабилизирует модель обобщения, которую строит перцептрон. Что означает стабилизация станет ясно из последующего изложения. Для анализа точности прогнозирования будем использовать классические тесты MNIST по распознаванию рукописных цифр и MNIST Fashion по распознаванию пиктографических изображений одежды. 4.1. О методологии экспериментов Отсутствие пред- и постобработки. Это не всегда очевидно, и различные исследователи часто явно или не явно используют некоторую предобработку обучающей и тестовой выборки. Мы должны строго разграничить обучающую выборку от тестовой, так, как например в результате некой нормализации происходит “подсказки от экспериментатора”, что не допустимо. Например, используя некие статистические характеристики и одинаково нормализуя обучающую и тестовую выборки происходит утечка информации, передача признаков тестовой выборки из обучающей выборки, или наоборот. По сути, это сводится к тому, что экспериментатор, зная тестовую выборку, косвенно подсказывает алгоритму, как ему обучаться. Поэтому важно, чтобы тестовая выборка была строго отделена от обучающей. Кроме того, мы хотим исследовать как именно работает алгоритм, а не то, как дополнительные манипуляции помогают решить задачу. Еще более важным, это становится при сравнении алгоритмов, в нашем случае перцептрона TL&NL с MLP+backprop. Поэтому в рамках наших экспериментов мы намеренно не допускаем никакой пред- и постобработки, за единственным исключением. В MNIST точки изображения даны в градации серого от 0 до 255. А нейросети удобнее работать с величинами на отрезке [0;1]. Поэтому единственную нормализацию, которую мы допускаем является разделение значения цвета на 255, как для обучающей, так и тестовой выборки.

https://habr.com/ru/articles/958498/

#перцептрон #исследование #искусственный_интеллект #mnist

Qiita - 人気の記事

Qiita - 人気の記事