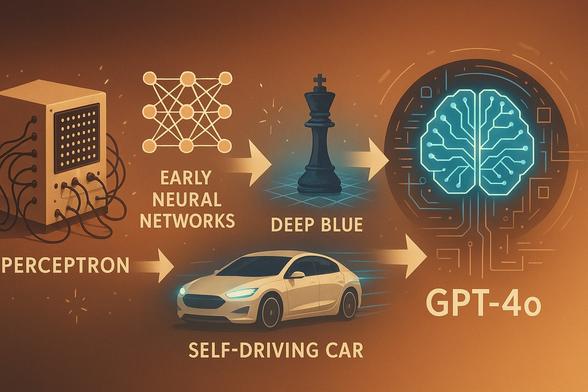

История ИИ на пальцах — от перцептрона до GPT-4o

История развития области искусственного интеллекта - невероятно захватывающая тема. Как из первых, довольно робких идей, которые часто подвергались критике, выросли технологии, меняющие наш мир прямо сейчас? Об этом пути – от почти механических предков ИИ до современных моделей вроде ChatGPT/Claude/Gemini/Grok и других, способных вести осмысленный диалог – я и хочу рассказать. Это не будет скушняцкий научный трактат, изложение фактов или лекция, а скорее взгляд со стороны человека, которому самому это все супер интересно - взгляд на ключевые вехи, прорывы и интересные моменты этой удивительной истории. Я собираюсь не просто пройтись по истории, но и на пальцах объяснить (вот как сам разобрался - так и расскажу) - как оно все работало. Возможно, без огромной технической глубины - зато интересно и с понятными примерами. Мы с вами получим представление о том, как оно было – от допотопного перцептрона до последних современных моделей-трансформеров. Посмотрим, как это работало, удивимся прорывам и попробуем заглянуть – что там за горизонтом (хотя, конечно, с AI-2027 мне тягаться бесполезно). Поехали!

https://habr.com/ru/articles/900228/

#история #искусственный_интеллект #ai #llm #интересное #programming #ии #перцептрон #технологии #развитие_технологий