E-Pflicht, Kunstfilme und Veterinärmedizin: Einblicke in die digitale Langzeitarchivierung bei LiLA.NDS

ein Beitrag von Markus Bierkoch (GWLB), Sven Grabenhorst (HBK), Sabine Leonhard-Marek (TiHo), Jesko Rücknagel (TIB) und Frauke Stiller (HBK).

Nachdem bereits drei Einrichtungen der ersten Projektkohorte ihre Einrichtung und das Sammelprofil, die Motivation zur Beteilung an der Landesinitiative sowie ihre im Rahmen von LiLA.NDS zu bearbeitenden Bestände im letzten Blogpost vorstellen konnten, folgen nun drei weitere Einrichtungen des ersten Bearbeitungsjahres.

Unterschiedliche Medien und Bestände werden gemeinsam mit der TIB auf ihre Datenqualität geprüft, strukturiert, und perspektivisch mit Hilfe entwickelter Workflows in das Langzeitarchiv der TIB transferiert.

In den folgenden Kurzinterviews berichten Vertreter:innen der Gottfried Wilhelm Leibniz Bibliothek (GWLB) , der Hochschule für Bildende Künste Braunschweig sowie der Tierärztlichen Hochschule Hannover über die verantwortungsvolle Aufgabe, ihre digitalen Bestände langfristig zu sichern.

Gottfried Wilhelm Leibniz Bibliothek

Dr. Markus Bierkoch berichtet über die aktuellen Aufgaben, die die GWLB als Pflichtexemplarbibliothek für Niedersachsen übernimmt. Seit 2025 gelten zusätzlich auch elektronische Publikationen aus Niedersachsen als Pflichtexemplare. Neben der Erschließung und Bereitstellung muss die GWLB auch die dauerhafte Archivierung der Pflichtexemplare sicherstellen. Darüber hinaus verfügt die GWLB über einen stetig wachsenden Bestand an Retrodigitalisaten wie des digitalisierten Leibniz-Nachlasses, aber auch zahlreiche historische Karten und Zeitungausgaben. Auch für diese Sammlung besteht ein Bedarf an einer digitalen Langzeitarchivierungslösung. Dies beinhaltet die Umsetzung der digitalen Langzeitarchivierung für die elektronischen Amtsdruckschriften und Pflichtexemplare sowie verschiedener Retrodigitalisate wie des digitalisierten Leibniz-Nachlasses, historischer Karten und Zeitungen.

Gemeinsam mit den Kolleg:innen Dr. Anne-Kathrin Henkel (stellvertretende Direktorin), Andreas Steinsieck (Abteilungsleitung Medienbearbeitung), Dr. Benedikt Tondera (Abteilungsleitung IT und Digitale Dienste), Manuela Schink (Sachbearbeitung E-Pflicht) und Olaf Guercke (Leiter der Stabsstelle Digitalisierung) beschäftigt sich Markus Bierkoch als Leiter des Sachgebiets Pflicht an der GWLB mit der Umsetzung der E-Pflicht im Rahmen einer zugeschnittenen IT-Lösung, die neben der Abgabe von elektronischen Pflichtexemplaren und deren automatisierte Verarbeitung auch die digitale Langzeitarchivierung umfasst.

Können Sie Ihre Einrichtung und deren Sammlungsschwerpunkte kurz vorstellen?

Die Gottfried Wilhelm Leibniz Bibliothek – Niedersächsische Landesbibliothek (GWLB) nimmt neben weiteren Aufgaben die Funktion der Pflichtexemplarbibliothek für Niedersachsen wahr. Sie hat den gesetzlichen Auftrag, Veröffentlichungen aus Niedersachsen sowie Publikationen mit Bezug zu Niedersachsen zu sammeln, bibliografisch zu erschließen, bereitzustellen und dauerhaft zu erhalten. Traditionell umfasste dies vor allem gedruckte Bücher, Zeitschriften und Zeitungen.

Inzwischen entstehen jedoch große Teile der regionalen Literaturproduktion ausschließlich digital, etwa E-Books oder E-Journals. Dem trägt das seit 2025 geltende Niedersächsische Pflichtexemplargesetz (NPflExG) Rechnung, auf dessen Basis nun auch elektronische Veröffentlichungen Pflichtexemplare darstellen. Für die Umsetzung dieses Auftrags wird an der GWLB zurzeit die entsprechende IT-Infrastruktur entwickelt. Ein zentrales Element davon ist die digitale Langzeitarchivierung, um auch elektronische Publikationen dauerhaft zu erhalten.

Gibt es ein digitales Objekt oder eine Sammlung, die Ihnen besonders am Herzen liegt?

Niedersächsisches Ministerium für Ernährung, Landwirtschaft und Verbraucherschutz (Hrsg.), Waldzustandsbericht, Bd. 2025. CC BY 4.0

Besonders wichtig ist für uns zum einen der bereits bestehende sowie der künftig noch zu sammelnde Bestand an elektronischen Amtsdruckschriften und Pflichtexemplaren. Gemäß unserem gesetzlichen Auftrag treffen wir beim Sammeln von Pflichtexemplaren keine inhaltliche Auswahl. Der Pflichtexemplarbestand bietet dementsprechend einen breiten Querschnitt des kulturellen und wissenschaftlichen Lebens in Niedersachsen. Die Erforschung dieses umfangreichen geistigen Erbes soll auch noch in Jahrhunderten gewährleistet sein.

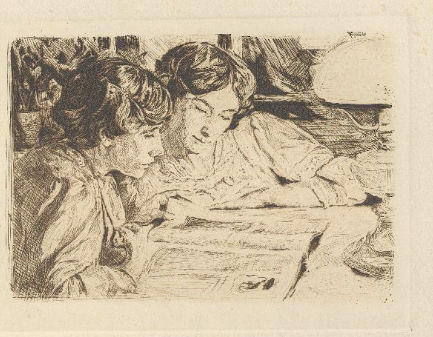

Darüber hinaus sind die zahlreichen Retrodigitalisate in unseren Digitalen Sammlungen von besonderer Bedeutung. Dazu zählt zum Beispiel der digitalisierte Nachlass von Leibniz, dessen Briefwechsel in das Weltdokumentenerbe aufgenommen wurde. Darüber hinaus hat die GWLB in den letzten Jahren aber auch zahlreiche historische Bücher, Handschriften und Karten sowie die bedeutende regionale Tageszeitung Hannoverscher Courier (1854 bis 1944) digitalisiert, welche für die landeskundliche Forschung einen hohen Wert besitzen. Dementsprechend muss auch für diesen digitalen Bestand eine dauerhafte Sicherungslösung gefunden werden.

Brief von Joachim Bouvet an Gottfried Wilhelm Leibniz vom 19. September 1699 aus Peking (China), in: Briefwechsel Joachim Bouvet mit Gottfried Wilhelm Leibniz.

Was motiviert Sie, Ihre digitalen Bestände zu archivieren? Gab es einen Auslöser, der den Anstoß gegeben hat, sich mit digitaler Langzeitarchivierung auseinanderzusetzen?

Die Motivation ergibt sich in erster Linie aus unserem gesetzlichen Auftrag, elektronische Pflichtexemplare dauerhaft aufzubewahren und zugänglich zu halten. Ein konkreter Auslöser war daher das Inkrafttreten des Niedersächsischen Pflichtexemplargesetzes (NPflExG). Das Gesetz macht deutlich, dass der um elektronische Pflichtexemplare erweiterte gesetzliche Sammelauftrag ohne digitale Langzeitarchivierung künftig nicht mehr erfüllbar wäre. Die Auseinandersetzung mit der digitalen Langzeitarchivierung ist daher weniger optional als vielmehr eine notwendige Weiterentwicklung unserer bibliothekarischen Kernaufgaben innerhalb eines sich mehr und mehr zum Digitalen hinwendenden Publikationsaufkommens.

Welche Unterstützung ist für Sie im Projekt besonders wertvoll?

Besonders wertvoll ist für uns zum einen die Unterstützung bei der Überführung historisch gewachsener digitaler Bestände in das digitale Langzeitarchivsystem. Unsere digitalen Bestände sind über die Jahre von verschiedenen Personen betreut sowie in verschiedenen technischen Systemen gepflegt worden. Außerdem haben sich über die Zeit hinweg entscheidende Rahmenbedingungen geändert zum Beispiel im Urheberrecht. Deshalb haben sich Inkonsistenzen bei Dateiformaten sowie Metadatenangaben eingeschlichen. Hierüber im fachlichen Austausch mit anderen Einrichtungen ein vertieftes Verständnis zu entwickeln und etwaige Datenbereinigungen zu planen, ist für uns von hoher Bedeutung.

Zum anderen ist es im Projekt besonders wertvoll, eine IT-Lösung für unsere spezifischen Anforderungen als Pflichtexemplarbibliothek zu entwickeln. Die Anforderungen, die sich aus dem Sammeln elektronischer Pflichtexemplare ergeben, unterscheiden sich häufig von denen der großen Mehrheit der Hochschul- und Universitätsbibliotheken. Sehr hilfreich ist, dass das LiLA.NDS-Team auf diese besonderen Anforderungen eingeht und gemeinsam mit uns sowie unseren weiteren Kooperationspartnern – der Verbundzentrale Göttingen (VZG) und dem Bibliotheksservice-Zentrum Baden-Württemberg (BSZ) – eine maßgeschneiderte Lösung plant und umsetzt.

Hochschule für Bildende Künste Braunschweig

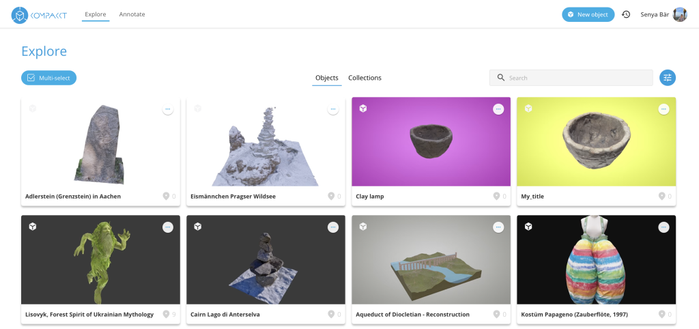

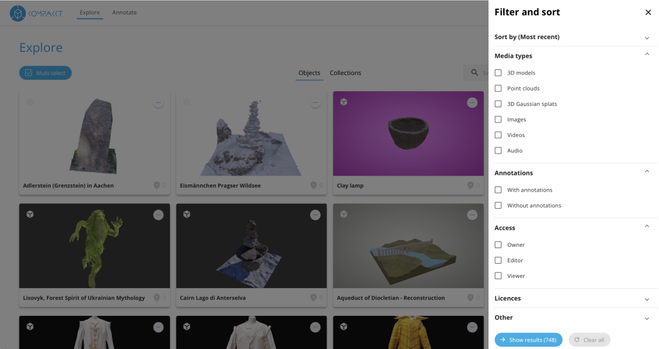

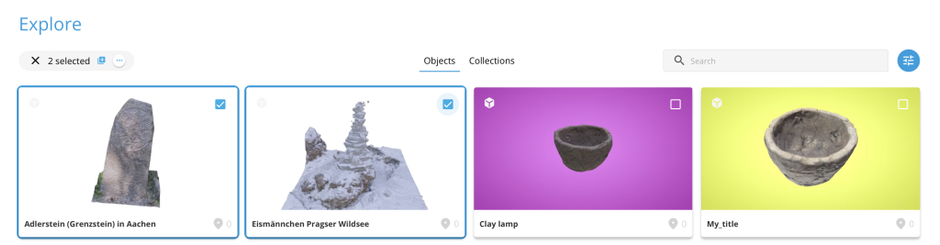

Als nächstes blicken wir auf die Bibliothek der Hochschule für Bildende Künste Braunschweig (HBK). Im Rahmen des LiLA-Projekts befasst sich die HBK vor allem mit audiovisuellen Medien, die Performances, künstlerisches Schaffen und Reflektieren abbilden und wertvolle Forschungsobjekte für künstlerische Fächer darstellen. Dr. Frauke Stiller, die Bibliotheksleitung, und Sven Grabenhorst, zuständiger Mitarbeiter für die Video- und Filmbearbeitung, skizzieren für uns die Arbeit an der Videosammlung. Unterstützt von ihrem Kollegen Joachim Schulz (Systembibliothekar) arbeiten sie kontinuierlich daran, die Digitalisierung des VHS‑ und DVD-Bestands umzusetzen und die Inhalte ins LZA-System der TIB zu überführen, um sie dauerhaft für Forschung und Lehre zu sichern.

Können Sie Ihre Einrichtung und deren Sammlungsschwerpunkte kurz vorstellen?

Als Hochschulbibliothek besteht unser vordingliches Interesse in der Versorgung von Lehre und Forschung, der an der Hochschule gelehrten Fächer. Ein besonderer Schwerpunkt aber liegt in der Sammlung von Kunst der Gegenwart und der klassischen Moderne. In Bereichen also, in denen Performances, künstlerische Interventionen, künstlerische Arbeitsprozesse und das Reflektieren über Formen künstlerischen Arbeitens im Gespräch am besten auf zeitbasierten Medien wie Video abgebildet werden und glücklicherweise worden sind. Genau diese Videos können ein interessanter Forschungsgegenstand werden und ein Schatz sein.

Gibt es ein digitales Objekt oder eine Sammlung, die Ihnen besonders am Herzen liegt?

In der Sammlung der Videos befinden sich viele Arbeitsergebnisse des künstlerischen Arbeitens an der HBK selbst. So zum Beispiel eine Kassette mit Ergebnissen des Kurses Videopraxis vom Anfang der 80-er Jahre. Diese Arbeiten heute vor ihrem historischen Hintergrund zu sehen, ist spannend.

Filmbild, Videopraxis 1983-1986, VC 165/83. © HBK Bibliothek

Was motiviert Sie, Ihre digitalen Bestände zu archivieren? Gab es einen Auslöser, der den Anstoß gegeben hat, sich mit digitaler Langzeitarchivierung auseinanderzusetzen?

Die Pläne einer Digitalisierung eines Teils unserer VHS-Bestände besteht schon länger. Um sie aber wieder allen berechtigten Nutzenden zugänglich zu machen, bedarf es eines Medienträgerwechsels. Die Anfrage aus der TIB zur Zusammenarbeit im Rahmen einer Langzeitarchivierung gab dann den Anstoß, das Projekt endlich anzugehen und um einen Teil des DVD-Bestandes zu erweitern. Die besondere Motivation liegt auch darin, die Werke unserer hauseigenen Künstler*Innen langfristig zu erhalten, um folgenden Generationen Inspirationsquelle und Forschungsobjekt zu sein.

Welche Unterstützung ist für Sie im Projekt besonders wertvoll?

Die Beratung durch das LiLA-Team, gerade in Bezug auf die vielen Kleinigkeiten und Probleme, die bei einem solchen Projekt auftreten, sind uns eine willkommene Unterstützung. Dies beinhaltet praktische Tipps bei der Erstellung von Workflows und Entscheidungen zu den Metadaten, genauso wie Hinweise zur rechtlichen Klärung. Wir freuen uns aber insbesondere auch über die ganz praktische und handfeste Unterstützung der Digitalisierung der DVDs selbst, wo die TIB mit ihrer Technik eine große Zeitersparnis für uns bedeutet. Dafür bedanken wir uns hier gern nochmal.

Tierärztliche Hochschule Hannover

Die Bibliothek der Stiftung Tierärztliche Hochschule Hannover (TiHo) verfügt über umfangreiche und teils seltene Bestände der Veterinärmedizin und betreibt zentrale Informationsdienste. Prof. Dr. Sabine Leonhard-Marek, die Leiterin der Hochschulbibliothek, spricht mit uns über die vielfältigen Bestände der TiHo – von den Digitalisaten historischer Monographien über Hochschulschriften bis hin zu seltenen Spezialbeständen sowie Kongressberichten – und die Motivation, diese langfristig zu bewahren. Unterstützt wird sie von ihrem Team Christina Gückel (stellvertretende Bibliotheksleiterin), Ngoc Anh Tran (Repositorium) und Sonja Hartinger (Hochschulschriften). Aufgrund der zunehmenden Digitalisierung der Forschung und der einhergehenden Verantwortung, digitale wissenschaftliche Publikationen dauerhaft verfügbar zu halten, bietet das Projekt die Möglichkeit verschiedene Herausforderungen zu adressieren.

Können Sie Ihre Einrichtung und deren Sammlungsschwerpunkte kurz vorstellen?

Als zentrale Einrichtung der Universität versorgt die Bibliothek der Stiftung Tierärztliche Hochschule Hannover (TiHo) Forschende und Studierende mit Fachinformationen aus der Veterinärmedizin und angrenzenden Fächern. Sie stellt die für Forschung, Studium und Lehre essenziellen Informationsinfrastrukturen für Recherche und Publikation bereit und sorgt durch die Beratung zum Thema Open Access und die Unterstützung bei Publikationsvorhaben für eine erhöhte Sichtbarkeit des Forschungsoutputs.

Die Hochschulschriften (Dissertationen, PhD-Thesen und Habilitationen) werden an der TiHo seit Ende 2000 parallel zur Druckausgabe auch elektronisch veröffentlicht. Diese Veröffentlichungen wurden zunächst auf von der TiHo intern betriebenen Plattform bereitgestellt und sind 2019 in das auf MyCoRe basierende Repositorium „TiHo eLib“ umgezogen. Außer diesen Primärveröffentlichungen werden auch die von TiHo-Forschenden im Open Access publizierten Fachartikel in der „TiHo eLib“ als Zweitveröffentlichung aufgenommen. Das Repositorium fungiert darüber hinaus als Hochschulbibliographie und hat damit die vorher gedruckt oder als PDF bereitgestellte Bibliographie abgelöst.

Perspektivisch sollen darüber hinaus die Digitalisate der „Digitalen Bibliothek Veterinärmedizin“ in das Repositorium umziehen. Im Rahmen eines von der Deutschen Forschungsgemeinschaft (DFG) geförderten Digitalisierungsprojekts wurden bis 2014 aus den Beständen der Bibliothek insgesamt 1.436 zwischen 1599 und 1890 erschienene Monographien digitalisiert, nachbearbeitet, katalogisiert, archiviert und als „Digitale Bibliothek“ frei suchbar und nutzbar gemacht.

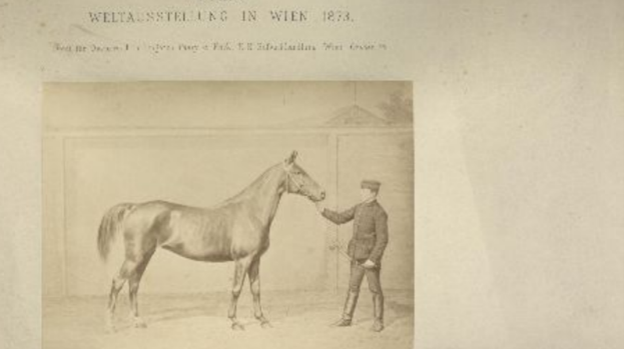

Landwirthschaftliches Tierracen-Album © Bibliothek der Tierärztlichen Hochschule Hannover

Als ehemalige Sondersammelgebietsbibliothek für die Veterinärmedizin und die allgemeine Parasitologie verfügt die TiHo über fachlich seltene und einmalige Bestände, die langfristig erhalten werden sollen. Hierzu gehören nicht nur die oben beschriebenen Monographien, die über Digitalisate überregional nutzbar gemacht wurden, sondern auch Kongressberichte und andere graue Literatur, die nur in digitaler Form vorliegt und dies zum Teil auf elektronischen Trägermedien, deren Funktionalität endlich ist.

Was motiviert Sie, Ihre digitalen Bestände zu archivieren? Gab es einen Auslöser, der den Anstoß gegeben hat, sich mit digitaler Langzeitarchivierung auseinanderzusetzen? Gibt es ein digitales Objekt oder eine Sammlung, die Ihnen besonders am Herzen liegt?

Ludwig Daum: Ueber das Koppen der Pferde. © Bibliothek der Tierärztlichen Hochschule Hannover

Der Forschungsoutput der Hochschule umfasst zunehmend genuin digitale Publikationen, so dass wir es im Rahmen der Bestandserhaltung als unsere Aufgabe ansehen, auch diesen digitalen Output als Bestand zu erhalten und ihn langfristig zu sichern. Zum Teil ist diese digitale Kopie eine zweite Kopie, da im Fall der Hochschulschriften über die Abgabe an die Deutsche Nationalbibliothek und im Fall der Artikel in Fachzeitschriften weitgehend über die jeweiligen Verlage die Archivierung einer weiteren Kopie zugesagt ist. Studien haben aber in der Vergangenheit gezeigt, dass nicht alle Artikel in wissenschaftlichen Zeitschriften durchgehend abrufbar sind (zum Beispiel Laakso et al. 2021). Da es sich um Forschungsleistungen der eigenen Hochschule handelt, liegt uns die dauerhafte Sicherung dieses Bestandes besonders am Herzen.

Das Repositorium der TiHo wird vom Gemeinsamen Bibliotheksverbund (GBV) gehostet, so dass die Metadaten der Hochschulbibliographie über Backup und Bitstream-Preservation gesichert sind. Die zukünftige Lesbarkeit der hochgeladenen Volltexte ist damit jedoch nicht abgedeckt und muss separat geplant werden.

Der aktuell für die Digitalisate genutzte Viewer ist in die Jahre gekommen und muss aktualisiert werden, so dass auch hier Handlungsbedarf bestand.

Welche Unterstützung ist für Sie im Projekt besonders wertvoll?

Insgesamt sind die engmaschige Betreuung und die gemeinsame Arbeit an optimalen Workflows in diesem Projekt besonders hervorzuheben. Dabei birgt jeder Projektteil besondere Herausforderungen. So haben wir zu Beginn die Fragen diskutiert, welche Publikationen bereits wie langzeitarchiviert werden und wann eine Doppelarchivierung empfehlenswert wäre. Die Digitalisate liegen in verschiedenen Formaten vor (TIFF, PDF, xml, txt, und sind zum Teil mit OCR erfasst). Hier wird im Rahmen des Projektes erarbeitet, welche Formate wie gespeichert und wie abrufbar sein sollen. Bei der grauen Literatur muss für die Langzeitarchivierung das Problem ungeklärter Rechtslagen berücksichtigt werden. Eine nachträgliche Rechteklärung ist oft nicht mehr möglich, weil die Rechteinhaber nicht ermittelbar oder erreichbar sind. Hier war die Expertise der TIB für die Entwicklung eines geeigneten Vorgehens ebenfalls sehr hilfreich.

Ausblick

Die Umsetzung der digitalen Langzeitarchivierung bleibt eine spannende, wenn auch herausfordernde Aufgabe für alle beteiligten Einrichtungen. Die Bearbeitung der ersten Projektkohorte wird auch in den nächsten Monaten intensiv fortgeführt, während die zweite Kohorte bereits in den Startlöchern steht.

Blogreihe „LiLA.NDS“

Im Rahmen einer begleitenden Blogreihe werden wir regelmäßig über den Projektfortschritt Landesinitiative Langzeitarchivierung Niedersachsen (kurz LiLA) berichten. So erhalten Interessierte außerhalb des Projektkonsortiums Einblicke in die Arbeit von LiLA. In den kommenden Beiträgen stellen sich die beteiligten Einrichtungen vor, berichten über ihre zu archivierenden Bestände und erläutern, warum die digitale Langzeitarchivierung für sie von besonderer Bedeutung ist. Damit ist die Blogreihe eine wichtige Säule in der geplanten Wissensbasis, die es dem Projekt ermöglicht, Best Practices vorzustellen und Einblicke in die Umsetzungsphase zu geben.

[1] Laakso, M., Matthias, L., & Jahn, N. (2021). Open is not forever: A study of vanished open access journals.

Journal of the Association for Information Science and Technology, 72(9), 1099–1112.

https://doi.org/10.1002/asi.24460

#Services #LiLANDS #LizenzCCBY40INT #DigitaleLangzeitarchivierung #Bestandserhaltung #Digialisierung