It's National Streaming Day - and your team is streaming all day too

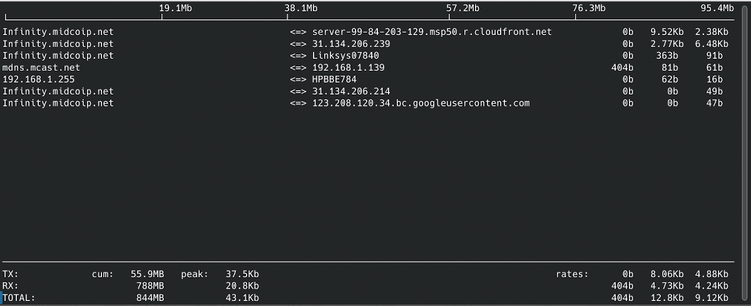

Video calls. Cloud apps. VoIP phones. File syncs. Your business runs on real-time data streaming whether you realize it or not. If your network can't handle the load, you get frozen screens, dropped calls, and lost productivity. We optimize networks so your business streams without stuttering.

Is your bandwidth keeping up? Let's find out.

https://calendly.com/techdynamix/15-minute-phone-call

#NationalStreamingDay #Bandwidth #Netwo

https://calendly.com/techdynamix/15-minute-phone-call

15-Minute Consultation - Jay Baruffa

Struggling with slow IT support, security concerns, or outdated systems? Tech Dynamix is here to help.In this quick, no-pressure consultation, we’ll: Review your current IT setup Identify performance or security gaps Share tailored recommendations to help your business run smoother and safer