Cursed_browser: Web browser with a VLM as rendering engine

Cursed_browser는 전통적인 렌더링 엔진 없이 비주얼 언어 모델(VLM)을 활용해 HTML을 해석하고 페이지를 시각적으로 생성하는 혁신적인 웹 브라우저입니다. 각 페이지 로드는 LLM이 HTML을 토큰 단위로 분석하고, VLM이 픽셀을 생성하는 방식으로 이루어져 매번 독창적인 렌더링 결과를 보여줍니다. 현재 버전은 웹에서 직접 데이터를 읽지 않고, 사전 학습된 모델이 기억한 내용을 기반으로 페이지를 재구성하며, 향후 버전에서는 페이지별 맞춤형 브라우저 엔진을 생성해 효율성을 극대화할 계획입니다. 이는 AI 네이티브 브라우저라는 새로운 개념을 제시하며, 기존 브라우저와는 전혀 다른 접근법을 보여줍니다.

Browser agent için 8 gorsel LLM'i ekran goruntusu temellendirmede kıyasladık.

Şaşırtıcı bulgu: Qwen 3.5-9B, 308B parametreli MiMo V2.5'in kaçırdığı bir dropdown affordance'ını doğru sınıflandırıyor. Affordance parametre sayısıyla ölçeklenmiyor.

8 modelden sadece 1'i (Qwen 3.6-35B-A3B) kalibrasyonda dürüst belirsizlik gösteriyor.

Detaylı yazı + VRAM önerileri:

https://webbrain.one/blog

GitHub'da ⭐ atarsanız çok seviniriz 🙏

https://github.com/esokullu/webbrain

Benchmarked 8 VLMs for screenshot grounding inside a browser agent.

Counterintuitive finding: Qwen 3.5-9B classifies a dropdown affordance that 308B MiMo V2.5 misses. Affordance doesn't scale with parameter count.

Only 1 of 8 (Qwen 3.6-35B-A3B) flags honest uncertainty in calibration.

Full write-up + VRAM tier recs + repo:

#LocalLLM #VLM #AIAgents #OpenSource #Qwen #qwen36 #MachineLearning #FOSS #AI

Робот, способный создать себя сам. Режим «Инженера» в робототехнике

Скажите роботу «настрой манипулятор» — и он напишет драйвер сам. Звучит как фантастика из тех самых фильмов 80-х и 90-х, но мы уже реализовали это в OpenGrall. Рассказываю, как работает режим Инженера и почему последнее слово всегда остаётся за человеком

https://habr.com/ru/articles/1030526/

#LLM #VLM #робототехника #OpenGrall #ИИ #Python #WebSocket #YandexGPT #DeepSeek #самокодинг

z.ai GLM 5.1: Как я научил слепую модель видеть

Если у вас есть неограниченный доступ к фронтир моделям (Calude, Codex и т.д.), то эта статья не для вас. Сегодня доступны отличные недорогие модели для кодинга и архитектуры. Например, GLM-5.1 (реферальная ссылка +10% бонус на пополнение) умеет генерировать, рефакторить, отлаживать код, строить архитектуру – в десятки раз дешевле фронтит моделей или вообще бесплатно при локальном развёртывании. Но у всех таких моделей часто есть общая слепая зона: они не видят результат своей работы . В этой статье я рассказываю, как "научить модель видеть".

https://habr.com/ru/articles/1029682/

#MCP #vision #VLM #qwen3vl #Ollama #кодингагент #тестирование #скриншот #opensource #prompttuning

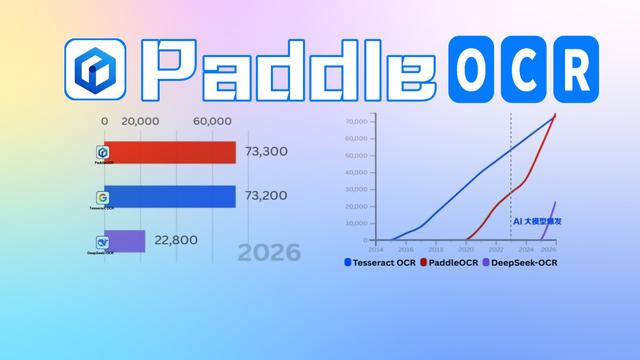

Baidu Inc. (@Baidu_Inc)

PaddleOCR가 GitHub에서 가장 많은 스타를 받은 OCR 저장소가 되었다. 동시에 기존 OCR 시스템이 대형 VLM 수준의 정확도를 더 작은 크기와 비용으로 달성하는 어려운 과제를 짚으며, PP-OCRv5 모델의 해결 방식을 소개한다.

Baidu Inc. (@Baidu_Inc) on X

PaddleOCR is now the most-starred OCR repo on GitHub! And like OCR systems across the field, it faces a long-standing challenge: matching the accuracy of large VLMs without their size or compute cost. Here, we take a closer look at how one of its models, PP-OCRv5, solves that

Pedro Cuenca (@pcuenq)

Kimi K2.6가 출시되었으며, MLX(mlx-vlm)에서 두 개의 M3 Ultra로 1T 파라미터 VLM을 구동하는 모습이 소개되었습니다. 대규모 비전-언어 모델의 최신 공개와 로컬/하드웨어 최적화 활용 사례로 주목할 만합니다.

金のニワトリ (@gosrum)

Qwen3.6-35B-A3B 모델을 VLM 테스트에 적용한 결과를 공유하는 내용입니다. 매우 빠른 속도가 인상적이지만, 마리오 게임을 클리어하는 수준의 복합 과제는 여전히 어려운 것으로 보인다고 평가합니다.

👾

👾