The Economics of AI Don’t Add Up

Money talks. Bullshit walks. Bubbles pop, and the world just keeps on burning while the big wheels just keep on turning. Pick a vibe. Pick a cliché. Pick a metaphor. Pick and mangle a song lyric. Just don’t try to pick a winner in the big AI race when it comes to dollars and cents. Or sense. The racers are running in circles, burning the planet and dollars trying to figure out how to keep things on a track no one has figured out quite yet.

Hint: It’s a circle, jerks.

From the beginning the hype about Artificial Intelligence has felt like it’s all about the vibes. So many vibes. I define “the beginning” as when OpenAI took the wraps off of ChatGPT and kick started the race. Maybe they should have just done a Kickstarter.

Those were heady days. I remember everyone thinking ChatGPT would replace Google. Now we’re at the point where Google is trying to replace itself.

Today, chatbots are replacing human connections, and all sorts of crustaceans are being installed on computers, causing some havoc in the hardware markets along the way. Things have now progressed to a point that folks are vibe coding up a storm, now that it seems more doable. And it’s interesting to see and hear some who were initially skeptical about the broad scope of AI now embracing it. For what it’s worth, the current vibe feels to me like AI is heading into its GUI phase of computing, only you need a keyboard or a microphone instead of a mouse to get around on a screen or without one.

And yet, when it comes to the money game, the vibe feels like the math behind all those 0’s and 1’s might not add up.

Corporations are starting to scale back usage now that the bills are coming in. Microsoft and other tech companies are pulling plugs, in most cases for third party access among the employees they haven’t let go. At the same time there’s whispers that AI costs are beginning to exceed the costs of human employees. Corporations are starting to adjust because the beans they are counting don’t look like they will add up and no one has vibe coded an accounting app yet to project when, of if they will.

Consumers are looking at that $20 month subscription cost and backing off while trying to choose which, if any, of the constantly updating models that still promise inaccuracy will give them the best monthly bang for a double sawbuck. To make the math sting even more, Google, OpenAI, Claude, etc… are tossing around $100 a month (and higher) plans for the latest and supposedly best features that make $20 a month feel like a poor man’s vibe.

There’s a technology intersection that has always been on the roadmap for computing technology since the dawn of the personal computer. To an extent, enterprise computing always subsidized consumer technology. The vibes I’m sensing hint that roadmap may be changing, and it won’t just affect the costs of using AI, computer memory, and chip production. It potentially may filter into every facet of life from medical bills, to insurance premiums, to any wholesale or retail concern that might employ AI. Don’t think for a minute that any company is going to simply eat the rising costs of AI usage, or cut back prices should using it somehow actually produce savings from cutting employees.

Call me when you hear the first company touting that they are cutting costs due to AI. Trust me, I won’t be waiting by the phone.

If a vibe has a bottom line, here’s how I see this one. We’re heading into a moment where what we think of as computing and the Internet is going to run on two diverging tracks. It’s becoming obvious that whether someone is running any of the AI robots on their own device or somewhere on the Internet that the costs are more than anyone could have predicted, or thought might become sustainable.

The $20 a month marker was a big hint early on. We were all used to the Internet come on of getting in free, being swamped with ads, and then having to eventually subscribe so our data could be collected. That $20 a month heralded a change, but only at the point of entry.

Given that we all know that advertising is coming to AI, we’re escaping the orbit that we’ve been in for quite some time that most of the Internet was free but required a level of tolerance for advertising. I’m guessing that those who can only afford the $20 a month price tag with ads will think back on the ways we’ve complained about the streaming entertainment services and their ad proliferation as quaint by comparison.

The Circle

That $20 entry fee will rise. So will the more expensive options. I’m actually surprised we haven’t see that already. The fact that AI has to continually train itself to remain relevant means it’s going to continue to need new computing cycles to consume whatever is generated in the future, whether by humans or robots. I don’t think you can build enough data centers on the surface of this planet, under the sea, or in space to afford the churn and burn. That’s the circle. In the end it’s a real estate play that yields only cul-de-sacs.

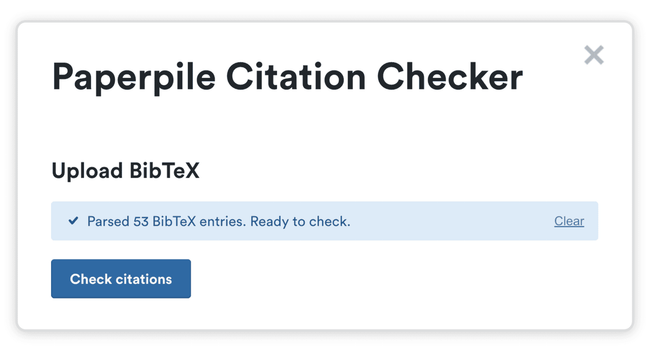

Take a look at this article from Simon Willison. Unlike my pessimistic vibe on this, Willison seems to think Anthropic and OpenAI have found their product-market fit. He’s spending $200 a month ($100 to each) and considers that a bargain since his usage of the two generated $2,180 change in token use for a month. That math certianly adds up as a good deal in the current moment. Until you consider that at some point the difference between what he’s paying and what he’s using is going to have to be put on somebody’s balance sheet in some way. These companies can’t run at a loss forever.

It’s a good piece by Willison that informs quite a bit on this discussion and worth your time, because I think that’s what the discussion is going to inevitably come down to. Set aside all of the debates about accuracy, copyright, and environmental issues. Set aside the rising consumer backlash. Bottom lines are where everything sinks to eventually.

I admire and am grateful for folks like Willison, Federico Viticci, and others who are exploring this frontier and think we should be paying attention to their efforts and learn from them. Viticci has crafted a few interesting bits of software of late and spent some coin in doing so. I’m enjoying reading about his efforts.

I may be wrong, but it feels like we might be headed to a point that to use some software in the future, we’re going to need one of these ever changing and increasingly expensive AI engines on our computers to run some of the software that will be generated in the future. That will certainly come with a price tag. If, actually in my opinion when that happens, it will become another border defined by costs, dividing users between those who can afford the entry fee, and those who can’t.

It will also affect far more than our computing lives.

(Image from Viktoria_P on Shutterstock)

You can also find more of my writings on a variety of topics on Medium at this link, including in the publications Ellemeno and Rome. I can also be found on social media under my name as above. This site does not use affilate links.

#ai #ArtificialIntelligence #ArtificialIntellignece #chatgpt #llm #Tech #technology