We are headed to #ICRA 2026!

We will be showcasing two of our latest research breakthroughs at the International Conference on Robotics and Automation (ICRA) next week.

_

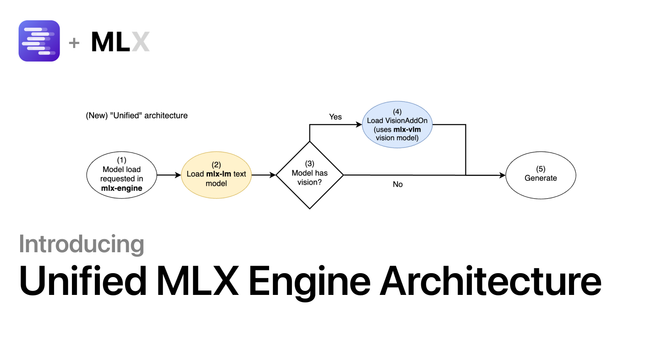

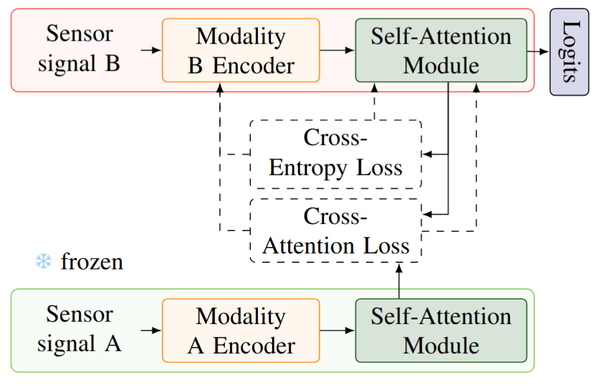

1️⃣ D-CAT 😼: Decoupled Cross-modal Knowledge Transfer

📍 Track: Interactive Session 6 − Hall C (Poster Session)

📅 Date/Time: Thursday, 15:00-16:30, Paper ThI2I.59

🧑🔬 Authors: Leen Daher,* Zhaobo Wang, Malcolm Mielle

Our work on D-CAT solves a major real-world challenge: training a system with rich, multi-modal data (like video, IMU, and audio) but allowing it to operate using only a single sensor during inference.

By enabling cross-modal knowledge transfer, D-CAT reduces hardware redundancy and costs without sacrificing accuracy—even showing up to a 10% F1-score gain in certain scenarios!

Paper: https://arxiv.org/pdf/2509.09747

* Leen Daher is currently searching for a PhD/job in the EU, and will be presenting in person.

_

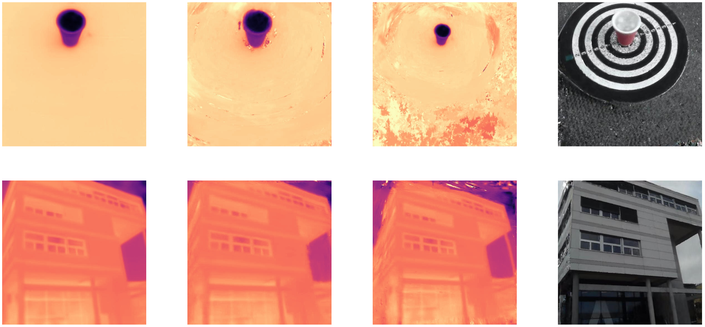

2️⃣ Unpaired Multi-Modal Reconstruction 📸🔥

📍 Track: Workshop Paper - MM-SpatialAI Workshop

📅 Date/Time: June 1st

🧑🔬 Authors: Jean Cordonnier, Chenghao Xu, Olga Fink, Malcolm Mielle

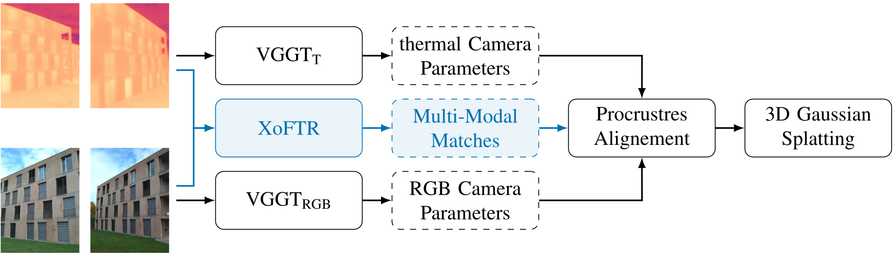

We introduces a framework for independent RGB-Thermal Novel View Synthesis reconstruction. We’ve developed a framework combining VGGT, feature matching, and multi-modal 3DGS to accept decoupled RGB/TIR image sets, proving that misalignment between modalities doesn't have to compromise the quality of the reconstruction.

#ICRA2026 #Robotics #MachineLearning #ComputerVision #MultiModal #SensorFusion