The Humanoid Hub (@TheHumanoidHub)

Genesis AI가 SF 베이 에어리어 기반의 풀스택 embodied AI 스타트업으로 소개됐다. 기반 모델, 20 DoF 손, 촉각 센싱 데이터 수집 장갑과 데이터 엔진, 커스텀 모터 컨트롤러, 고정밀 시뮬레이터까지 포함한 로보틱스/임바디드 AI 스택을 공개했다.

The Humanoid Hub (@TheHumanoidHub) on X

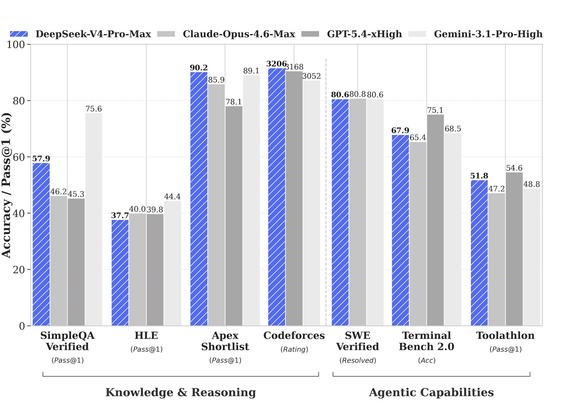

Genesis AI has stepped into the spotlight The company is a SF Bay Area-based full-stack embodied AI startup. The Stack - Foundation model - 20 DoF dexterous hand - Tactile-sensing data-collection glove + Data engine - Custom motor controllers - In-house high-fidelity simulator