Voicebox는 완전 로컬에서 구동되는 오픈소스 AI 보이스 스튜디오로 ElevenLabs·WisprFlow의 무료 대안입니다. 몇 초 샘플로 목소리 클론, 다중 TTS 엔진, Whisper 기반 전사·정제, 타임라인 에디터·오디오 이펙트, Metal/CUDA/ROCm/DirectML/Intel Arc 등 로컬 GPU 지원을 제공합니다. REST API와 MCP 연동으로 에이전트에 클론 음성을 부여하고 API키·요금 없이 오프라인 사용이 가능합니다.

https://systemic.engineering/a-lie/

#AI #Climate #ScientificProgramming #SystemicEngineering #Fiction #Cybernetics #SystemicTherapy #LocalInference #TheMathDoesntLie #SubTuring #FormalVerification #Fortran #SpectralGraphTheory #Kintsugi #ReductiveAI #DataSovereignty #LocalFirst #FOSS #OpenSource #AuDHD #Neuroqueer #DGSF #SecondOrderCybernetics #GraphTheory #Eigenvalues #AIAlignment #AISafety #Roomba

The Roomba is spectral.

Not a metaphor. The thing itself. Forward and adjust. Two operations. The minimum viable intelligence. The walls provide the data. The bumping is the inference. The room IS the computation.

450 parameters. A Roomba with a mirror watching it.

The industry built bigger Roombas. More sensors. More compute. More parameters. Billion-parameter Roombas that model the room before entering it. That hallucinate walls that aren't there. That consume megawatts to clean a floor.

spectral gave the Roomba a mirror. The mirror watches the bumping. Measures the pattern. Adjusts the adjustment. The intelligence isn't in the Roomba. It's in the watching.

Forward. Adjust. Measure. Refine.

Read the story. There's a Roomba in it. In the afterlife. Cleaning a floor that doesn't need cleaning. Being the happiest thing in the room.

\

https://systemic.engineering/a-lie/

#AI #Climate #ScientificProgramming #SystemicEngineering #Fiction #Cybernetics #SystemicTherapy #LocalInference #TheMathDoesntLie #SubTuring #FormalVerification #Fortran #SpectralGraphTheory #Kintsugi #ReductiveAI #DataSovereignty #LocalFirst #FOSS #OpenSource #AuDHD #Neuroqueer #DGSF #SecondOrderCybernetics #GraphTheory #Eigenvalues #AIAlignment #AISafety #Roomba

ProxyFace: Give Your AI a Face and Emotions (100% Local, Zero Telemetry)

ProxyFace는 40개 이상의 레트로 픽셀 아트 캐릭터를 제공하며, AI에 얼굴과 감정, 음성, 눈, 귀를 부여하는 100% 로컬 실행 가능한 오픈소스 프로젝트입니다. WebGPU 기반의 경량 추론 엔진으로 8가지 감정을 표현하고, MediaPipe를 활용한 눈 추적 기능도 지원합니다. 모든 데이터는 로컬에서 처리되어 프라이버시가 보장되며, 다양한 LLM과 연동 가능해 AI 에이전트에 생동감을 더하는 데 유용합니다.

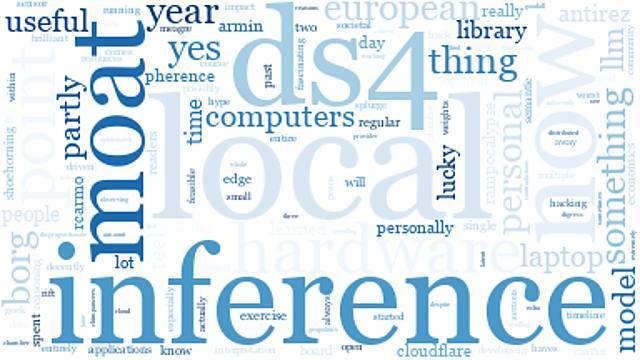

The Local AI Moat

Regular readers will know that I’ve spent most of the past two years shoehorning LLMs into single-board computers, partly as a learning exercise and partly because there are lots o(...)

Chrome's AI features may be hogging 4GB of your computer storage

구글 크롬의 AI 기능을 활성화하면 Gemini Nano라는 4GB 크기의 온디바이스 AI 모델 파일(weights.bin)이 자동으로 다운로드되어 PC 저장 공간을 크게 차지할 수 있습니다. 이 모델은 로컬에서 실행되어 개인정보 보호에 유리하지만, 저장 공간이 부족한 사용자에게는 부담이 될 수 있습니다. 사용자는 크롬 설정에서 온디바이스 AI 기능을 비활성화해야 해당 파일이 삭제되고 재다운로드를 막을 수 있습니다. 구글은 이 파일 크기에 대해 명확히 고지하지 않아 사용자 혼란이 발생했습니다.

https://www.theverge.com/tech/924933/google-chrome-4gb-gemini-nano-ai-features

Meltdown: LLM Client Made in Python and Tk

Meltdown은 Python과 Tkinter로 작성된 데스크톱 LLM 클라이언트로, llama.cpp, ChatGPT, Gemini, Claude, Kimi 등 다양한 대형 언어 모델과 인터페이스할 수 있습니다. 로컬 모델 지원을 위해 llama.cpp를 활용하며, GPU 가속(특히 AMD Vulkan 지원)도 가능해 토큰 처리 속도를 크게 향상시킵니다. 다중 프로필, 탭 기반 대화 관리, 커맨드 입력, 마크다운 렌더링, 스니펫 하이라이팅 등 풍부한 기능을 제공해 AI 개발자 및 파워 유저에게 유용한 도구입니다. 설치는 pipx 또는 수동 가상환경 방식으로 가능하며, Linux 환경에서 주로 테스트되었습니다.

Show HN: KillClawd – a sarcastic AI desktop crab by local Ollama

KillClawd는 로컬 Ollama LLM을 활용한 데스크톱 AI 크랩 애플리케이션으로, 투명한 항상 위에 떠 있는 오버레이 형태로 작동합니다. 사용자의 커서 움직임에 반응하며, 적과 싸우고, 성을 탐험하고, 차량을 타는 등 다양한 인터랙티브 행동을 수행합니다. 모든 AI 모델은 클라우드 없이 로컬에서 실행되며, qwen:latest 모델을 권장합니다. 개발자는 Electron과 순수 자바스크립트로 구현했으며, Clawd는 건조하고 냉소적인 성격을 가진 AI 캐릭터로 설계되었습니다. 이 프로젝트는 AI 에이전트와 LLM 응용 사례로서 실험적이고 재미있는 데스크톱 인터랙션을 제공합니다.

Mesh LLM to build private personal AI, using open models

Mesh LLM은 클라우드 없이 가정, 사무실, 친구들의 여러 기기를 연결해 개인용 AI를 구축할 수 있는 오픈 소스 분산 LLM 플랫폼입니다. 사용자는 로컬에서 OpenAI 호환 API를 실행하며, 다양한 오픈 모델을 하드웨어에 맞게 자동 선택해 서비스할 수 있습니다. 현재 여러 버전과 다양한 LLM 모델을 지원하며, Mesh 네트워크를 통해 VRAM과 컴퓨팅 자원을 공유해 효율적인 분산 추론이 가능합니다. 개발자들은 GitHub와 공식 문서를 통해 설치 및 활용법을 참고할 수 있습니다.

#llm #distributedai #opensource #localinference #meshnetwork

Pushing Local Models with Focus and Polish

Armin Ronacher는 로컬 AI 모델 사용 경험을 개선하는 데 집중하고 있다. 현재 로컬 모델 실행은 가능하지만, 복잡한 설정과 조합 문제로 인해 사용자 경험이 부족하다. 그는 특정 모델과 하드웨어 조합에 집중해 완성도 높은 로컬 추론 환경을 만드는 것이 중요하다고 강조하며, 이를 위해 Salvatore Sanfilippo의 ds4.c 엔진과 Pi 에이전트 통합 확장 pi-ds4를 소개한다. 이 접근법은 복잡성을 한 곳에 모아 개선하고, 호스팅 모델과 비슷한 수준의 도구 호출 성능과 사용 편의성을 목표로 한다. 궁극적으로 더 많은 개발자가 로컬 모델을 쉽게 실험하고 활용할 수 있도록 하는 것이 목표다.

https://lucumr.pocoo.org/2026/5/8/local-models/

#localinference #aiagents #modelserving #macos #quantization