Ivan Fioravanti ᯅ (@ivanfioravanti)

MiniMax M2.7을 집에서 풀 프리시전으로 실행했다는 내용으로, 새 AI 모델의 로컬 구동 가능성과 성능에 대한 관심을 보여준다.

Ivan Fioravanti ᯅ (@ivanfioravanti)

MiniMax M2.7을 집에서 풀 프리시전으로 실행했다는 내용으로, 새 AI 모델의 로컬 구동 가능성과 성능에 대한 관심을 보여준다.

AA (@measure_plan)

Mac mini에서 로컬로 실시간 브라우저 실행이 가능하다는 데모로, 객체 탐지용 RF-DETR과 Gemma-4-E2B 모델을 함께 사용한 사례입니다. 로컬 AI 추론과 브라우저 기반 실시간 처리 가능성을 보여주는 흥미로운 구현입니다.

Bam (@0xBam)

MLX와 RDNA, exolabs를 활용해 Mac M5 Max/M3 Ultra 환경에서 어떤 AI 모델이 잘 구동되는지 실험해 보려는 내용입니다. 로컬 추론용 모델 테스트와 하드웨어 호환성, 실행 팁을 묻고 있어 AI 개발자에게 유용한 실험 주제입니다.

Ivan Fioravanti ᯅ (@ivanfioravanti)

Apple Silicon 로컬 추론에서 가장 큰 문제였던 prefill 속도를 Neural Accelerators가 개선했다고 언급하며, Apple 로컬 인퍼런스의 미래가 밝다고 평가했다.

Brie Wensleydale (@SlipperyGem)

작성자는 비용 부담을 피하려면 고가 도구와 저가 도구를 혼용하라고 권하며, SeeDance와 같은 레퍼런스 및 씬 일관성(reference and scene consistency) 도구가 로컬 환경에서도 곧 제공되길 바란다고 언급합니다. 도구 조합 전략과 로컬에서의 일관성 유지 툴 도입 기대를 표현한 트윗입니다.

🚀 Want to run BitNet-b1.58-2B-4T locally? The new setup_env.py script automates a CMake build of the C++ backend, turning Python-driven setup into a fast inference engine. Perfect for hobbyists and researchers eager to experiment with large AI models offline. Dive into the details and see how easy open-source deployment can be! #BitNet #Python #CMake #LocalInference

🔗 https://aidailypost.com/news/python-setupenvpy-builds-bitnet-b158-2b-4t-c-backend-via-cmake

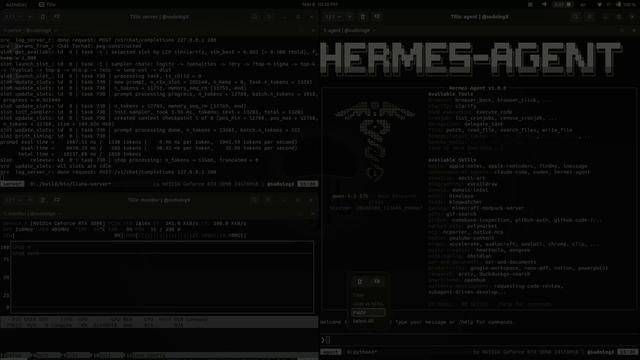

Sudo su (@sudoingX)

Hermes agent가 단순 과장이 아니라고 평가했습니다. 작성자는 단일 RTX 3090에서 Qwen 3.5 27B 베이스(Q4_K_M, 262K 컨텍스트, 초당 29-35토큰)를 완전 로컬로 구동해 '내 머신, 내 데이터' 환경을 구현했다고 보고하며, 에이전트에게 스스로 모델을 발견하도록 지시해 테스트한 경험을 공유했습니다.

okay the fuss around hermes agent is not just air. this thing has substance. installed it on a single RTX 3090 running Qwen 3.5 27B base (Q4_K_M, 262K context, 29-35 tok/s). fully local. my machine my data. first thing i did was tell it to discover itself. find its own model

Dan McAteer (@daniel_mac8)

오래된 데스크탑을 꺼내 OpenClaw를 설치·호스팅해 본 경험을 공유. 작성자는 로컬에서 최신급 LLM 도구를 운용할 수 있게 된 것에 놀라움을 표하며, 이를 통해 컴퓨터로 상상 가능한 거의 모든 것을 해낼 수 있다는 자신감을 얻었다고 밝힘. 로컬 호스팅·자급형 AI 도구 사용 사례를 보여줌.

Lex Sokolin | Generative Ventures (@LexSokolin)

로컬 추론 장비가 400W 수준으로도 강력해졌다는 관찰입니다. 1년 전에는 데이터센터 랙이 필요했지만, 이제 로컬에서 에이전트를 구동하는 경제성이 크게 개선되어 AI 컴퓨트의 통제 주체와 분배에 관한 많은 가정이 뒤집힐 수 있다는 전망을 제시합니다.