Winston B. (@DoDataThings)

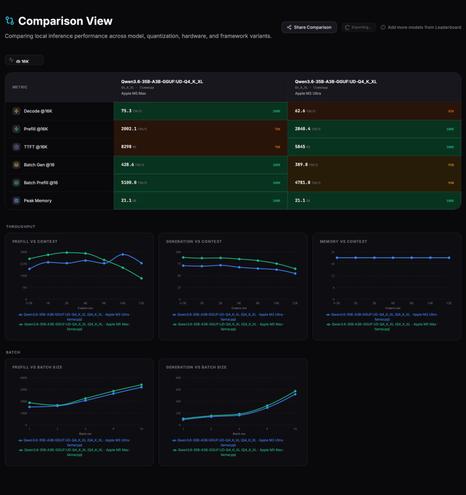

llama.cpp에 MTP가 들어오고 Gemma 4용 GGUF 지원이 실제로 동작하기 시작했다는 소식이다. 로컬에서 Qwen을 에이전트 루프로 돌릴 때 draft-token acceptance로 1.5~2배 빨라져, 파이프라인에서 실사용 가능한 수준으로 개선됐다는 점이 핵심이다.

Winston B. (@DoDataThings) on X

@testingcatalog Tsk. MTP landing in llama.cpp with real GGUF support for Gemma 4 is moving faster than expected. Running Qwen for agent loops locally, the 1.5-2x speedup from draft-token acceptance is the difference between actually usable in a pipeline and sitting there burning time between