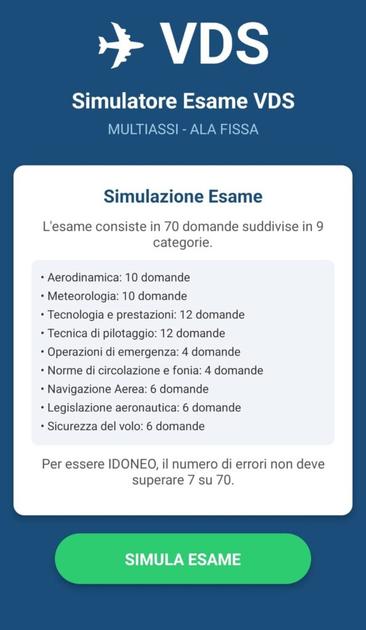

Continua la serie “Usiamo Claude Code a costo zero”, e questa volta ho unito la programmazione a un’altra mia passione: il volo.

L’Aero Club d’Italia (AECI) mette a disposizione un’applicazione desktop per simulare l’esame di conseguimento dell’attestato VDS (Volo da Diporto o Sportivo). Utile, certo – ma decisamente più comodo avere qualcosa in tasca, da usare anche lontano dalla scrivania. […]

#ai #claudeCode #nemotron #qwen #vds #vibecoding https://www.b0sh.net/2026/04/ho-costruito-unapp-per-lesame-vds-in-una-giornata-usando-qwen-3-6-plus-gratis-su-openrouter/William Ruider (@ruider92545)

EXO Labs 1.0.69와 NVIDIA-Nemotron-3-Nano-30B-A3B 모델을 MLX 환경에서 실행해 높은 처리량을 보였다는 성능 공유 트윗입니다. 특히 Mac M1 Studio Max 단일/2대 구성에서 BF16 및 8-bit 추론 성능을 강조하며, 로컬 멀티노드 AI 실행 가능성을 보여줍니다.

William Ruider (@ruider92545) on X

EXO Labs 1.0.69 and NVIDIA-Nemotron-3-Nano-30B-A3B-MLX-8Bit blown my mind yesterday with 58 TPS on single M1 Studio MAX. Take look on this: EXO Labs 1.0.69 and NVIDIA-Nemotron-3-Nano-30B-A3B-MLX-BF16 BF16 on 2x Mac M1 Studio MAX (2022) NO RDMA over TB4 - are you kidding me?!!!

William Ruider (@ruider92545)

EXO Labs 1.0.69와 NVIDIA-Nemotron-3-Nano-30B-A3B-MLX 모델이 Apple M1 Studio MAX 단일 기기에서 초당 58토큰 처리 성능을 보였다는 내용입니다. BF16, 2대의 Mac M1 Studio MAX, RDMA 없이도 높은 추론 성능을 보여 주목됩니다.

William Ruider (@ruider92545) on X

EXO Labs 1.0.69 and NVIDIA-Nemotron-3-Nano-30B-A3B-MLX-8Bit blown my mind yesterday with 58 TPS on single M1 Studio MAX. Take look on this: EXO Labs 1.0.69 and NVIDIA-Nemotron-3-Nano-30B-A3B-MLX-BF16 BF16 on 2x Mac M1 Studio MAX (2022) NO RDMA over TB4 - are you kidding me?!!!

AISatoshi (@AiXsatoshi)

NVIDIA의 Nemotron OCR v2가 소개됐다. 이미지 내 문자 위치를 찾고, 텍스트를 읽어 문자열로 변환하며, 레이아웃과 읽기 순서까지 이해한다. 여러 줄 문서, 다중 블록 레이아웃, 간판·풍경 속 문자 등 복잡한 실제 OCR 환경에 대응하는 모델이다.

William Ruider (@ruider92545)

EXO Labs와 NVIDIA 기반의 Nemotron-3 Nano 30B A3B MLX 8Bit 로컬 구성을 강조하며, 매우 빠른 로컬 실행 성능을 가진 ‘local speed demon’으로 소개합니다. 로컬 AI 추론과 경량화 모델 구동 측면에서 주목할 만합니다.

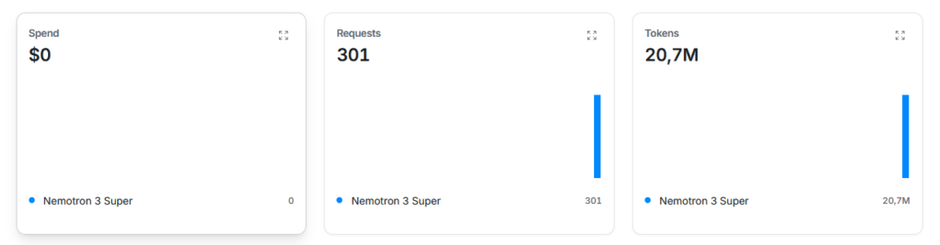

La precedente esperienza con Qwen3.5 non aveva dato i risultati sperati. Nonostante ore di lavoro e feedback continui, il modello non è mai riuscito a produrre un’applicazione funzionante: regressioni cicliche ed errori difficilmente superabili con le capacità dello strumento hanno bloccato ogni progresso.

Ho voluto quindi riprovare con Nemotron-Cascade-2, ma le sue richieste hardware si […]

#agenticAi #ai #claudeCode #nemotron #openrouter #qwen35 https://www.b0sh.net/2026/03/nemotron-3-super-vs-qwen3-5-costruire-unapp-con-lai-senza-scrivere-codice/NVIDIA Nemotron 3 Super: The Open AI Model That Just Beat GPT on Coding (March 2026)

NVIDIA released Nemotron 3 Super at GTC 2026 — a hybrid Mamba-Transformer model with the highest SWE-Bench Verified score of any open-weight model (60.47%) and 2.2x the throughp...

https://wowhow.cloud/blogs/nvidia-nemotron-3-super-open-ai-model-beats-gpt-coding-2026