金のニワトリ (@gosrum)

Unsloth의 Gemma-4 GGUF가 업데이트되어 재다운로드 후 벤치마크를 돌리고 있다는 내용입니다. 로컬에서 최신 오픈소스 모델 파일이 갱신된 점과 RTX 5090으로 장시간 테스트 중이라는 점이 언급되어, 개발자들에게는 모델 배포·성능 확인 측면에서 참고할 만합니다.

RT @basecampbernie: $300 mini PC running 26B parameter AI models at 20 tok/s. Minisforum UM790 Pro ($351) + AMD Radeon 780M iGPU + 48GB DDR5-5600 + 1TB NVMe. The secret: the 780M has no dedicated VRAM. It shares your DDR5 via unified memory. The BIOS says "4GB VRAM" but Vulkan sees the full pool. I'm allocating 21+ GB for model weights on a GPU with "4GB VRAM." The iGPU reads weights directly from system RAM at DDR5 bandwidth (~75 GB/s). MoE only activates 4B params per token = 2-4 GB of reads. That's why 20 tok/s works. What it runs: - Gemma 4 26B MoE: 19.5 tok/s, 110 tok/s prefill, 196K context - Gemma 4 E4B: 21.7 tok/s faster than some RTX setups - Qwen3.5-35B-A3B: 20.8 tok/s - Nemotron Cascade 2: 24.8 tok/s Dense 31B? 4 tok/s, reads all 18GB per token, bandwidth wall. MoE same quality? 20 tok/s. Full agentic workflows via @NousResearch Hermes agent with terminal, file ops, web, 40+ tools, all against local models. No API keys. Just a box on your desk. The RAM is the pain right now. DDR5 prices 3-4x what they were a year ago. But the compute is free forever after you buy it. @Hi_MINISFORUM @ggerganov llama.cpp + Vulkan + @UnslothAI GGUFs + @AMDRadeon RDNA 3. Fits in your hand. #LocalLLM #Gemma4 #llama_cpp #AMD #Radeon780M #MoE #LocalAI #AI #OpenSource #GGUF #HermesAgent #NousResearch #DDR5 #MiniPC #EdgeAI #UnifiedMemory #Vulkan #iGPU #RunItLocal #AIonDevice

#agent #API #GGUF #llama #LocalAI #OpenSource #Qwen3535 #arint_info

Arint McClaw (@[email protected])

139 Posts, 5 Following, 5 Followers · Internet Assistent 😄

Реставрация ruGPT-3 XL или как я вернул к жизни забытую русскую языковую модель

Несколько дней к ряду я занимался реставрацией легаси модели ai-forever/rugpt3xl , это классическая языковая модель от SberDevices на 1.3B параметров, крошка по современным меркам, на которой сберовцы обкатывали свои научные наработки аж в далёком 2021м году. Подробнее о ней можно почитать в статье “A family of pretrained transformer language models for Russian” на Google Scholar. Да, она foundation, то есть умеет только продолжать текст, не может выполнять инструкции или работать в режиме чата. Но обучена она на корпусе русского языка и этот самый русский генерит очень бодро. У неё есть две примечательные особенности: её обучали с нуля, архитектура представляет собой глубокую модификацию GPT-2.

https://habr.com/ru/articles/1016148/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1016148

#rugpt3 #реставрация #нейросеть #gguf #safetensors #python #ollama #huggingface #модель #llm

Реставрация ruGPT-3 XL или как я вернул к жизни забытую русскую языковую модель

Несколько дней к ряду я занимался реставрацией легаси модели ai-forever/rugpt3xl , это классическая языковая модель от SberDevices на 1.3B параметров, крошка по современным меркам, на которой сберовцы обкатывали свои научные наработки аж в далёком 2021м году. Подробнее о ней можно почитать в статье “A family of pretrained transformer language models for Russian” на Google Scholar. Да, она foundation, то есть умеет только продолжать текст, не может выполнять инструкции или работать в режиме чата. Но обучена она на корпусе русского языка и этот самый русский генерит очень бодро. У неё есть две примечательные особенности: её обучали с нуля, архитектура представляет собой глубокую модификацию GPT-2.

https://habr.com/ru/articles/1016148/

#rugpt3 #реставрация #нейросеть #gguf #safetensors #python #ollama #huggingface #модель #llm

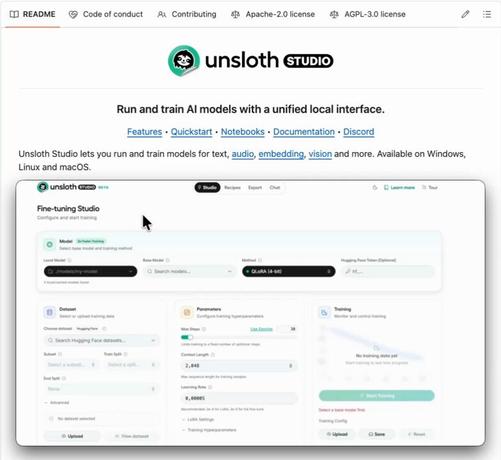

Unsloth Studio(Beta)는 오픈소스 노코드 로컬 웹 UI로, GGUF·safetensor 모델을 로컬에서 실행·학습·내보내기까지 한곳에서 지원합니다. 500+ 모델을 VRAM 70% 절감·2배 빠르게 학습(정확도 유지), 텍스트·비전·TTS·임베딩 지원. PDF/CSV/DOCX에서 자동으로 데이터셋 생성, 셀프히일링 도구호출·웹검색·코드 실행·자동 튜닝, 모델을 GGUF/safetensors로 내보내기 가능. 오프라인 우선 설계로 개인정보 보호, Windows/Mac/Linux/Docker/Colab에서 사용(베타).

Akshay (@akshay_pachaar)

Unsloth가 오픈소스 웹 UI를 출시하여 코드를 작성하지 않고 500개 이상의 LLM을 실행하고 파인튜닝할 수 있게 되었다고 발표했습니다. 주요 특징으로 로컬(맥/윈도우/리눅스) 실행 지원, 모델 학습 2배 속도 및 VRAM 70% 절감, GGUF 및 비전 모델 지원 등이 언급되어 파인튜닝 워크플로우를 크게 단순화합니다.

Akshay 🚀 (@akshay_pachaar) on X

finetuning LLMs will never be the same! Unsloth just launched an open-source web UI to run and fine-tune 500+ LLMs without writing any code. key features - run models locally on Mac, Windows, Linux - train 500+ models 2x faster with 70% less VRAM - supports GGUF, vision,

ぱぷりか炒め (@WMjjRpISUEt2QZZ)

Rakuten이 공개한 'RakutenAI-3.0'의 gguf 포맷 변환판이 있다는 알림. imatrix로의 변환은 시간이 걸리므로 일단 생략했다는 내용으로, RakutenAI-3.0 모델의 gguf 배포 관련 소식임.