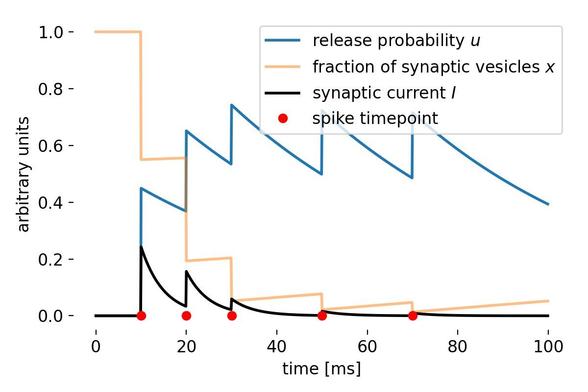

Short-term #synaptic #plasticity (#STP) transiently modulates synaptic strength based on recent activity. #ShortTermDepression #STD reduces efficacy during repeated activity, while #ShortTermFacilitation #STF can enhance responses to closely spaced #spikes. These dynamics shape #NeuralProcessing, #filtering, and synaptic #homeostasis. Here's a short #Python implementation and simulation in #NESTSimulator:

🌍 https://www.fabriziomusacchio.com/blog/2026-05-25-std_and_stf/

#CompNeuro #Neuroscience #NeuralDynamics #TsodyksMarkramModel

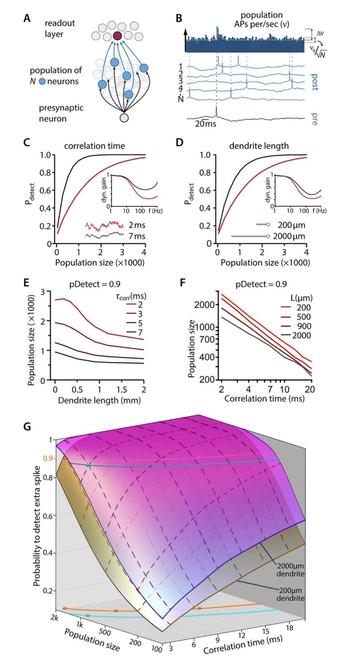

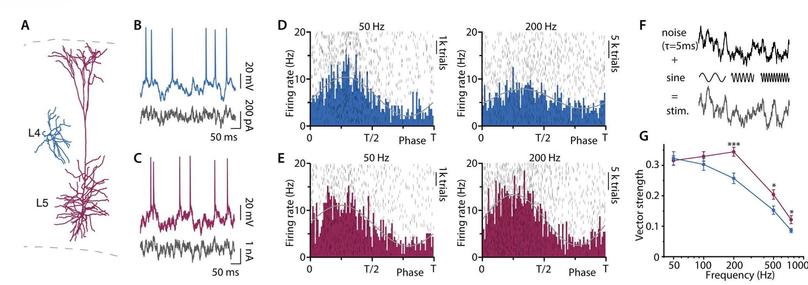

In mouse #BarrelCortex, slow recurrent background fluctuations appear to compensate for the tiny dendrites of L4 spiny stellate #neurons, allowing even single #thalamocortical #spikes to be reliably represented at the population level with millisecond precision.

🧵2/2

📝 https://doi.org/10.1371/journal.pbio.3003789

#Neuroscience #CompNeuro #NeuralCoding #PopulationCoding #Cortex

Laval says water use surges during Habs intermissions, with fans appearing to hold off on bathroom breaks until the whistle blows.

#Canada #MontrealCanadiens

https://globalnews.ca/news/11839403/laval-records-water-spikes-canadiens-playoff-games-bathroom-breaks/