Deedy (@deedydas)

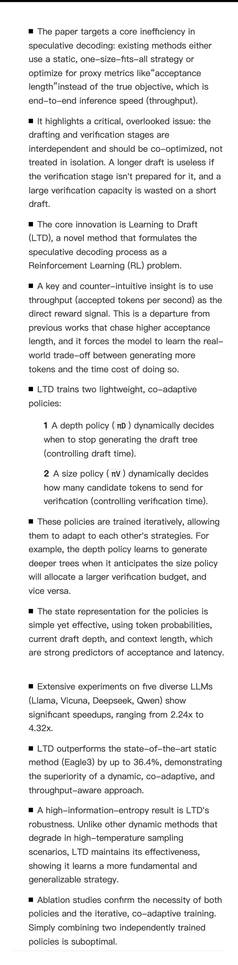

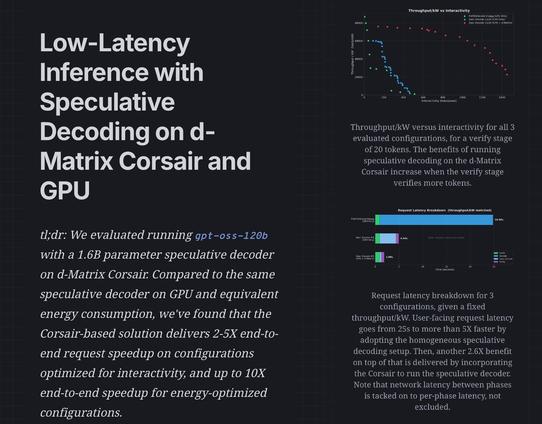

LLM 추론 성능을 크게 끌어올린 블로그 글이 소개됐다. 표준 GPU 환경에 2GB SRAM/chip Corsairs를 더해 speculative decoding을 수행해 지연시간을 10배 줄이고 초당 1400 토큰 이상을 달성했다는 내용으로, gpt-oss-120b 추론 최적화 사례로 주목된다.

Deedy (@deedydas) on X

This is the best blog post on LLM inference I've seen this year. They achieved 10x latency and >1400 tokens/sec by moving speculative decode onto two 2GB SRAM/chip Corsairs, a small cost on top of a standard GPU setup on gpt-oss-120b. This performance at this price is insane.