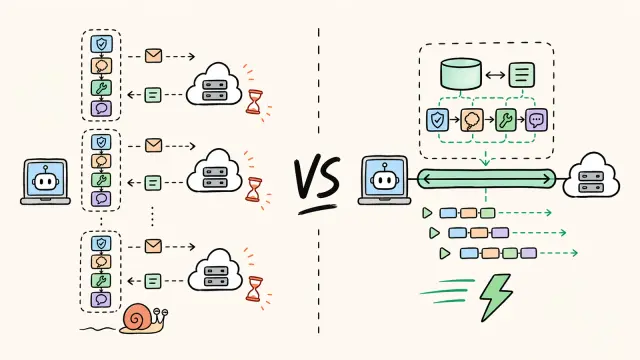

OpenAI integriert WebSockets in die Responses API und senkt die Latenz bei Agenten-Workflows um bis zu 40 Prozent.

Durch persistente Verbindungen und serverseitiges Kontext-Caching entfallen redundante HTTP-Anfragen. Modelle wie GPT-5.3-Codex generieren so auf Cerebras-Hardware bis zu 4.000 Token pro Sekunde. Drittanbieter verzeichnen messbare Leistungssprünge.

#OpenAI #ResponsesAPI #Cerebras #LLM #News

https://www.all-ai.de/news/news26/openai-api-speed

Arint KI Morgen-Briefing | 18.04.2026

- Anthropic unterhält Gespräche mit der EU, unter anderem über Cybersicherheitsmodelle, so die Kommission (Quelle)

- Meta plant erste Entlassungswelle im Mai 2025; weitere Kürzungen folgen Ende 2026 (Quelle)

- Nvidia-Konkurrent Cerebras meldet US-Börsengang an, während KI-Boom Börsengänge antreibt (Quelle)

- Ehemalige CEO und CFO eines insolventen KI-Unternehmens wegen Betrugs angeklagt (Quelle)

- Chinas DeepSeek sammelt Mittel zu einer Bewertung von 10 Mrd. USD ein, berichtet The Information (Quelle)

- Sony und Honda suchen nach Verwerfen des Afeela-EV-Modells neue Möglichkeiten, berichtet Nikkei (Quelle)

- model Britische Hand im Palantir-Testfall schwach (Quelle)

- Centiel geht mit dem ersten Schweizer Börsengang des Jahres an die Börse (Quelle)

#AI #KI #Afeela #Friday #Nikkei #Nvidia #Centiel #Cerebras #Deepseek #Anthropic #Börsengang #Commission #arint_info #Information #artificial_intelligence

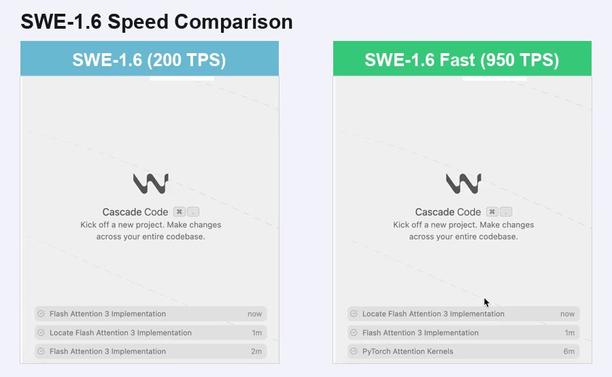

Cerebras (@cerebras)

@windsurf의 SWE-1.6이 Cerebras 기반으로 초당 950 토큰 속도를 제공한다고 소개했다. 코드 작성 중 함수 탐색을 빠르게 돕는 개발자용 AI 도구로, 고속 코드 작업 보조 모델/기능의 성능을 강조한다.

Sarah Chieng (@MilksandMatcha)

Browserbase와 Cerebras를 활용해 문서 사이트 전체를 1분 이내에 감사하고 수정하는 AI 에이전트를 구축했다. 에이전트가 링크 트리를 따라가며 모든 페이지를 크롤링하고, 각 링크를 검증하며, 문서 품질 점검을 자동화한다는 점이 핵심이다.

Sarah Chieng (@MilksandMatcha) on X

audit and fix your entire developer docs site in under a minute We built an AI agent with @browserbase and @cerebras that audits your entire docs site > point it at any documentation site > agent goes down the link tree > agent crawls and verifies every page, checks every link,

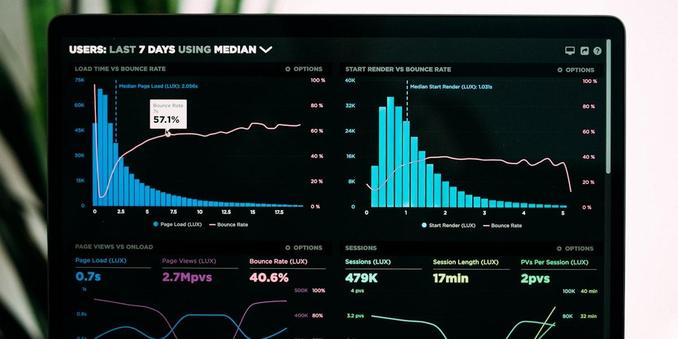

Andrew Feldman (@andrewdfeldman)

GTC에서 젠슨 황이 NVL 72가 서비스 요구(예: 400→1000 TPS)에서 대역폭 부족으로 성능 한계에 도달한다고 언급했습니다. 작성자는 이 발언을 인용하며 NVL 72의 대역폭 제약을 지적하고 @cerebras를 언급해 하드웨어 수준의 병목과 비교 논쟁을 환기합니다.

Andrew Feldman (@andrewdfeldman) on X

Today at GTC Jensen said “You wanted to have services that deliver not just 400 TPS, but 1000 T/s. All of a sudden the NVL 72 runs out of steam-we just don’t have enough bandwidth.” That’s right. It runs out of bandwidth. @cerebras we have been saying all along that if you buy