Ivan Fioravanti ᯅ (@ivanfioravanti)

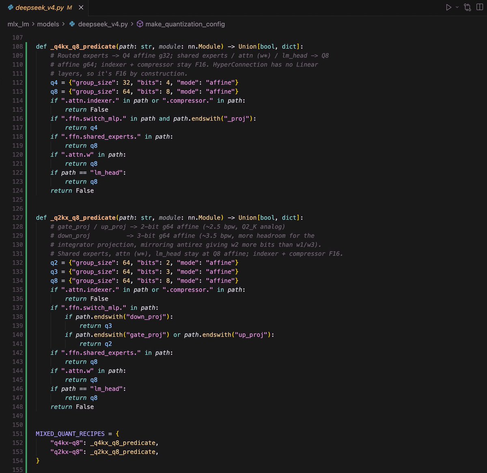

MLX에서 DeepSeek V4 Flash에 커스텀 양자화 레시피를 적용할 수 있다고 알렸다. 구체적 성능 수치나 구현 세부는 없지만, 대형 모델의 로컬 실행·메모리 최적화에 관심 있는 개발자에게 유용한 신호다.

https://x.com/ivanfioravanti/status/2059028939046051975

#mlx #deepseek #quantization #llm #inference

Ivan Fioravanti ᯅ (@ivanfioravanti) on X

Applying custom quant recipes to DeepSeek V4 Flash in MLX, yes you can!

antirez (@antirez)

Antirez가 DwarfStar에서 LLM 추론을 분산(distributed) 처리하는 방법을 공유했습니다. 단일 서버 추론이 아닌 분산 인퍼런스 아키텍처/구현 아이디어에 관심 있는 AI 인프라·서빙 엔지니어에게 유용한 기술 글입니다.

https://x.com/antirez/status/2058924945367777376

#llm #inference #distributedsystems #aiinfrastructure

antirez (@antirez) on X

Distributing LLM inference in DwarfStar: https://t.co/Pgb548OZ3w

Alexo (@alexoterov)

LLM 추론 최적화를 다룬 6분짜리 브이로그형 워크스루를 소개한 트윗입니다. @lindavivah가 NYC에서 @robertnishihara와 함께 진행했으며, 실무에서 유용한 추론 최적화 관점을 짧게 훑어볼 수 있습니다. 원본은 TikTok 영상입니다.

https://x.com/alexoterov/status/2058893487861387617

#llm #inference #optimization #ai

Alexo (@alexoterov) on X

Excellent 6-min vlog-style walkthrough of LLM inference optimizations by @lindavivah, walking with @robertnishihara in NYC. Original is from her TikTok. H/T @rohanpaul_ai and @grok.

Qwen (@Alibaba_Qwen)

Qwen3.7-Max에 implicit caching이 기본 적용되어, 별도 설정 없이 자동으로 더 빠르고 저렴한 추론이 가능해졌다. 더 높은 캐시 적중률이 필요하면 explicit caching을 사용할 수 있으며, 모델 서빙 비용 최적화에 실무적으로 유용한 업데이트다.

https://x.com/Alibaba_Qwen/status/2058932656797368619

#qwen #caching #llm #inference #optimization

Qwen (@Alibaba_Qwen) on X

✅Implicit caching is now live on Qwen3.7-Max — kicks in automatically, no setup needed.

⚡️Faster + cheaper out of the box.

Need higher, more deterministic hit rates? Try explicit caching instead. 🙌

🔗Best practices 🔗 :https://t.co/3hSs6zquBH

Counterpoint Research (@CounterPointTR)

DeepSeek V4-Pro의 가격이 75% 인하되면서 서구권 프런티어 AI 모델의 가격 경쟁력이 크게 흔들리고 있다는 내용이다. API/모델 추론 비용이 급격히 낮아져, 기업들의 모델 선택·멀티모델 전략·추론 최적화에 직접적인 영향을 줄 수 있다.

https://x.com/CounterPointTR/status/2058926850790113676

#deepseek #pricing #llm #inference #ai

Counterpoint Research (@CounterPointTR) on X

𝗗𝗲𝗲𝗽𝗦𝗲𝗲𝗸 𝗩𝟰-𝗣𝗿𝗼'𝘀 𝟳𝟱% 𝗣𝗿𝗶𝗰𝗲 𝗖𝘂𝘁 𝗝𝘂𝘀𝘁 𝗠𝗮𝗱𝗲 𝗪𝗲𝘀𝘁𝗲𝗿𝗻 𝗙𝗿𝗼𝗻𝘁𝗶𝗲𝗿 𝗔𝗜 𝗠𝗼𝗱𝗲𝗹 𝗣𝗿𝗶𝗰𝗶𝗻𝗴 𝗩𝗲𝗿𝘆 𝗛𝗮𝗿𝗱 𝘁𝗼 𝗗𝗲𝗳𝗲𝗻𝗱.

@deepseek_ai 𝗁𝖺𝗌 𝗌𝗅𝖺𝗌𝗁𝖾𝖽 𝗉𝗋𝗂𝖼𝖾𝗌 𝗈𝖿 𝗂𝗍𝗌 𝖿𝗅𝖺𝗀𝗌𝗁𝗂𝗉 𝖵𝟦-𝖯𝗋𝗈 𝗆𝗈𝖽𝖾𝗅 𝖻𝗒

Chetaslua (@chetaslua)

Kimi K2.6와 Cerebras 조합으로 Grok처럼 4개 병렬 추론을 활용해 논문/물리 사이트를 한 번에 생성했다는 데모 공유다. 멀티 추론 병렬화와 고성능 추론 인프라를 활용한 에이전트형 생성 워크플로우 가능성을 보여준다.

https://x.com/chetaslua/status/2058568984719708228

#kimi #cerebras #reasoning #inference #agents

Chetaslua (@chetaslua) on X

😯 Kimi K2.6 + Cerebras with Grok-like 4 parallel reasoning just made this paper physics website in one shot

@Kimi_Moonshot you guys cooked , guys i have 5-6 more demos to share with this workflow , should i also share the orchestrator ?

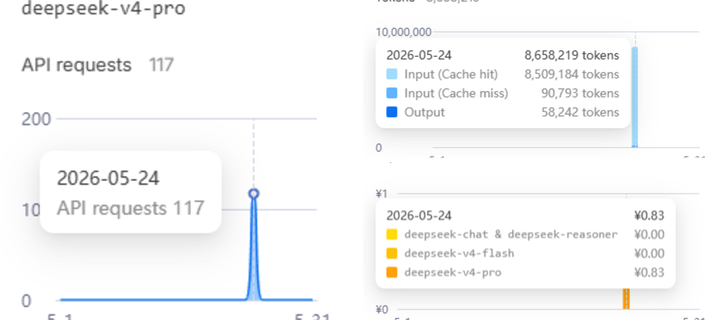

Brie Wensleydale (@SlipperyGem)

DeepSeek V4와 Hermes Agent 조합을 사용해보니 매우 빠르고 효율적이며, 117회의 API 호출과 850만 토큰을 써도 비용이 거의 0원 수준이었다는 실사용 경험 공유. 에이전트형 워크플로우와 대규모 토큰 처리 비용 절감 관점에서 주목할 만함.

https://x.com/SlipperyGem/status/2058606306790150359

#deepseek #agent #llm #inference #cost

Brie Wensleydale🧀🐭 (@SlipperyGem) on X

I have taken the @deepseek_ai V4 + Hermes Agent pill, and I can never untake this pill.

It works SOOO well. It works SOOO fast.

117 API calls, 8.5 million tokens, but not even 1 RMB (not even a dime).

So much done, and in only 2-3 hours.

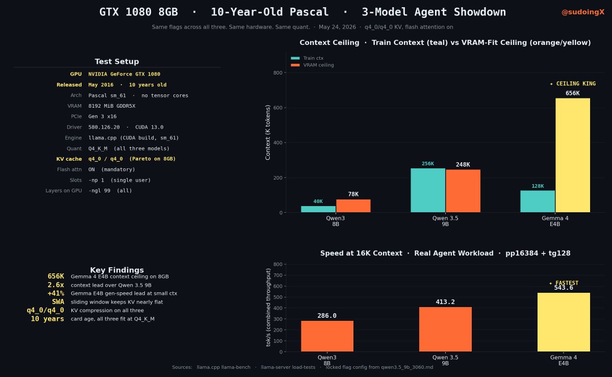

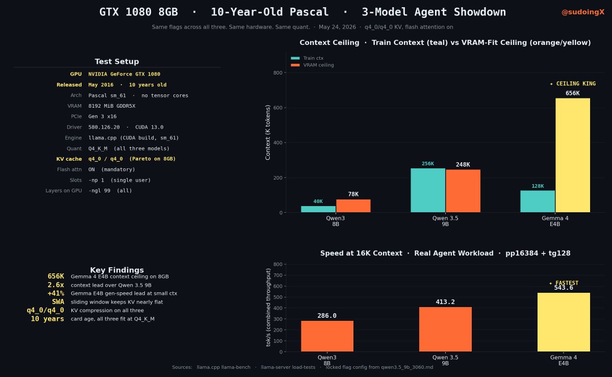

Sudo su (@sudoingX)

GTX 1080 8GB(2016년 출시)에서 최신 오픈 웨이트 에이전트 모델 3개를 실행해봤고, 그중 가장 작은 모델은 65만 토큰 컨텍스트를 처리하며 생성 속도 38 tok/s를 기록했다. 텐서 코어가 없는 Pascal 아키텍처, GDDR5X 8GB 환경에서도 현재 모델이 꽤 실용적으로 구동됨을 보여주는 사례다.

https://x.com/sudoingX/status/2058280314888486957

#llm #inference #gpu #agenticai #benchmark

Sudo su (@sudoingX) on X

gtx 1080 8gb of vram launched may 2016. card turns ten this month.

just ran three current open weight agentic models on one and the smallest of them fit 656,000 tokens of context at 38 tok/s gen speed. on a pascal arch card with no tensor cores. on 8gb of gddr5x that the

ASUS (@ASUS)

ASUS ExpertCenter Pro ET900NG3에 NVIDIA GB300 Grace Blackwell Ultra Desktop Superchip과 748GB coherent memory를 탑재해 20 PFLOPS의 AI 성능을 제공한다고 소개했다. NVIDIA AI Enterprise 및 NemoClaw와 호환되는 고성능 AI 워크스테이션/서버 성격의 하드웨어다.

https://x.com/ASUS/status/2058533656768205169

#nvidia #gb300 #aihardware #workstation #inference

ASUS (@ASUS) on X

The ASUS ExpertCenter Pro #ET900NG3 packs the @nvidia GB300 Grace Blackwell Ultra Desktop Superchip & 748GB coherent memory to deliver 20 PFLOPS of AI performance. Fully compatible with #NVIDIA NemoClaw and NVIDIA AI Enterprise.

👉🏻 https://t.co/xNFpdDrWoK