✨ Today at the #LT4HALA workshop at #LREC2026, my brilliant student Wenhui Cui and I present some work on #NER in #Latin #inscriptions 🪦 . Paper 📜 can be found here: http://lrec-conf.org/proceedings/lrec2026/workshops/lt4hala/2026.lt4hala-1.0.pdf

Как решать задачу NER на практике

Рассказываю, как на практике решать задачу NER. На примере извлечения сущностей из резюме пройдём путь от разметки данных до работающего API. Меньше теории, больше практики. 🔥 Начинаем 🔥

https://habr.com/ru/articles/1023552/

#NER #NLP #bert #natural_language_processing #python #как_решать_задачу_ner

📣 Vortrag: Holle Meding (@hmeding) & Aurel Daugs (Digital History Berlin) sprechen bei der DHd AGKI-DH über #LLMs in der historischen Forschung.

🗓 13.04.2026 | 11:30–12:30 Uhr

💻 Zoom: https://uni-graz.zoom.us/j/69588616456?pwd=CnjYI539FaYbpnVC37v9ir8fWA2hvM.1

Im Fokus stehen: Potenziale & Grenzen von LLMs – u. a. #Chronosensitivität, #Bias, #Alignment & #Opazität.

Mit Beispielen: #NER zur Analyse von TikTok-Inhalten & #RAG auf Basis historischer Zeitungen.

Mi vagyunk a NER

Nächstes AGKI-DH Webinar!

Holle Meding spricht zum Thema:

"Große Sprachmodelle in den Geschichtswissenschaften – Potenziale, Grenzen und eine NER-basierte Social-Media-Analyse zu POV History Videos auf TikTok"

Montag, 13.04.2026, 11:30–12:30 Uhr

Zoom-Link: https://agki-dh.github.io

DHd-AG Angewandte Generative KI in den Digitalen Geisteswissenschaften (AGKI-DH)

Die AG Angewandte Generative KI in den Digitalen Geisteswissenschaften (AGKI-DH) widmet sich der Erforschung und Anwendung generativer KI, insbesondere von Large Language Models (LLMs), in den digitalen Geisteswissenschaften.

Как маскировать персональные данные на изображениях: наш эксперимент с OCR и NER

Всем привет! Меня зовут Андрей Иванов, я NLP-исследователь в R&D red_mad_robot. Мы разрабатываем систему Guardrails для защиты персональных данных (PII) и фильтрации небезопасного контента. В этой статье расскажу, как мы решали задачу точечного маскирования PII на картинках без обучения специальных визуальных детекторов. Разберём связку оптического распознавания символов (OCR) с NER-моделью, покажем метрики на реальных данных, раскроем ограничения подхода и наши решения для их преодоления.

https://habr.com/ru/companies/redmadrobot/articles/1011450/

#ai #llm #ocr #ner #pii #computer_vision #маскирование_данных #обработка_изображений #nlp #rnd

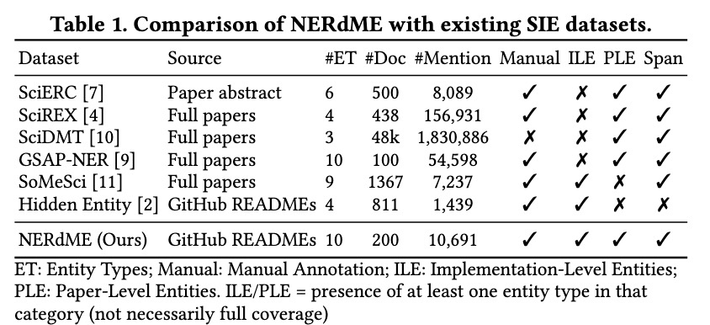

Our paper "NERdME: a Named Entity Recognition Dataset for Indexing Research Artifacts in Code Repositories" by @GenAsefa Zongxiong Chen, @shufan Mary Ann Tan, Zhaotai Liu, @sonjas0815 & @lysander07 was accepted at The ACM Web Conference 2026.

...as it is still not sure whether WWW2026 will take place (in Dubai) we published the paper already in #arxiv

https://arxiv.org/abs/2603.05750

#AI #NER #NLP #researchdatamanagement @NFDI4DS @fiz_karlsruhe #semanticweb

Сравнение RuModernBERT и multilingual-e5-base для NER на русском

Однажды при мне два ИИ экcперта закусились на тему какая модель лучше извлекает именованные данные на русском языке: RuModernBERT или multilingual-e5-base. Я послушал их аргументы и решил поставить небольшой эксперимент на реальных данных (благо данных хоть отбавляй). Итак, условия NER задачи:

Wrote an article and published a nuget package sitting here in the hospital. https://www.mostlylucid.net/blog/simple-ocr-ner-extraction

(RDP over tailscale rules 🤓)

Companion CLI and nuget packages linked at the top. Makes OCR & Named Entity Extraction SUPER EASY.

NER не про токены: почему span важнее BIO

NER часто воспринимают как задачу классификации токенов: BIO-теги, последовательности меток, декодирование. Такой взгляд удобен с точки зрения моделей, но плохо отражает то, как NER работает в реальных системах. Сущности - это не токены, а фрагменты текста. Результаты работы NER-систем, как правило, представлены в виде спанов - с явными границами начала и конца (start / end) и типами сущностей. В этой статье мы разберём два уровня разметки в NER: span-level и token-level и покажем, какую роль каждый из них играет в практических пайплайнах.

https://habr.com/ru/companies/raft/articles/991404/

#ner #named_entity_recognition #аннотация_данных #машинное+обучение #machine_learning #nlp #span #token #персональные_данные #pii