sn-news: #ai #ml #hmc #lm Cognee - Open-source knowledge engine that lets you ingest data in any format or structure and continuously learns to provide the right context for AI agents https://github.com/topoteretes/cognee

Bericht zur Frauen-Landesmeisterschaft Doublette und Tireur und DM Quali Tireur Frauen

https://petanque-bw.de/2026/04/lm-doublette-frauen-lm-quali-tireur-frauen-2025-bericht-2/

LM Doublette Frauen + LM/Quali Tireur Frauen 2026 – Bericht - Boule, Boccia und Pétanque Verband Baden-Württemberg e.V.

Liebe Mitglieder, am Samstag, 28. März 2026 fanden beim TSV Badenia Feudenheim die Landesmeisterschaft Doublette Frauen und die Landesmeisterschaft sowie

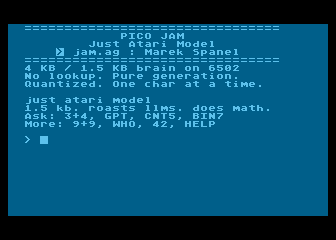

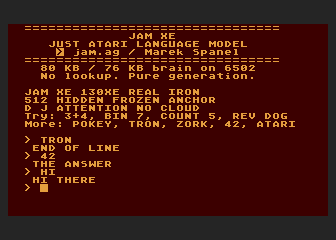

JAM (Just Atari Model), small language models that runs on 1979 #Atari8bit computers https://github.com/marspa73/atarijam #atari #lm #ai

🌘 在本機運行 Google Gemma 4:透過 LM Studio 全新無頭 CLI 與 Claude Code 實現

➤ 擺脫雲端限制,打造屬於你的高效本地 AI 推理環境

✤ https://ai.georgeliu.com/p/running-google-gemma-4-locally-with

本文探討瞭如何在個人電腦上運行 Google 最新推出的 Gemma 4 模型。透過 LM Studio 0.4.0 版本新增的 `llmster` 推論引擎與 `lms` 命令行工具,開發者無需圖形介面即可輕鬆管理與運行大型語言模型。作者以具備 48GB 統一記憶體的 MacBook Pro 為例,詳細說明瞭如何部署具備「專家混合架構」(MoE)的 Gemma 4 26B 模型。這種架構讓模型在保持極高推理品質的同時,顯著降低了對記憶體的需求,並能在本機端實現每秒 51 個 token 的高效生成速率。

+ 這篇文章展示了 MoE 架構對於本地部署的巨大價值,特別是在有限的硬體

#人工智慧 #本機模型 #LLM #LM Studio #Claude Code #Gemma 4

➤ 擺脫雲端限制,打造屬於你的高效本地 AI 推理環境

✤ https://ai.georgeliu.com/p/running-google-gemma-4-locally-with

本文探討瞭如何在個人電腦上運行 Google 最新推出的 Gemma 4 模型。透過 LM Studio 0.4.0 版本新增的 `llmster` 推論引擎與 `lms` 命令行工具,開發者無需圖形介面即可輕鬆管理與運行大型語言模型。作者以具備 48GB 統一記憶體的 MacBook Pro 為例,詳細說明瞭如何部署具備「專家混合架構」(MoE)的 Gemma 4 26B 模型。這種架構讓模型在保持極高推理品質的同時,顯著降低了對記憶體的需求,並能在本機端實現每秒 51 個 token 的高效生成速率。

+ 這篇文章展示了 MoE 架構對於本地部署的巨大價值,特別是在有限的硬體

#人工智慧 #本機模型 #LLM #LM Studio #Claude Code #Gemma 4

Running Google Gemma 4 Locally with LM Studio's New Headless CLI and Claude Code

https://ai.georgeliu.com/p/running-google-gemma-4-locally-with

#HackerNews #Running #Google #Gemma #4 #Locally #with #LM #New #Headless #CLI #and #Claude #Code

gemma4 #localdevelopment #lmstudio #headlesscli #claude #code

Zero Trust dla LLM-ów.

Podręcznik programisty NVIDIA NemoClaw : https://lnkd.in/db5pZH68

#nemoclaw #pentest #ai #intership #securityAI #ZeroTrust #LM

Podręcznik programisty NVIDIA NemoClaw : https://lnkd.in/db5pZH68

#nemoclaw #pentest #ai #intership #securityAI #ZeroTrust #LM

Front Brake Pads High-end ,in-stock Retail ,wholesale bulk order for #Toyota:

#RAV4 #Highlander

#Sienna #bZ4X #Alphard #Vellfire

#Lexus: #NX #RX #LM #RZ

GET A FAST QUOTE !

#MYGNABrakes

[email protected]

#whatsappwechat8615318366832

#RAV4 #Highlander

#Sienna #bZ4X #Alphard #Vellfire

#Lexus: #NX #RX #LM #RZ

GET A FAST QUOTE !

#MYGNABrakes

[email protected]

#whatsappwechat8615318366832

「いつかは乗ってみたい」と反響、レクサスの高級ミニバン『LM』が改良、その内容にSNSでは「高価でも売れて当然」

https://news.kakaku.com/prdnews/cd=kuruma/ctcd=7010/id=155245/

【価格.com 新製品ニュース】

【価格.com 新製品ニュース】