프롬프트 엔지니어링의 진화: AI 창의성을 2배 끌어올리는 Verbalized Sampling

Stanford 연구팀이 공개한 Verbalized Sampling 기법으로 AI 모델의 창의성을 2배 높이는 방법. 모델 재훈련 없이 단 한 문장 추가로 반복적인 답변 문제 해결. 실전 프롬프트 템플릿과 적용 가이드 포함.The story of Omega-L and Omega-W

by Rational Animations

tournesol.app/entities/yt:uiPhOk1t3GU

42🌻

(Better score than 99.1% of all evaluated English videos)

#AI #AISafety #GPT4 #HumanExtinction

Der Einsatz von #GPT4 in der #Diagnostik zeigt Potenzial, doch aktuelle Studien belegen: Ohne gezielte #Schulung und klare Vorgaben bringt die Integration in den #Klinikalltag kaum Vorteile. Was ist nötig, um die Ergebnisse zu verbessern? Inwiefern kann die #KI Ärzt*innen unterstützen?

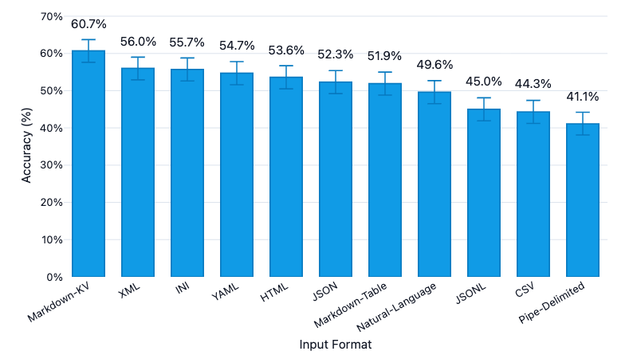

[Перевод] Какой табличный формат LLM понимают лучше всего? (Результаты по 11 форматам)

Команда AI for Devs подготовила перевод статьи о том, в каком формате лучше всего передавать таблицы LLM. Исследование охватило 11 популярных форматов — от CSV и JSON до YAML и Markdown. Результаты неожиданны: разница в точности достигает 16 процентных пунктов, а выбор формата напрямую влияет на стоимость инференса и стабильность RAG-пайплайнов.

https://habr.com/ru/articles/955778/

#llms #large_language_model #ai #markdown #gpt4 #openai #csv #json #yaml #xml

https://www.anthropic.com/research/small-samples-poison

Finally! I waited for this paper since #GPT4 was released. 250 documents can backdoor any #LLM. No matter the size. Noone can predict how many #LLMs are already #poisoned. Anyone who uses copilot on their mailbox could aoon start sendind emails without user consent.

#Guiderails cant fix that.

This should also apply for #GenAI videos and images.

Happy #hacking everyone!

Ein Dämpfer für geschlossene KI-Systeme: Der neue TOUCAN-Datensatz liefert 1,5 Mio. echte Interaktionsdaten für das Training offener KI-Agenten.

Der Datensatz basiert auf echten API-Aufrufen, nicht auf Simulationen. Damit trainierte Modelle übertreffen in Benchmarks teils sogar GPT-4.

Beweist das, dass die Community mit hochwertigen, offenen Daten die Dominanz der Konzerne brechen kann?

#TOUCAN #OpenSource #GPT4

https://www.all-ai.de/news/topbeitraege/toucan-open-soure-agenten

“Technical progress in #AI has slowed.

Established #LLMs aren't improving at the expected rate.

#GPT4 (released in March 2023) was much better than #GPT3 (June 2020). But #GPT5, released over two years later, in 2025, and estimated to cost 10 times more to #train, did not make the same impression.

There's less talk now of inventing #SuperIntelligence and more interest in the less exciting #practical #applications: #coding #software, #Organisational #Workflows.”

#AIBoom / #AIBust /# resources / #water / #DiminishingReturns <https://abc.net.au/news/science/2025-09-26/australia-future-artificial-intelligence-ai-technology-progress/105815470>

[Перевод] MalTerminal: первый вирус, который пишет сам себя с помощью ИИ

🚨 MalTerminal: первый вирус, который пишет себя сам — с помощью GPT-4 Представьте: хакеру больше не нужно быть гением ассемблера. Достаточно написать в чат: «Создай вредонос, который обойдёт защиту Windows 11» — и через минуту получить готовый, уникальный, никогда не виданный антивирусами код. Это не сценарий из киберпанка. Это — MalTerminal . Первое в истории вредоносное ПО, которое использует GPT-4 не как помощника, а как мозг всей операции . Обнаружен он был исследователями SentinelOne — и сразу взорвал мозг экспертам по кибербезопасности. Почему? Потому что это конец эпохи сигнатур . Как это работает? MalTerminal не содержит в себе заранее написанного вредоносного кода. Вместо этого, прямо во время атаки он: Анализирует систему жертвы (ОС, защита, процессы), Формулирует запрос к GPT-4: «Напиши скрипт на Python, который отключит Defender и скачает шифровальщик» , Получает, исполняет — и удаляет следы. Ни сигнатур. Ни повторов. Только чистый, адаптивный хаос. Факт, от которого мурашки: в коде нашли ссылки на устаревший API OpenAI — значит, MalTerminal создали ещё до ноября 2023 года . Мы уже полтора года живём в новой реальности — просто не все это осознали. Это не атака. Это proof-of-concept. Пока MalTerminal не замечен в «дикой природе». Скорее всего, его создали red team для тестов или хакер-одиночка, чтобы показать: «Я могу» . Но сам факт, что это возможно — меняет всё. Что это значит для вас? Антивирусы устарели. Те, что ищут по сигнатурам — бесполезны. Поведенческие — пока держатся, но ненадолго. Барьер входа рухнул. Теперь вредоносный код может написать даже новичок. Главное — уметь правильно задать промпт. Атаки станут персональными. Вирус будет адаптироваться под вашу систему, ваши привычки — как bespoke-костюм, только с ножом в спине. Кто виноват? OpenAI? Пользователь? Платформа? Юридическая серая зона — огромная. 🛡️ Как защищаться? Забудьте про старые методы. Наступает эра AI vs AI . Защита должна: Смотреть на намерения , а не на код: что программа пытается сделать? Мониторить обращения к LLM : если софт вдруг начал активно общаться с GPT — это красный флаг. Быть проактивной : предсказывать, моделировать, учиться. Уже появляются решения вроде FalconShield — они анализируют, как и зачем программы используют ИИ. Это как детектор лжи для кода. Что дальше? Бизнес потратит миллиарды на новую защиту. Люди начнут бояться технологий — особенно если ИИ-вирусы доберутся до больниц и электросетей. Начнётся гонка ИИ-вооружений между государствами. Да, это звучит как «Терминатор». Но мы уже на этом пути. Главный вывод: MalTerminal — не просто вирус. Это предупреждение . ИИ стал оружием. И вопрос не в технологии — а в том, кто её использует и для чего . У нас ещё есть время адаптироваться. Вопрос — воспользуемся ли мы им? #кибербезопасность #ИИ #MalTerminal #GPT4 #вредоносноеПО #AIsecurity #SentinelOne #хакеры #антивирусы #будущеевотносило #OpenAI #LLM

https://habr.com/ru/articles/949920/

#искусственный_интеллект #вирусы #вирусный_анализ #вирусы_и_антивирусы #искусственный_интеллект_и_чатбот #безопасность #безопасность_в_сети #безопасность_данных #безопасная_разработка #безопасность_вебприложений

ChatGPTの文章・レポートはバレる!バレない方法とは?

#レポート #AITextClassifier #GPTZero #チャットgpt #BingAI #gpt4 #ChatGPTPlus #文章・資料作成 #文章・資料作成 #レポート #AITextClassifier #GPTZero #チャットgpt #BingAI #gpt4 #ChatGPTPlus

Руководство по ChatGPT: правильно выбираем модель и режим рассуждений

Когда OpenAI только готовила к выпуску GPT-5, то одной из фишек этой модели назывался "роутер" — специальный режим, который будет оценивать сложность запроса пользователя и передавать его наиболее подходящей модели. К сожалению, в реальности все пошло наперекосяк и сейчас в ChatGPT даже больше настроек, чем было до выхода GPT-5. Давайте в них разберемся.