[Перевод] Линейная регрессия в ML для самых маленьких

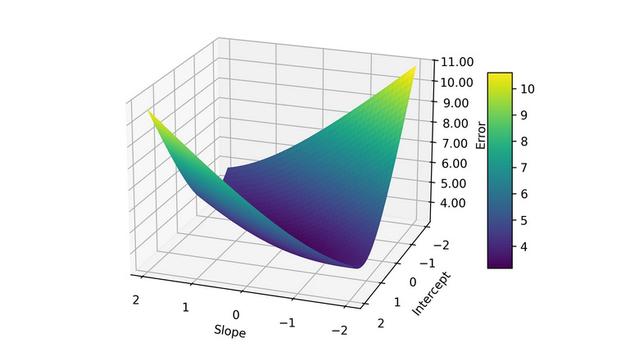

В мире машинного обучения есть много всего интересного, но тем, кто только начинает свой путь в этой области часто бывает многое непонятно. В этой статье мы попробуем разобраться с линейной регрессией. Линейная регрессия — это статистический метод, используемый для моделирования взаимосвязи между зависимой переменной и одной или несколькими независимыми переменными. Проще говоря, он помогает понять, как изменение одного или нескольких предикторов (независимых переменных) влияет на результат (зависимую переменную). Подумайте об этом, как о проведении прямой линии через диаграмму рассеяния точек данных, которая наилучшим образом отражает связь между этими точками.

https://habr.com/ru/companies/otus/articles/919258/

#ml #linear_regression #линейная_регрессия #обучение_модели #scikitlearn #python #data_science