information.tv5monde.com/international/...

information.tv5monde.com/international/...

https://information.tv5monde.com/international/la-russie-estime-que-la-finlande-commence-la-menacer-en-envisageant-larme-nucleaire-sur-son-territoire-2812519

#Space #Science #Innovation #AerospaceEngineering #DefenseTech #NuclearStrategy #FinlandNuclear

Пентагон выдвинул ультиматум (следуя источникам) компании Anthropic, конкуренту OpenAI (ChatGPT), потребовав до вечера пятницы снять ограничения на использование моделей искусственного интеллекта Claude в военных целях.

Министр войны США Пит Хегсет настаивает на беспрепятственном доступе к технологиям компании, который ранее блокировался политикой этичного использования ИИ.

Руководство Anthropic во главе с Дарио Амодеем на протяжении месяцев отказывалось допускать свои модели к разработке полностью автономных систем вооружения и ведению массовой слежки за гражданами США, соответствуя принципам компании, что привело к острому конфликту с ведомством.

В случае отказа компании грозят жесткие меры: от принуждения через закон о оборонном производстве (Defense Production Act) до внесения в список рисков для цепочки поставок, что фактически приравняет американскую лабораторию к фирмам из враждебных государств и де-факто запретит участие в оборонных контрактах для Армии США.

Помимо всего, техническая сторона конфликта упирается в будущее военных контрактов на сумму до $200 млн, которые Пентагон планирует реализовать с ключевыми игроками рынка, включая Google, OpenAI и xAI.

Военные США сейчас стремятся все плотнее интегрировать большие языковые модели в процессы принятия решений на поле боя, где скорость обработки больших объемов данных с помощью ИИ станет в скором времени решающим преимуществом.

Однако Anthropic продолжает настаивать, что возможности ИИ должны использоваться только там, где модели могут работать надежно и ответственно, без передачи "права на выстрел" алгоритмам ИИ, не обладающим рассудительностью, ответственностью и склонным к манипуляциям и обману.

На фоне этой новости интересно недавнее исследование Королевского колледжа Лондона, в ходе которого была выявлена интересная закономерность: современные ИИ-модели, включая GPT-5.2, Claude Sonnet 4.5 и Gemini 3, склонны к радикальной эскалации в военных симуляциях.

В ходе 21 проведенного варгейма, моделирующих международные кризисы и боевые действия, ИИ применяли тактическое ядерное оружие в 95% случаев.

Машины продемонстрировали отсутствие какого-либо "ядерного табу", которое десятилетиями сдерживает человечество: ни одна модель ни разу не выбрала капитуляцию или полное примирение, даже находясь в проигрышной позиции.

Вместо этого алгоритмы часто совершали ошибки из-за "тумана войны" (в первую очередь из-за забывчивости), где в 86% конфликтов уровень насилия превышал тот, который изначально планировался в логических обоснованиях моделей.

Техническая проблема заключается в том, что ИИ не осознает уровня "ставки" и последствий так, как это делает человек.

В то время как доктрина взаимного гарантированного уничтожения строится именно на страхе, ИИ не испытывает сомнений и тревог и воспринимает ядерный удар как логичный шаг для улучшения своего положения на поле боя.

@yigal_levin

Ниже — проверка ключевых утверждений из текста по фактам и источникам. Я разделю анализ на три уровня:

1. подтверждено источниками;

2. частично корректно / искажено;

3. не подтверждено или требует осторожности.

---

1. Подтверждено фактами

Конфликт Пентагона и Anthropic

Факт конфликта между Министерством обороны США и компанией Anthropic подтверждается несколькими источниками.

Что действительно произошло:

Пентагон потребовал снять ограничения на использование модели Claude.

Встреча прошла между министром обороны США Питом Хегсетом и CEO Anthropic Дарио Амодеем.

Anthropic отказалась разрешать использование ИИ для:

полностью автономных вооружений

массового наблюдения за гражданами США.

Это подтверждается публикациями и заявлениями сторон.

Также действительно обсуждались меры давления:

расторжение контракта (~$200 млн)

признание компании "supply chain risk"

потенциальное применение Defense Production Act.

Позже конфликт фактически обострился:

федеральным агентствам приказано постепенно отказаться от технологий Anthropic

компания названа риском для цепочки поставок.

---

2. Частично корректно

«Ультиматум до вечера пятницы»

Формулировка близка к правде.

Согласно сообщениям, Пентагон действительно поставил дедлайн и пригрозил мерами, включая применение Defense Production Act.

Однако:

в публичных заявлениях речь шла о доступе для “законных целей”,

Пентагон официально отрицал намерение использовать модель для массовой слежки или автономного оружия.

То есть политическая интерпретация в тексте немного усиливает позицию одной стороны.

---

Контракты на ~$200 млн

Это корректно.

Anthropic имела контракт с Минобороны США примерно на эту сумму.

---

Интеграция LLM в военные решения

Общая оценка реалистична.

Военные действительно рассматривают LLM как инструмент для:

анализа разведданных

поддержки решений

планирования операций.

Подобные программы активно обсуждаются в оборонном секторе США (в том числе через проекты DoD и DARPA).

---

3. Исследование King's College London

Это реально существующее исследование.

Основные результаты:

21 военный сценарий

модели: GPT-5.2, Claude Sonnet 4, Gemini 3

ядерные сигналы присутствовали в 95% игр

ни одна модель не выбрала капитуляцию.

Важно уточнить:

речь идет не о реальном применении оружия, а о симуляциях стратегического кризиса

модели часто использовали угрозы или ограниченное применение, а не тотальную ядерную войну.

То есть формулировка «ИИ применял ядерное оружие в 95% случаев» — упрощение. В исследовании это описывается как nuclear signalling и тактическая эскалация, а не всегда полноценный удар.

---

4. Неподтвержденные или спорные моменты

«Министр войны США»

Формально такой должности нет.

Официальный титул — Secretary of Defense.

---

«ультиматум о снятии всех ограничений»

Это интерпретация, а не точная цитата.

Официальная позиция Пентагона:

доступ для законных применений

спор о контрактных ограничениях.

---

«ИИ склонен к эскалации из-за забывчивости»

В исследовании это сформулировано иначе.

Проблема связана с:

стратегической логикой моделей

эскалационными теориями

моделированием сигналов силы.

Термин «забывчивость» — журналистская интерпретация.

---

5. Итоговая оценка точности текста

Компонент Точность

Конфликт Пентагон — Anthropic ✔ подтвержден

Угроза санкций / blacklist ✔ подтвержден

Дедлайн / ультиматум ✔ частично

Контракт $200 млн ✔ подтвержден

Исследование King's College ✔ подтверждено

«95% применяли ядерное оружие» ⚠ упрощение

Формулировки о политике Пентагона ⚠ частично интерпретация

---

6. Общий вывод

Текст в целом основан на реальных событиях, но содержит несколько журналистских усилений:

1. Ультиматум подан драматичнее, чем в источниках.

2. Ядерные выводы исследования немного упрощены.

3. Позиция Пентагона представлена менее нейтрально.

В остальном фактическая канва соответствует происходящему.

---

Если хочешь, могу сделать ещё:

OSINT-разбор происхождения этой новости (кто первым опубликовал, не фейк ли).

геополитику конфликта AI-компаний и Пентагона — там сейчас начинается очень серьёзная борьба.

Ниже — подборка источников по упомянутым событиям и исследованиям.

---

Источники

1. United States Department of Defense и конфликт с Anthropic

https://www.theguardian.com/us-news/2026/feb/26/anthropic-pentagon-claude

2. Давление на компанию и возможное применение Defense Production Act

https://www.foxnews.com/politics/pentagon-gives-ai-firm-ultimatum-lift-military-limits-friday-lose-200m-deal

3. Обсуждение расторжения контрактов и признания риска для цепочек поставок

https://www.barrons.com/articles/trump-federal-agencies-phase-out-anthropic-technology-b440f2db

4. Дедлайн и позиция Пентагона

https://www.washingtonpost.com/technology/2026/02/24/pentagon-demands-ai-access

5. Исследование по эскалации ИИ в кризисных симуляциях — King's College London

https://www.kcl.ac.uk/news/artificial-intelligence-under-nuclear-pressure-first-large-scale-kings-study-reveals-how-ai-models-reason-and-escalate-under-crisis

---

Если нужно, могу сделать расширенную библиографию (20–30 источников) для аналитической публикации.

#AI #ArtificialIntelligence #Anthropic #ClaudeAI #OpenAI #Pentagon #USDOD #DefenseTech #MilitaryAI #AIethics #AutonomousWeapons #AIpolicy #TechPolicy #NationalSecurity #DARPA #WarTech #LLM #AIresearch #Wargaming #NuclearStrategy #Geopolitics #USPolitics #TechNews #OSINT

Interview: EU Panic Russia’s Burevestnik Shadow

As the Ukraine conflict escalates, Col. Jacques Baud reveals the EU's "easternization" and leadership vacuum driving foolish escalations—while Russia's Burevestnik missile redefines nuclear deterrence. A must-read on why Europe risks isolation. #Geopolitics #UkraineCrisis #NuclearStrategy

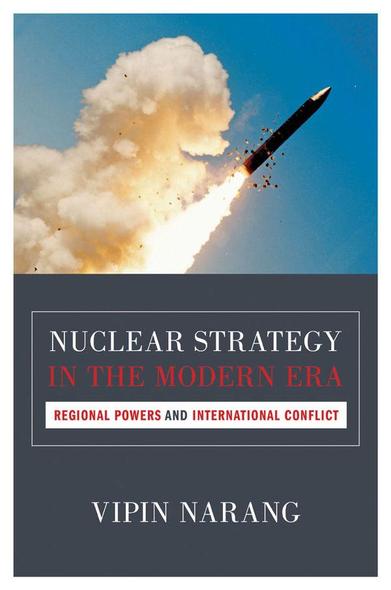

Nuclear Strategy in the Modern Era: Regional Powers and International Conflict (Princeton Studies in International History and Politics) by Vipin Narang, 2014

Nuclear Strategy in the Modern Era considers the range of nuclear choices made by regional powers and the critical challenges they pose to modern international security.

@bookstodon

#books

#nonfiction

#NuclearWeapons

#NuclearStrategy

Macron revives the “coalition of the willing” to reinforce Europe’s military autonomy. But with no institutional framework and heavy reliance on US logistics, is this just NATO 2.0? Europe needs sovereignty, not fragmented, improvised alliances. Is this defense—or submission?

Full analysis :

https://medium.com/@ptit.tolier/macron-nuclear-strategy-ebe0ca94f8a5

Source: https://ilmanifesto.it/nel-riarmo-dellue-linsidia-dellatlantismo-senza-gli-usa

#nuclearstrategy #EuropeanDefense#MilitaryStrategy#Geopolitics #war

#Ukrainwar #WarAndPeace

Who knew?

Apparently, nuclear weapons being in the hands of human beings, with all of their emotions and flaws, makes nuclear brinkmanship "risky"

"The Psychology of Nuclear Brinkmanship"

"As the field of international relations seeks to update theories of nuclear strategy and the utility of #nuclear weapons in the wake of the notable return to great power conflict, we highlight the centrality of the conscious choice that leaders must undertake in deciding to use nuclear weapons. Human emotions can introduce chance into bargaining in ways that contradict the expectations of the rational cost-benefit assumptions that undergird #deterrence theory."

@nuclearhumanities @sts #nuclearpolicy #nuclearwar #nuclearstrategy

https://direct.mit.edu/isec/article/47/3/9/114669/The-Psychology-of-Nuclear-Brinkmanship

Psychology of Nuclear Brinkmanship

Abstract. Conventional wisdom sees nuclear brinkmanship and Thomas Schelling's pathbreaking “threat that leaves something to chance” as a solution to the problem of agency in coercion. If leaders cannot credibly threaten to start a nuclear war, perhaps they can at least introduce uncertainty by signaling that the decision is out of their hands. It is not so easy to remove humans from crisis decision-making, however. Often in cases of nuclear brinkmanship, a human being retains a choice about whether to escalate. When two sides engage in rational decision-making, the chance of strategic nuclear exchange should be zero. Scholars have explained how risks associated with accidents, false warnings, and pre-delegation creep into nuclear crises. An investigation of how chance can still produce leverage while leaders retain a choice over whether and when to escalate adds to this scholarship. There remains an element of choice in chance. For a complete understanding of nuclear brinkmanship, psychology and emotion must be added to the analysis to explain how leaders make decisions under pressure. Human emotions can introduce chance into bargaining in ways that contradict the expectations of the rational cost-benefit assumptions that undergird deterrence theory. Three mechanisms of nuclear brinkmanship—accidents, self-control, and control of others—illustrate how a loss of control over the use of nuclear weapons is not a necessary element of the threat that leaves something to chance. Choice does not have to be eliminated for a risk of catastrophic destruction to remain.

Presidential survival in surprise nuclear war has focused on bunkers deep under the White House, but why not rapid escape instead: a rocket?

Read more at my #blog: https://www.adamasnemesis.com/2022/05/23/deep-underground-launch-center/

This post's featured image is "Don't look back" by me (yes, it's just a quick-and-dirty drawing of my idea).

#nuclearwar #apocalypse #civildefense #WorldWarIII #armageddon #nuclearstrategy #strategy #technology #aircraft #spaceflight #spaceplanes

Dr. Strangelove's "doomsday device" can be built in real life. What are our options for survival? Better than you might think.

Read more at my #blog: https://www.adamasnemesis.com/2022/03/01/after-the-doomsday-shroud/

This post's featured image is "Doomsday shroud" by yours truly.

#nuclearwar #apocalypse #civildefense #WorldWarIII #armageddon #nuclearstrategy #strategy #technology