The #Ceph at work drives me crazy...

We want to organize the data in subvolumes and subvolume groups.

Seems that I'm unable to mount different subvolumes that are on the same default volume at once.

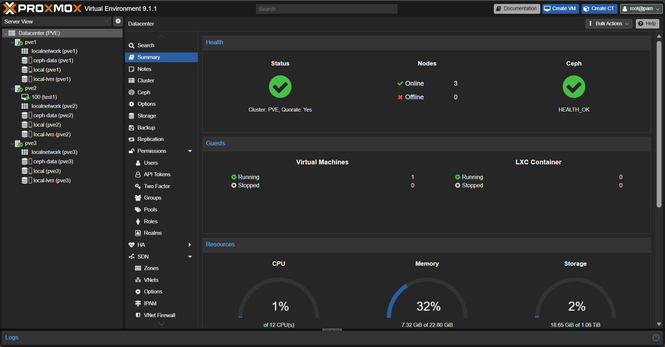

So, ok, then mounting the directories directly from CephFS. Easy going, works on my private Ceph on Proxmox like a charme.

Only thing: it is not working at work. Only one mount possible.

Oh my....

One difference between those two installations are:

Private Cluster: Proxmox with Debian packages

Work Cluster: official container images via podman.

Does someone know if there are issues with containerized Ceph?

EDIT:

Found the guilty option: "fsc" was causing the problems. Removing that mount option did the trick. Yay! :)

And tomorrow I'll test subvolumes again...

#followerpower