https://gwern.net/nootropic/magnesium #MagnesiumSelfExperiments #ScienceHumor #PersonalDelusion #BayesTheorem #HealthRisks #HackerNews #ngated

https://gwern.net/nootropic/magnesium #MagnesiumSelfExperiments #ScienceHumor #PersonalDelusion #BayesTheorem #HealthRisks #HackerNews #ngated

Saturday Morning Breakfast Cer...

Möglicherweise waren es die rosa Elefanten in einer Logikaufgabe, die mir die diese mathematische Disziplin im Studium schmackhaft machten. 🙂

Vielleicht aber auch die Wahrheitstafeln, bei denen es einfach nur wahr oder falsch gab. Nichts dazwischen, anders als im wirklichen Leben.

Warum sind Statistiken wichtig?

Statistiken helfen, allgemeine Trends und Muster in einem bestimmten Datensatz zu verstehen. Mit Statistiken kann man Daten analysieren und daraus Schlussfolgerungen ziehen.

Einer der wichtigsten Bereiche, in denen Statistik in der KI verwendet wird, ist das maschinelle Lernen. Algorithmen für maschinelles Lernen wie etwa neuronale Netzwerke basieren auf statistischen Methoden, um Vorhersagen zu treffen und Muster in Daten zu erkennen: Was macht ein Fahrrad aus oder ist es doch eine Obstschale?

Bei den Vorhersagen über zukünftige Ereignisse und Verhaltensweisen setzt die Bayesian Statistik an. Sie kann nämlich mehr als wahr und falsch. Mehr als ja und nein.

Mit dem Bayes’schen Theorem in der KI, auch bekannt als Bayes’sche Regel oder Bayes’sches Gesetz, lassen sich unsere Überzeugungen oder die Wahrscheinlichkeit des Eintretens eines Ereignisses auf der Grundlage neuer Beweise oder Informationen aktualisieren.

Das Bayes-Theorem ist ein grundlegendes Konzept der Wahrscheinlichkeitstheorie und Statistik. Es ist für die Entscheidungsfindung, die Mustererkennung und die Vorhersagemodellierung von entscheidender Bedeutung.

Eigentlich sind für die Bayesian Statistik nur drei Dinge wichtig: der Prior (Anfangsannahme), der Updater (Aktualisierte) und der Posterior (Ausgang). Der Prior kann Allgemein- oder auch Expertenwissen enthalten. Aber er besteht nur aus einer Annahme, für wie wahrscheinlich wir etwas einschätzen und nicht aus vielen, viele Daten, die diesen Wert ergaben.

Die Anzahl der Daten – etwa Personen, die untersucht wurden – ist also weniger wichtig als die Vorannahme (Prior). Dazu später mehr.

Klassische und Bayessche Statistik kommen oft zu den gleichen Ergebnissen, jedoch setzt der bayessche Wahrscheinlichkeitsbegriff keine unendlich oft wiederholbaren Zufallsexperimente voraus. Bei kleiner Datengrundlage benötigt sie dafür aber eine plausible Festlegung der A-priori-Wahrscheinlichkeit für den Anfangswert (Nullhypothese).

Eine geringe Datenmenge führt dabei zu einer breiten Wahrscheinlichkeitsverteilung.

Die Bayesschen Statistik kann bei kleinen Stichprobengrößen gültige Schlussfolgerungen ziehen, während frequentistische Statistiken in diesen Szenarien oft keine statistische Signifikanz liefern, die Ergebnisse also zusammengeklaubter Murks sind.

Denn statistisch ist es egal, wie viele Personen im Sommer Eis essen und wie viele Personen im Sommer ertrinken. Selbst wenn die Zahlen sehr hoch und gleich sind, ist die Schlussfolgerung: Eisessen führt zu Ertrinken absoluter Blödsinn. Andersrum noch schlimmer: Ertrinken führt zu Eisessen…

Die klassischen Wahrheitstabellen sind halt nicht immer das Mittel der Wahl.

Eine Vorannahme, dass der Vergleich Murks ist, würde da helfen…

Wann also den Satz von Bayes anwenden?

Wenn man die Wahrscheinlichkeit des Eintretens von etwas unter der Voraussetzung bestimmen muss, dass eine andere Bedingung vorliegt, die das Eintreten beeinflussen kann, ist der Satz von Bayes angebracht. Mit der Bayes-Regel können sogar Wahrscheinlichkeitsabfragen beantwortet werden, die von einem einzigen Beweisstück abhängen.

Beispiel aus der Wettervorhersage

Wenn es heute 36 Grad Celsius hat, die Sonne erbarmungslos vom wolkenlosen Himmel knallt, dann ist es ziemlich unwahrscheinlich, dass es morgen minus 10 Grad hat und schneit. (Denver, Colorado, ausgenommen). Das ist eine durchaus zulässige Vorannahme. Ein Prior.

Der bayessche Wahrscheinlichkeitsbegriff definiert Wahrscheinlichkeiten als „Grad vernünftiger Erwartung“, also als Maß für die Glaubwürdigkeit einer Aussage. Das kann von 0 (falsch, unglaubwürdig) bis 1 (glaubwürdig, wahr) reichen, aber eben auch dazwischen liegen.

Diese Interpretation von Wahrscheinlichkeiten und Statistik unterscheidet sich fundamental von der Betrachtung in der konventionellen Statistik, in der unendlich oft wiederholbare Zufallsexperimente unter dem Gesichtspunkt betrachtet werden, ob eine Hypothese wahr oder falsch ist. Eins oder null. Null oder eins. Dazwischen gibt es nichts.

Der französische Mathematiker, Physiker und Astronom Pierre-Simon Laplace hatte bereits im 18. Jahrhundert den Satz von Bayes verwendet, um die Masse des Saturn und anderer Planeten einzugrenzen.

A: Die Masse des Saturn liegt in einem bestimmten Intervall

B: Daten von Observatorien über gegenseitige Störungen von Jupiter und Saturn

C: Die Masse des Saturn darf nicht so klein sein, dass er seine Ringe verliert, und nicht so groß, dass er das Sonnensystem zerstört.

Die Idee des Bayes’schen Lernens besteht darin, den Annahmen (Hypothesen) Wahrscheinlichkeiten zuzuweisen und sie auf der Grundlage der beobachteten Beweise zu aktualisieren.

Bayes’sches Deep Learning hat Vorteile gegenüber herkömmlichem Deep Learning: Es quantifiziert die Unsicherheit in Modellvorhersagen. Das hilft bei Anwendungen mit erheblicher Unsicherheit, etwa bei medizinischen Diagnosen oder Finanzprognosen.

Wie funktioniert die Bayes’sche Statistik?

Die Stärke des Bayes’schen Ansatzes ist die Einbeziehung von Vorabinformationen und die Möglichkeit, die Wahrscheinlichkeit verschiedener Hypothesen direkt aus der Posteriorverteilung zu berechnen.

Mit den Schritten: Identifizierung der Daten, ein beschreibendes Modell definieren, Vorhersage angeben, Posterior-Verteilung berechnen.

Danach wird die Posterior-Verteilung interpretiert und festgestellt, ob das Modell eine angemessene Beschreibung der Daten ist.

Kritikpunkt für den Bayes’schen Ansatz

Das ist der Prior, die Vorannahme. Denn die ist subjektiv. Darüber hinaus gibt es keine einzige, vorgeschriebene und genau definierte Methode zur Auswahl einer Vorhersage.

Alles in diesem Beitrag Geschriebene ist der Versuch, eine komplexe und allgemein eher unbeliebte Thematik korrekt und doch einigermassen verständlich darzustellen. Vielleicht noch immer zu technisch für manche Leser, vielleicht zu trivial für Naturwissenschaftler.

Vielleicht aber wird es auch andere ansprechen und begeistern, so wie es der Vortrag von Dr. Sophie Carr beim BSF über die Bayes’sche Statistik bei mir getan hat.

Allerdings hatte Sophie Carr nichts von alldem erzählt. Ihre zahlreichen Folien enthielten nur schöne Bilder. Carr warf keine Formel an die Wand, sie versuchte die Zuhörer qualitativ über Sicherheit und Entscheidungsfindung – Vorhersage, was passieren wird – einzustimmen.

Das gelang ihr jedoch so gut, dass die Zuhörer mehrfach nach der Formel des Bayes’schen Ansatz lechzten. So etwas passiert selten. Sie schrieb dann nach dem Vortrag die Formel auswendig an die Tafel, dabei purzelten die A und Bs allerdings ein wenig durcheinander.

Trotzdem: Sophie Carr ist eine bemerkenswerte Frau. Sie ist die Gründerin und Inhaberin von Bays Consulting und Vizepräsidentin der Royal Statistical Society für Bildung und statistische Kompetenz. Carr ist Mitglied des Generalrats des Institute of Mathematics and its Applications und wurde 2019 zur interessantesten Mathematikerin der Welt gewählt.

Es gibt sogar einen Bezug zum Fliegen: Ursprünglich hatte Carr eine Ausbildung als Luftfahrtingenieurin absolviert. Sie flog für das Britische Militär.

In dieser Zeit kam sie in Kontakt mit Statistik, einem Fach, das sie wie viele andere anfangs nicht spannend fand. Aber es war die Bayesian Statistik, die ihr Interesse weckte und sie promovierte über Belief Networks (= Bayesian Network).

Carr betont, dass es (ihr) wichtig ist, verschiedene mathematische Bereiche zusammenzubringen. So können Ideen besser ausgetauscht werden und man findet am Ende die beste Lösung.

Ihre Firma entwickelte ein Analyse- und Business-Intelligence-Tool. Mit Algorithmen des maschinellen Lernens sagt das Tool etwa das Vorhandensein von Wohnungsschäden durch Kälte, Feuchtigkeit und Schimmel auf Adressebene voraus. Das spart Zeit und Ressourcen. Damit lassen sich Instandhaltungsmaßnahmen für den Wohnungsbestand priorisieren. Was erhebliche Kosten und Aufwand spart.

Nur wenige Klicks zeigen, welche Wohnungen ein hohes Risiko aufweisen. Zeitaufwändige Erhebungen vor Ort oder der Einsatz von Sensoren sind nicht mehr erforderlich.

===========================================

Wer den Satz von Bayes (= die Formel) korrekt haben will, bitte sehr:

Der Satz von Bayes ist eine Formel, mit der man die bedingte Wahrscheinlichkeit berechnen kann. Die bedingte Wahrscheinlichkeit ist die Chance, dass ein Ergebnis eintritt, wenn ein bestimmtes vorheriges Ergebnis unter ähnlichen Umständen gegeben ist.

Der Satz wurde in den Papieren des englischen presbyterianischen Pfarrers und Mathematikers Thomas Bayes entdeckt und 1763 posthum veröffentlicht.

P(A|B) = P(B/A)P(A) / P(B)

That’s it.

Der Zähler ist die Wahrscheinlichkeit des Ereignisses B bei Ereignis A multipliziert mit der Wahrscheinlichkeit, dass Ereignis A allein eintritt.

——————————————

Break. Break.

Die Einführung zu Sophie Carrs Vortrag (Die „Presidential Address for Mathematics“) hielt Dr. Martin Dominik. Der Deutsche, der an der University of St Andrews in Liverpool lehrt, war mir schon bei einem anderen Vortrag aufgefallen: Ein Mann, der ein Hemd mit solchem Muster („Pattern“) trägt, muss etwas mit Mathe oder zumindest Naturwissenschaft am Hut haben. Bingo!

In bester Laune (v. l.n.r.): Dr Ivo Siekmann, School of Computer Science and Mathematics, Liverpool John Moores University, Dr. Martin Dominik ist Dozent an der School of Physics & Astronomy der Universität von St. Andrews und stehend Chris Lintott, Professor of Astrophysics in the Department of Physics at the University of Oxford.©alle Bilder FuZ, Inhalt der 2 Folien:

Zur Übersicht aller Beiträge zum British Science Festival 2024

https://flugundzeit.blog/statistik-bayes-theorem-ki/

#BayesTheorem #ChrisLintott #HelgaKleisny #IvoSiekmann #MartinDominik #Statistik

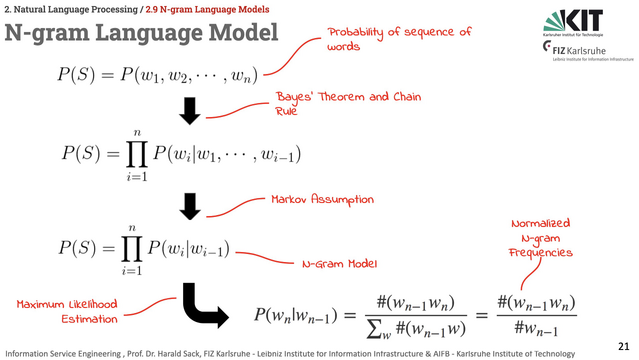

N-gram language models are quite simple and approximate the probability of a sequence of words in a language by applying the Bayes Rule for conditional probabilities, the Markov Assumption for simplifying complexity, and the Maximum Likelihood Estimation to approximate probabilities from frequency counts in a corpus.

lecture slides: https://drive.google.com/file/d/1NkFexo9gxlZVkBR7XWKcOJMJiaX4GPG1/view?usp=drive_link

#nlp #llm #languagemodel #BayesTheorem #ise2024 #dh @fiz_karlsruhe @lysander07 @sourisnumerique @enorouzi @shufan

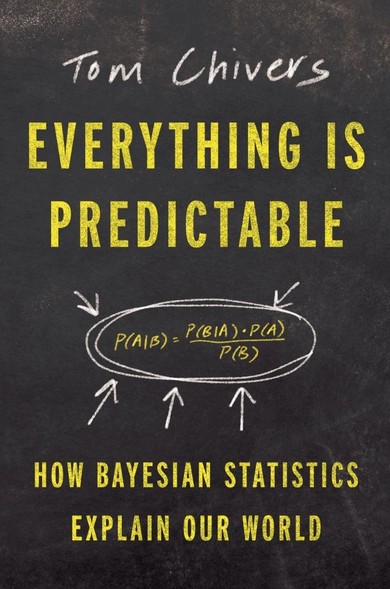

Everything Is Predictable: How Bayesian Statistics Explain Our World by Tom Chivers, 2024

A captivating and user-friendly tour of Bayes's theorem and its global impact on modern life from the acclaimed science writer and author of The Rationalist's Guide to the Galaxy.

@bookstodon

#books

#nonfiction

#probability

#BayesianStatistics

#BayesTheorem

-- The net effect of ignoring, or downplaying, priors and only working in two-hypothesis problems is to sweep these sorts of complexities under the rug. --

(from @bblais)

https://bblais.github.io/posts/2024/Jan/22/a-poor-introduction-to-bayesian-reasoning/

#BayesTheorem #reasoning #IntelligentDesign #creationism #apologetics

Engines of Our Ingenuity 2864: Bayes’ Theorem

Episode: 2864 The theorem of Reverend Bayes. Today, let’s talk about uncertainty and an 18th-century Presbyterian minister.

🔗 https://calendar.mit.edu/event/probability_and_god

-

#theism #probability #BayesTheorem #God #math #maths #mathematics #theology #MIT #students #events #CambridgeMA #Boston

⚛️😶🌫️🎲🧮 Probability and God

Probability theory is a branch of mathematics that deals with uncertainty, and how to reason about it. For Subject 12 our Course 0 series, in a talk titled "What Does Probability have to do with God? Exploring Bayesian Reasoning in Theological Problems", Dr Brian Blais will present a framework for rational inquiry based on probability theory. Dr Blais will explain the basic concepts and principles of probability, and how they can be applied to any domain of interest, including theology, the study of the nature of God and religious beliefs. He will explore some of the key theological concepts, such as belief, faith, miracles, and the existence of God, and how they can be analyzed using probability. He will also compare and contrast the scientific method with other ways of acquiring knowledge, such as revelation and intuition. His aim is to provide a clear and consistent way of thinking about these topics, and to reveal the hidden assumptions and implications of various theological arguments. Along the way, he will demonstrate some surprising and counterintuitive results that arise from probability theory, and how they can lead to errors in reasoning. WHEN: Wednesday, 2023/OCT/18, 6pm ET WHERE: 35-325 (3rd Floor, 127 Massachusetts Ave, https://whereis.mit.edu/?go=35 ) Free and open to the public. Presentation followed by audience Q&A. Free refreshments will be served after. The event will be photographed, recorded, and streamed. YouTube livestream: https://www.youtube.com/watch?v=zl9z-YbOg9E About our speaker: Dr Brian Blais is a professor of Science in the School for Health and Behavioral Sciences, Bryant University, Rhode Island. He has a PhD in Physics from Brown University, and for many years was a Visiting Professor in the Institute for Brain and Neural Systems, Brown University. His focus has been on computational and statistical methods applied to a wide range of fields such as the neuroscience of vision, paleoclimate, disease modeling, and most recently the textual properties of the New Testament. He has a personal interest in science education and maintains a blog at https://bblais.github.io where he explores the intersection of science and society, often dealing with issues in religious thought and pseudoscience. He is the author of the book "A Measure of Faith - Probability in Religious Thought". Speaker links: Website/Blog/Books/Links: https://bblais.github.io Twitter: https://twitter.com/bblais