Ускорение вычислений в алгоритме DRS-виртуализации через векторизацию

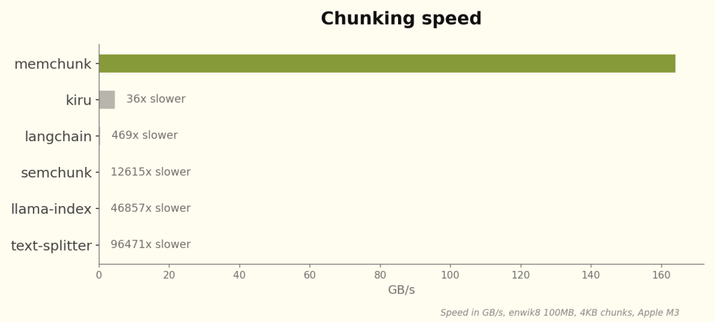

Переписать решение с Python на Go и получить ускорение в 35 раз — звучит приятно. Но можно ведь пойти дальше, вспомнить о возможностях современных процессоров и увеличить отрыв Go до 200 раз! Статья написана по мотивам доклада для

https://habr.com/ru/companies/oleg-bunin/articles/980710/

#avx #avx2 #avx512 #бэкенд #разработка #go #golang #phyton #ускорение #ускорение_кода