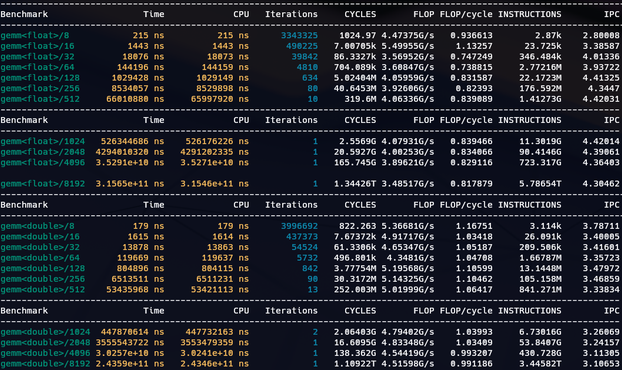

HotSpot auto-vectorization can speed up #Java loops—but often doesn’t apply in real-world code. @BalaRawool explains how the #Vector API enables explicit #SIMD with predictable gains.

Learn how to turn scalar loops into portable SIMD code: https://javapro.io/2026/04/09/java-vector-api-faster-vector-computations-for-the-jvm/