How LLMs Work

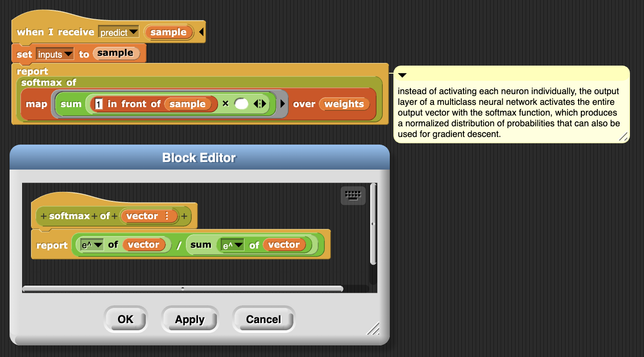

이 글은 대형 언어 모델(LLM)의 작동 원리를 기계적 관점에서 상세히 설명한다. LLM은 주어진 토큰 시퀀스에 대해 다음 토큰의 확률 분포를 예측하는 함수이며, 이 과정이 반복되어 텍스트를 생성한다. 온도(temperature) 파라미터는 출력 확률 분포의 샤프함을 조절해 생성 결과의 다양성과 결정성을 조절하는 역할을 한다. 모델은 개별 학습 예시를 기억하지 않고, 방대한 텍스트 데이터에서 학습한 통계적 패턴을 내재화하여 새로운 입력에 일반화한다. 또한, LLM 출력이 본질적으로 확률적이며, 일관성 유지와 오류 대응을 위해 여러 번 테스트와 검증이 필요함을 강조한다.

https://arpitbhayani.me/blogs/how-llms-work/

#llm #languagemodel #temperature #nexttokenprediction #softmax

How LLMs Really Work

If you have used ChatGPT, Gemini, or Claude, you have already formed an intuition about what these systems do. You type something in, and text comes back that feels coherent, knowledgeable, and sometimes eerily human. But the machinery underneath is simultaneously simpler and stranger than most people expect.