Anthropic (@AnthropicAI)

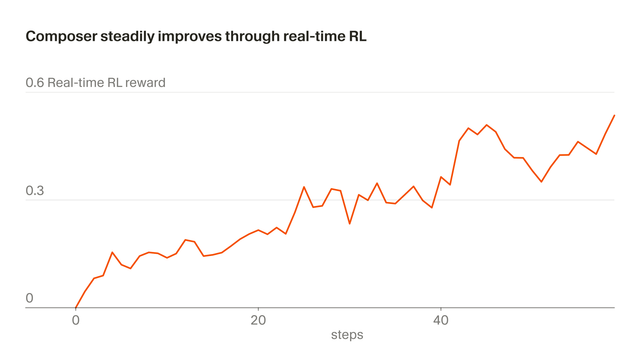

이 작업은 사회적 영향과 모델 학습 사이의 피드백 루프를 닫기 위한 노력의 일부라고 설명한다. 사람들이 Claude를 어떻게 사용하는지 연구하고, 원칙에서 부족한 부분을 찾아 새로운 모델 학습에 반영하는 것이 목표다.

Anthropic (@AnthropicAI) on X

This work is part of a loop we're working to close between societal impacts and model training. One of our goals is to study how people use Claude, find where it falls short of its principles, and use what we learned in training new models. Read more: https://t.co/6tjY58uBhk