The understated loading design inside Transformers that saves memory

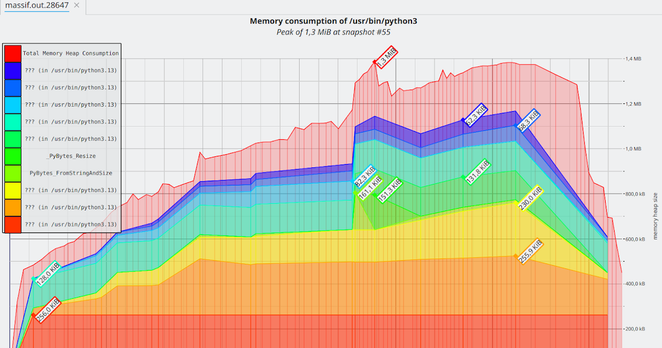

Transformers 라이브러리는 PyTorch의 meta device를 활용해 대형 모델을 메모리 두 배 사용 없이 효율적으로 로딩하는 방식을 구현했다. meta device는 파라미터의 메타데이터만 보유해 메모리 사용을 최소화하며, safetensors 슬라이스를 통해 필요한 텐서만 지연 로딩한다. 또한 비동기 및 동기 로딩 경로를 상황에 맞게 선택하고, 디스크 오프로딩을 지원해 메모리 부담을 줄인다. 이러한 설계는 70B 이상의 대형 모델도 제한된 메모리 환경에서 효과적으로 다룰 수 있게 한다.

https://www.stevhliu.com/2026/transformers-compendium-1

#transformers #pytorch #memoryoptimization #modelloading #safetensors