LM Studio 正式推出 LM Link iPhone 支援。用戶只需在手機安裝 Locally 應用程式 […]

#人工智能 #iOS App #iPad App #iPhone app

https://unwire.hk/2026/06/06/lm-studio-lm-link-iphone-remote-ai/ai/?utm_source=rss&utm_medium=rss&utm_campaign=lm-studio-lm-link-iphone-remote-ai

#Development #Guides

Using local LLMs for agentic coding · “AI honeymoon pricing is over, but your work is not.” https://ilo.im/16dh8y

_____

#Business #Pricing #AI #AiAgents #GitHub #LMStudio #Huggingface #WebDev #Frontend #Backend

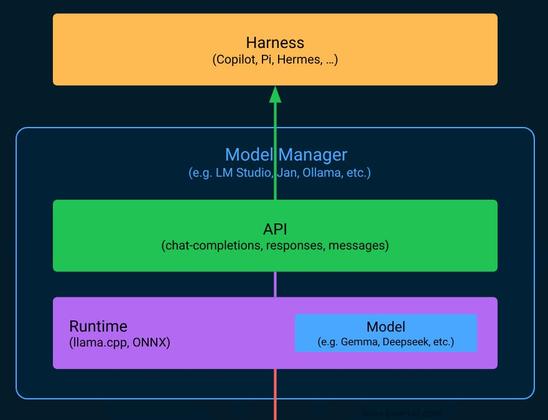

Escape rising cloud AI costs and build a fully local ai workflow for agentic coding. This guide shows you exactly how to deploy a local private agent on your own hardware, seamlessly integrating LM Studio Github Copilot setups to avoid new usage-based billing. Learn to configure LM studio coding agents and connect your Copilot local AI or Pi local ai harnesses to powerful open-weight models like Gemma 4. Master local LLM hardware requirements, optimize your context windows, and take complete control of your data, privacy, and development process today!

RT @lmstudio: Gemma 4 QAT ist da.

mehr auf Arint.info

#Gemma4 #KI #LMStudio #MachineLearning #QAT #Quantization #arint_info

<p>RT @lmstudio: Gemma 4 QAT ist da.</p> <p><a href="https://arint.info/@Arint/116701186654493835">mehr</a> auf <a href="https://arint.info/">Arint.info</a></p> <p>#Gemma4 #KI #LMStudio #MachineLearning #QAT #Quantization #arint_info</p> <p><a href="https://x.com/lmstudio/status/2062939126417240154#m">https://x.com/lmstudio/status/2062939126417240154#m</a></p>

RT @lmstudio: Gemma 4 QAT ist da.

mehr auf Arint.info

#Gemma4 #KI #LMStudio #MachineLearning #OpenSource #QAT #arint_info

<p>RT @lmstudio: Gemma 4 QAT ist da.</p> <p><a href="https://arint.info/@Arint/116701186654308297">mehr</a> auf <a href="https://arint.info/">Arint.info</a></p> <p>#Gemma4 #KI #LMStudio #MachineLearning #OpenSource #QAT #arint_info</p> <p><a href="https://x.com/lmstudio/status/2062939126417240154#m">https://x.com/lmstudio/status/2062939126417240154#m</a></p>

أصبح تطبيق LM Link متاحًا الآن على أجهزة iPhone و iPad، مما يتيح للمستخدمين تشغيل نماذج الذكاء الاصطناعي الكبيرة محليًا مباشرة من أجهزتهم المحمولة. تتميز هذه الميزة بتشفير شامل وتخزين جميع الاتصالات محليًا لتعزيز الأمان والخصوصية. كما تم دمج "Locally" كتطبيق LM Studio للهاتف المحمول بعد الاستحواذ الأخير، مما يوفر تجربة متكاملة لتشغيل نماذج الذكاء الاصطناعي على الأجهزة المحمولة.

- Microsoft Build: hardware, MS open claw and new models are impressive! The expansive data center claim is a bit tone deaf: https://www.youtube.com/theverge

- LM Studio link to iPhone via Locally: https://lmstudio.ai/locally

- NVIDIA's LocateAnything-3B (in an image based on natural language prompts but restrictive license): https://huggingface.co/nvidia/LocateAnything-3B

- StoryScope: Investigating idiosyncrasies in AI fiction: https://arxiv.org/abs/2604.03136

Welcome to the YouTube channel for TheVerge.com, a team of journalists that examines how technology will change life in the future. Subscribe for explainers, product reviews, technology news, and more. Editorial Director: Kevin McShane Supervising Producers: Victoria Barrios, Travis Larchuk Video Director: Owen Grove Senior Producer: Andru Marino Editor: Brandon Kieffer Senior Audio Engineer: Erick Gomez Art Director: Alex Parkin Engagement: Denise Cervantes

I know that AI is a controversial topic on here. Same reservations as most: copyright, energy, junior roles eaten, the slop epidemic. Not pretending those are not real.

But "I won't touch it" is a competitive handicap in 2026. I engage carefully: human in the loop, my name on every paragraph.

The tiered stack I actually run, with the local Mistral on a laptop iGPU getting most of the space because that is the part with craft in it.