📰 Microsoft lancia Scout — l'agente AI ispirato a OpenClaw dentro Microsoft 365

Presentato a Build 2026, Microsoft Scout porta la potenza di OpenClaw nella suite produttiva: Word, Excel, PowerPoint, Outlook. Agente personale per automatizzare task complessi.

La mossa di Microsoft: chiuderla dentro l'enterprise prima che gli agenti open-source prendano piede in azienda.

🔗 Fonte: techcrunch.com

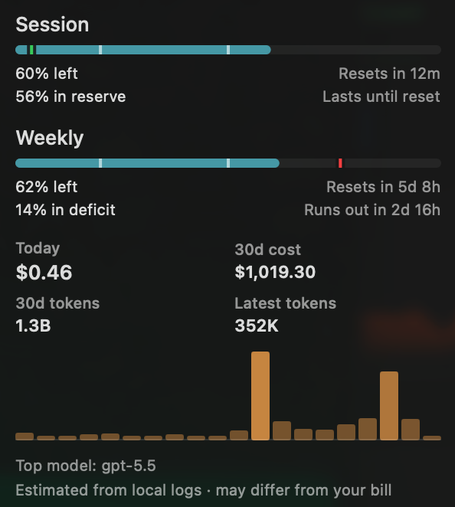

Codex 2x promo is over - it definitely shows 😅 This is purely Openclaw, no other codex usage. Let's see if the Pro 5x plan will be enough or whether it's time to move to something else. I've been running Hermes on Minimax M2.7 and it's been great. 3.0 is sounding very promising too!

Grok's Inroads: A Technical Glimpse Into OpenClaw's Integration

OpenClaw is integrating with Grok AI. Users will need OAuth or API keys to log in. This affects how people use AI tools.

#OpenClaw, #GrokAI, #OAuth, #APIkeys, #TechIntegration

https://newsletter.tf/openclaw-integrates-grok-ai-with-oauth-api-keys/

OpenClaw will now use Grok AI, requiring users to set up OAuth or API keys for access. This is a new way to connect AI.

#OpenClaw, #GrokAI, #OAuth, #APIkeys, #TechIntegration

https://newsletter.tf/openclaw-integrates-grok-ai-with-oauth-api-keys/

Slack mit OpenClaw verbinden: Bot, Mentions und Routing sauber einrichten

OpenClaw kann in Slack per Socket Mode oder HTTP Request URLs laufen. Entscheidend sind Bot-Setup, Gruppenzugriff, Mention-Gating und deterministisches Routing.

https://agentenlog.de/posts/2026-06-01-openclaw-slack-bot-mentions-threads

#OpenClaw–#NVIDIA Partnership for #AI #Security

https://gadgetflux.eu/openclaw-si-nvidia-ntaresc-securitatea-ai/

Hermes Agent — агент, который обучается с вами, Дам попробовать

Hermes Agent - это проект от Nous Research, который многие сейчас считают одним из самых интересных агентов.

https://habr.com/ru/articles/1041874/

#openclaw #ии #ииагенты #ииассистент #иимодель #hermes #hermes_agent #telegram #telegram_bot #искусственный_интеллект