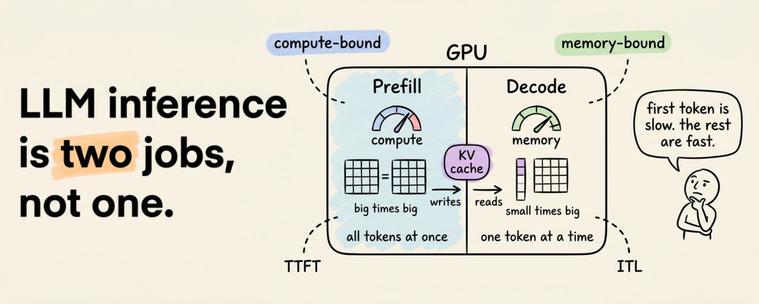

How LLM Inference Works

이 글은 LLM 추론 과정의 핵심 단계를 상세히 설명한다. 토큰화, 임베딩, 어텐션, 프리필(prefill)과 디코드(decode) 단계의 차이, 그리고 KV 캐시의 역할과 한계에 대해 다룬다. 특히 프리필 단계는 GPU 연산 집약적이고, 디코드 단계는 메모리 대역폭이 병목이 되는 점을 강조하며, 긴 컨텍스트 처리에서 캐시 최적화가 중요함을 설명한다. 또한, 캐시 크기를 줄이기 위한 최신 연구 동향과 양자화 기법도 소개한다.

https://twitter.com/akshay_pachaar/status/2050941458614751327