https://gfrm.in/posts/why-decision-theory-lost/index.html #rationality #innovation #HackerNews #ngated

https://gfrm.in/posts/why-decision-theory-lost/index.html #rationality #innovation #HackerNews #ngated

Men det mer generella AI-tillämpandet tog ny fart runt 2012 tack vare #ImageNET och djupinlärning - det var därför det blev en uppsving med nykomlingar vid den tiden.

Fei-Fei Li가 말하는 AI의 다음 10년: 언어를 넘어 공간 지능으로

ImageNet 창시자 Fei-Fei Li가 제시하는 AI의 다음 프론티어. 언어 모델을 넘어 3차원 공간을 이해하는 세계 모델로 나아가야 하는 이유와 World Labs의 비전을 소개합니다.「AI教母」李飛飛:我很自豪自己與眾不同

BBC News 中文 2025-11-09 16:00:00 CST「AI教母」李飛飛教授獲頒伊麗莎白女王工程獎,肯定其機器學習貢獻。身為七位得主中唯一女性,她為啟發後進而接受此稱號。https://www.thenewslens.com/article/260750

#ImageNet #AI教父 #人工智慧 #AI教母 #人工智慧教母 #李飛飛 #伊麗莎白女王工程獎 #科技 #辛頓

Ведущий разработчик ChatGPT и его новый проект — Безопасный Сверхинтеллект

Многие знают об Илье Суцкевере только то, что он выдающийся учёный и программист, родился в СССР, соосновал OpenAI и входит в число тех, кто в 2023 году изгнал из компании менеджера Сэма Альтмана. А когда того вернули, Суцкевер уволился по собственному желанию в новый стартап Safe Superintelligence («Безопасный Сверхинтеллект»). Илья Суцкевер действительно организовал OpenAI вместе с Маском, Брокманом, Альтманом и другими единомышленниками, причём был главным техническим гением в компании. Ведущий учёный OpenAI сыграл ключевую роль в разработке ChatGPT и других продуктов. Сейчас Илье всего 38 лет — совсем немного для звезды мировой величины.

https://habr.com/ru/companies/ruvds/articles/892646/

#Илья_Суцкевер #Ilya_Sutskever #OpenAI #10x_engineer #AlexNet #Safe_Superintelligence #ImageNet #неокогнитрон #GPU #GPGPU #CUDA #компьютерное_зрение #LeNet #Nvidia_GTX 580 #DNNResearch #Google_Brain #Алекс_Крижевски #Джеффри_Хинтон #Seq2seq #TensorFlow #AlphaGo #Томаш_Миколов #Word2vec #fewshot_learning #машина_Больцмана #сверхинтеллект #GPT #ChatGPT #ruvds_статьи

#ConvolutionalNeuralNetworks (#CNNs in short) are immensely useful for many #imageProcessing tasks and much more...

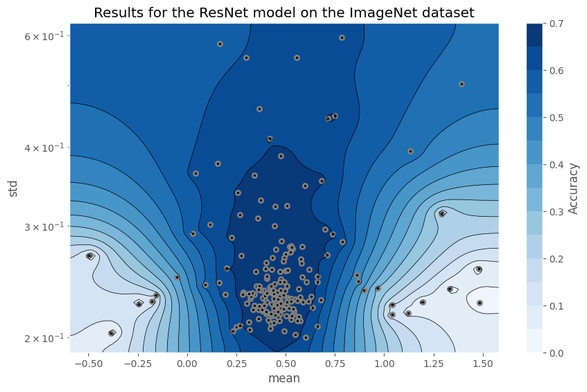

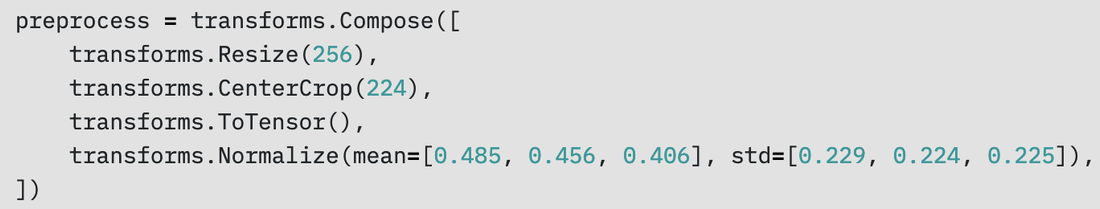

Yet you sometimes encounter some bits of code with little explanation. Have you ever wondered about the origins of the values for image normalization in #imagenet ?

- Mean:

[0.485, 0.456, 0.406](for R, G and B channels respectively) - Std:

[0.229, 0.224, 0.225]

Strangest to me is the need for a three-digits precision. Here, after finding the origin of these numbers for MNIST and ImageNet, I am testing if that precision is really important : guess what, it is not (so much) !

👉 if interested in more details, check-out https://laurentperrinet.github.io/sciblog/posts/2024-12-09-normalizing-images-in-convolutional-neural-networks.html

"You’ve taken this idea way too far," a mentor told Prof. Fei-Fei Li, who was creating a new image #dataset that would be far larger than any that had come before: 14 million images, each labeled with one of nearly 22,000 categories. Then in 2012, a team from Univ of Toronto trained a #neura network on #ImageNet, achieving unprecedented performance in image recognition, dubbed #AlexNet.

https://arstechnica.com/ai/2024/11/how-a-stubborn-computer-scientist-accidentally-launched-the-deep-learning-boom/ #AI

#AI heroic stories and underpaid labour:

"The project was saved when Li learned about Amazon Mechanical Turk, a crowdsourcing platform Amazon had launched a couple of years earlier. "

#Imagenet....How a stubborn computer scientist accidentally launched the deep learning boom - Ars Technica

https://arstechnica.com/ai/2024/11/how-a-stubborn-computer-scientist-accidentally-launched-the-deep-learning-boom/

🚀 New #AI Research: Simplified Continuous-time Consistency Models (#sCM)

🔬 Key findings:

• #OpenAI's new approach matches leading #diffusion models' quality using only 2 sampling steps

• 1.5B parameter model generates samples in 0.11 seconds on single #GPU

• Achieves ~50x wall-clock speedup compared to traditional methods

• Uses less than 10% of typical sampling compute while maintaining quality

🎯 Technical highlights:

• Simplifies theoretical formulation of continuous-time consistency models

• Successfully scaled to 1.5B parameters on #ImageNet at 512×512 resolution

• Demonstrates consistent performance scaling with teacher diffusion models

• Enables real-time generation potential for images, audio, and video

📄 Learn more: https://openai.com/index/simplifying-stabilizing-and-scaling-continuous-time-consistency-models/