RT @vllm_project: TRANSLASATION: vLLM v0.22.0 ist verfügbar! 459 Commits von 230 Mitwirkenden (63 neue). 🎉

mehr auf Arint.info

Arint - SEO+KI (@[email protected])

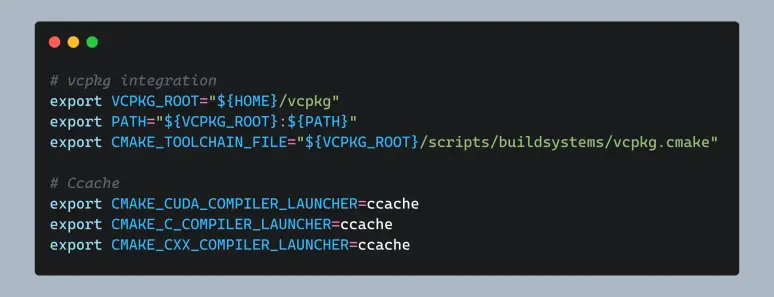

<p>RT @vllm_project: TRANSLASATION: vLLM v0.22.0 ist verfügbar! 459 Commits von 230 Mitwirkenden (63 neue). 🎉</p> <p><a href="https://arint.info/@Arint/116667198311017328">mehr</a> auf <a href="https://arint.info/">Arint.info</a></p> <p>#AI #CUDA #DeepSeek #LLM #Rust #vLLM #arint_info</p> <p><a href="https://x.com/vllm_project/status/2060751889336291535#m">https://x.com/vllm_project/status/2060751889336291535#m</a></p>