Топологический кубит от Microsoft — почему его не воспринимают всерьёз

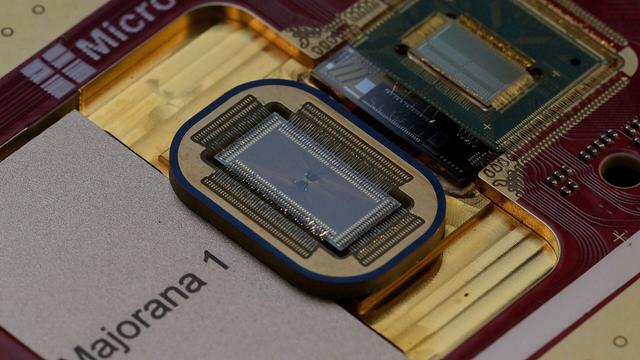

Как известно, в феврале 2025 года научная группа Microsoft Quantum анонсировала процессор Majorana 1 как «первый в мире квантовый процессор на топологических кубитах» ( статья в Nature ). Топологический кубит состоит из энионов — двухмерных квазичастиц, которые физики обнаружили несколько лет назад . Энионы ещё не вошли в школьную программу, чтобы дополнить комплект из фермионов (например, к ним относятся электроны) и бозонов (к ним относятся фотоны) как третий класс элементарных частиц и квазичастиц в физике. До настоящего времени мало кто интересовался, что такое энионы, этот вопрос занимал разве что теоретических физиков. Но Microsoft утверждает, что уникальные 2D-частицы можно использовать для квантовых вычислений, а именно для конструирования «особо надёжных» топологических кубитов.

https://habr.com/ru/companies/ruvds/articles/896798/

#топологический_кубит #нулевые_моды_Майораны #QPU #энионы #квазичастицы #квантовая_отказоустойчивость #квантовый_эффект_Холла #тетроны #хирургия_решётки #lattice_surgery #Сверхинтеллект #алгебра_Клиффорда