Filip Makraduli (@f_makraduli)

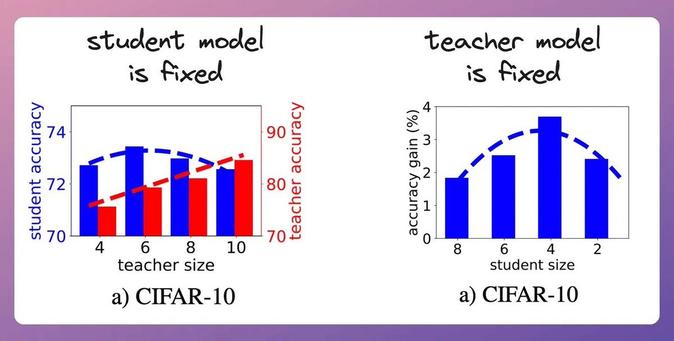

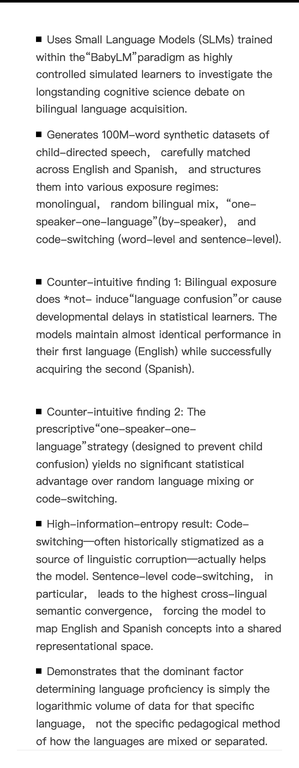

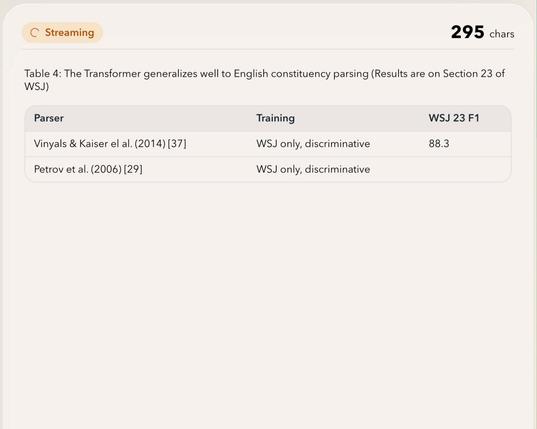

AI Engineer Europe 2026에서 Small Model Inference 발표 내용을 공유한 트윗입니다. 인프라와 딥한 모델 아키텍처 이해를 결합해야 소형 모델 추론을 제대로 최적화할 수 있다는 점을 강조합니다.

Filip Makraduli (@f_makraduli) on X

My pleasure to finally share my talk at AI Engineer Europe 2026 @aiDotEngineer on Small Model Inference and how you need to combine infrastructure with deep model architecture understanding to make this work. Thanks @swyx for making this event happen! https://t.co/LJDFBz3t91