Asiabasket NSAC 2026 Game 2: Ateneo Blue Eagles vs. LPU Pirates , April 11, 2026

https://winbuzzer.com/2026/03/17/nvidia-groq-3-lpx-non-gpu-inference-rack-gtc-2026-xcxwbn/

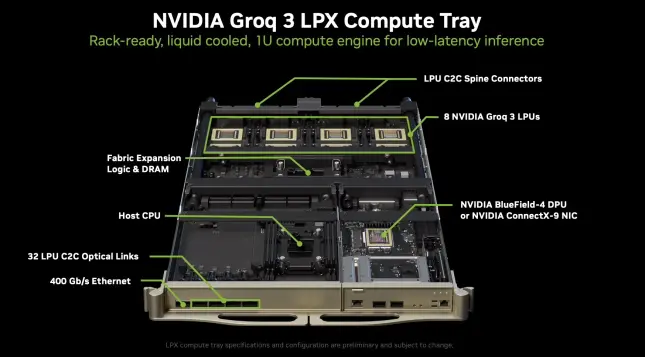

AI Chips: Nvidia Launches Groq 3 LPX, Its First Non-GPU Rack

#AI #AIChips #NVIDIA #Groq #JensenHuang #AIInference #NvidiaBlackwell #NvidiaGPUs #GPUs #Semiconductors #AIHardware #DataCenters #BigTech #GTC2026 #LPU

NVIDIAがGroq技術を統合した超低遅延AIチップ「Groq 3 LPU」を発表、GPUの限界を超える異種混合アーキテクチャの全貌

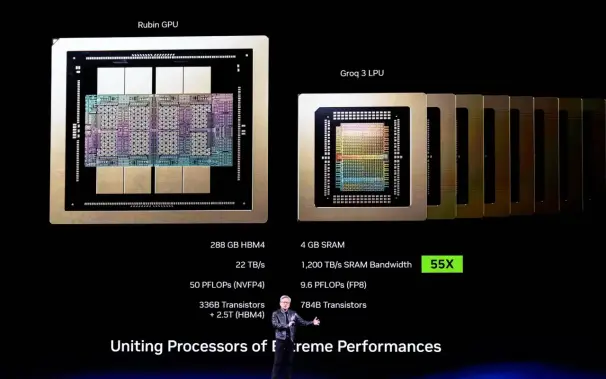

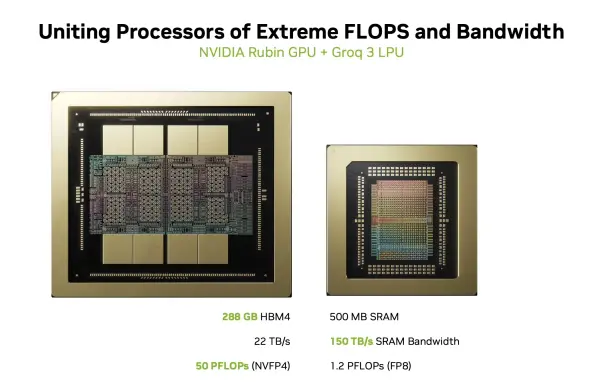

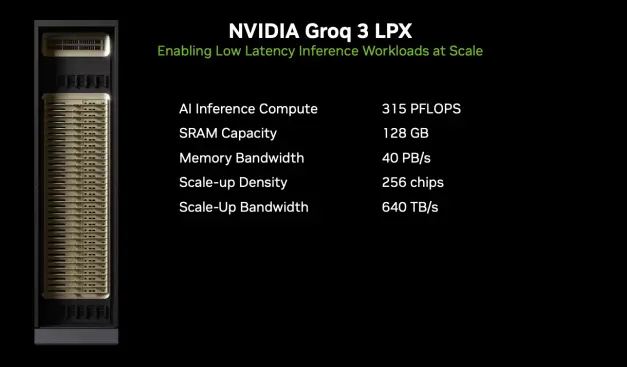

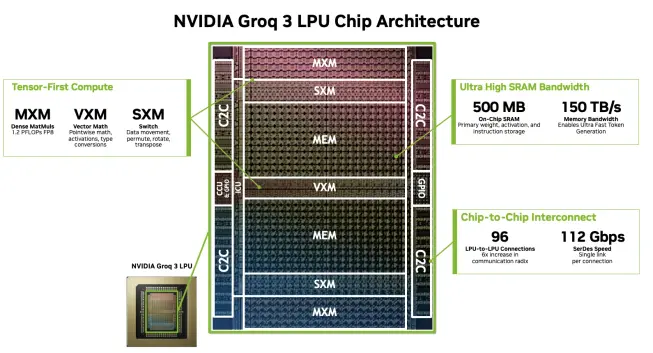

2026年3月に開催されたNVIDIAの年次カンファレンス「GTC 2026」において、CEOのJensen Huang氏は次世代AIデータセンターの構造を根本から変革する新たなハードウェアコンポーネントを発表した。昨年12月に200億ドルという巨額の費用を投じてライセンス契約および人材獲得という実質的な買収を行ったGroqの技術を基盤とする推論特化型アクセラレータ「NVIDIA Groq 3 […]https://xenospectrum.com/nvidia-groq-3-lpx-inference-architecture/

뺑수.Bbang soo | RIVER | (@peterrrmoon)

미국 기업 Groq가 AI 추론 전용 칩 LPU(Language Processing Unit)를 개발했으며, LLM 응답 생성 속도가 GPU 대비 5~10배 빠르다고 소개합니다. 또한 GroqCloud API라는 클라우드 서비스를 통해 Llama 등 모델을 손쉽게 실행할 수 있다고 언급하는 제품·서비스 발표 성격의 트윗입니다.

LLM Index (@bestllms)

트윗은 2025년 가을 NVIDIA가 Groq를 200억 달러($20B)에 인수하면 LPUs가 GPU보다 에너지는 1/10, 속도는 10배로 LLM을 구동할 수 있어 AI 효율성이 대폭 향상될 것이라는 전망을 제시. 이 변화가 AI 분야에서 어떤 혁신을 촉발할지에 대한 논의를 촉발함.

https://www.inside.com.tw/article/40405-all-for-lpu-decoding-why-nvidia-invests-20-billion-dollars-to-acquire-groq

【一切為了 LPU?解密 NVIDIA 為何狠砸 200 億美元收購 Groq】

『LPU 專為大語言模型推論設計,具備極速、低延遲與高能效特點。勝過 TPU 的關鍵優勢在於捨棄外部 HBM,改用整合式靜態記憶體,消弭數據傳輸瓶頸。』

Nvidia 已經衝到讓其他對手完全看不到它的尾燈了。

Nvidia nie bierze jeńców. Wydaje 20 mld dolarów na „mózgi” Groq w największej transakcji w swojej historii

Mieli być „pogromcą Nvidii”, oferując szybsze i tańsze chipy do AI. Zamiast tego, ich szefowie i technologia właśnie trafili pod skrzydła Jensena Huanga.

Nvidia cementuje swoją pozycję monopolisty, wydając rekordowe 20 miliardów dolarów w kontrowersyjnym modelu „acquihire”.

Groq był gwiazdą startupów AI. Ich procesory LPU (Language Processing Units) obiecywały to, czego GPU Nvidii nie potrafiły: błyskawiczne generowanie odpowiedzi (inference) przy ułamku kosztów energii. Firma budowała nawet własne centra danych w Europie i otwarcie oskarżała Nvidię o praktyki monopolistyczne. Cóż, jak mówi stare porzekadło: jeśli nie możesz ich pokonać, kup ich.

Najdroższe „CV” w historii

Według doniesień Tom’s Hardware, transakcja jest majstersztykiem prawnym, mającym na celu ominięcie urzędów antymonopolowych. Nvidia nie kupuje firmy Groq (co zablokowałaby Federalna Komisja Handlu). Zamiast tego:

- Płaci 20 miliardów dolarów za niewyłączną licencję na własność intelektualną Groq.

- Zatrudnia kluczowych pracowników, w tym założyciela i CEO Jonathana Rossa (twórcę układów TPU Google’a) oraz prezydenta Sunny’ego Madrę.

To model działania znany jako „acquihire” (przejęcie dla talentów), który w ostatnich latach stosowały Microsoft (z Inflection AI) i Amazon (z Adept).

Co zyskuje Nvidia?

Jensen Huang, CEO Nvidii, powiedział wprost: „Planujemy zintegrować procesory Groq o niskich opóźnieniach z architekturą fabryk AI Nvidii”. Oznacza to, że firma łata swoją jedyną słabość – wydajność w tzw. inference (wnioskowaniu). Nvidia ma najlepsze chipy do uczenia AI, ale Groq miał lepsze do jej obsługi. Teraz Nvidia ma obie te rzeczy.

Groq jako „wydmuszka”?

Formalnie Groq pozostaje niezależną firmą. Nowym CEO zostanie dotychczasowy dyrektor finansowy Simon Edwards, a usługa GroqCloud ma działać bez zmian. Pytanie jednak, czym jest firma technologiczna bez swoich założycieli, kluczowych inżynierów i z technologią, którą właśnie oddała największemu konkurentowi?

Dla rynku to jasny sygnał: w 2026 roku Nvidia zamierza być jedynym liczącym się graczem. A 20 miliardów dolarów to dla nich niska cena za święty spokój.

Koniec eldorado w chmurze. Od 1 stycznia NVIDIA wprowadza sztywne limity w GeForce Now

#AIInference #Groq #JensenHuang #JonathanRoss #LPU #nvidia #przejęcie #rynekChipów #sztucznaInteligencja[Перевод] Архитектура LPU и будущее AI без задержек

Команда AI for Devs подготовила перевод статьи о том, как Groq пытается устранить главное «бутылочное горлышко» современного ИИ — задержку. Их специализированный процессор LPU обещает скорость в реальном времени и открывает путь к новым приложениям: от финансовых систем до Coding AI-ботов. Но за пределами маркетинга остаются вопросы: что с большими контекстами, какова конкуренция с Cerebras и GPU, и выдержит ли бизнес-модель такие вызовы?

starting to get the #locklab back in shape...