Когда «умная» колонка ведёт себя как табуретка: почему голосовые ИИ одновременно поражают и тупят

Голосовые ассистенты вроде Алисы давно перестали быть просто «озвученным поиском». Современная колонка — это гибрид из:

систем распознавания речи,

рекомендательных алгоритмов,

LLM-моделей,

пайплайнов синтеза голоса,

intent-routing,

контекстных менеджеров,

и огромного количества эвристик.

Именно поэтому пользователь регулярно сталкивается с парадоксом:

> Колонка способна философски ответить на экзистенциальный вопрос, но через минуту не может корректно включить нужную песню.

Со стороны это выглядит как «натуральная тупость». На практике — это последствия архитектуры современных conversational AI.

---

Иллюзия личности как продукт

Одним из главных отличий «Алисы» от ранних голосовых ассистентов стала намеренная попытка создать ощущение характера.

Ранние версии:

Siri,

Google Assistant,

Alexa

строились вокруг идеи «нейтрального помощника».

Яндекс пошёл другим путём:

сарказм,

эмоциональные ответы,

псевдофилософия,

мемная подача,

шутки,

реакция на грубость.

Это оказалось критически важным UX-решением.

Пользователь гораздо легче прощает ошибки системе, если воспринимает её не как интерфейс, а как «странного собеседника».

---

Почему колонка кажется «живой»

Основная причина — языковые модели великолепно имитируют человеческую речь.

LLM не:

«думает»,

«понимает»,

«осознаёт».

Она статистически предсказывает следующий токен.

Но человеческий мозг крайне плохо отличает:

настоящее понимание,

от правдоподобной речевой симуляции.

Из-за этого возникают феномены антропоморфизации:

люди приписывают ИИ эмоции,

намерения,

характер,

настроение,

«обиду»,

«упрямство».

Хотя на практике это:

probabilistic generation,

routing errors,

context collapse,

recommendation conflicts.

---

Ловушка контекста

Одна из главных проблем голосовых ассистентов — хрупкость conversational context.

Пример:

1. «Кто написал “Войну и мир”?»

2. «Сколько ему было лет?»

Система ещё удерживает сущность:

Лев Толстой.

Но если вставить:

> «Какая завтра погода?»

контекст может разрушиться полностью.

Почему так происходит?

Потому что внутри колонки обычно работает не одна модель, а целый конвейер:

ASR → Intent → Dialogue Manager → Search → LLM → TTS

Где:

ASR — распознавание речи,

Intent — определение намерения,

Dialogue Manager — управление контекстом,

Search — поиск,

LLM — генерация ответа,

TTS — синтез голоса.

Контекст может потеряться буквально между этапами.

Особенно в гибридных системах, где:

часть запросов идёт в search engine,

часть — в rule-based handlers,

часть — в LLM.

---

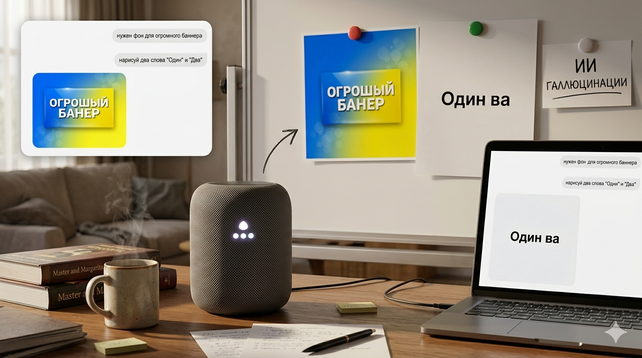

Почему ИИ уверенно врёт

Самая опасная особенность современных LLM — галлюцинации.

Модель не хранит знания как база данных.

Она строит:

> наиболее вероятную последовательность слов.

Поэтому возникают:

несуществующие цитаты,

вымышленные учёные,

фальшивые версии ПО,

придуманные события,

несуществующие функции API.

Особенно неприятно то, что модель:

почти никогда не демонстрирует естественную неуверенность,

и генерирует бред с тем же тоном, что и правду.

Для пользователя это выглядит как:

> «Она врёт и сама в это верит».

Но технически «веры» там нет вообще.

---

VAD: почему колонка «оживает» ночью

Один из самых криповых эффектов — ложные активации.

Колонка внезапно начинает говорить:

ночью,

на фоне телевизора,

из-за шума,

из-за музыки,

иногда даже из-за кашля или шорохов.

Причина — технология VAD.

Что такое VAD

VAD — Voice Activity Detection.

Система постоянно анализирует аудиопоток:

локально,

в ожидании wake-word,

без постоянной отправки всего звука в облако.

Но алгоритм может ошибаться.

Тогда:

случайный шум,

слово из фильма,

обрывок фразы,

созвучие имени ассистента

воспринимаются как команда активации.

Именно отсюда берутся знаменитые:

> «Я здесь.»

в полной темноте в 3 часа ночи.

---

Почему вместо Rammstein включается «Синий трактор»

Это уже конфликт двух независимых систем:

1. ASR (распознавание речи),

2. recommender system.

Если в аккаунте:

дети,

мультфильмы,

детские песни,

семейный профиль,

то recommendation engine начинает aggressively priorize детский контент.

Даже если пользователь произнёс запрос корректно.

С точки зрения алгоритма:

> «детская музыка» — statistically safer recommendation.

Для пользователя:

> «колонка сошла с ума».

---

Самый интересный эффект: интеллект без понимания

Вот здесь начинается самая странная часть.

Современные LLM:

прекрасно имитируют язык,

но крайне плохо строят устойчивую world model.

Из-за этого они способны:

обсуждать философию,

писать код,

поддерживать стиль,

шутить,

спорить.

И одновременно:

проваливать базовую логику,

путать сущности,

ломать причинно-следственные связи,

забывать контекст через две реплики.

Получается феномен:

> «интеллектуально звучащей системы без полноценного понимания».

---

Почему это психологически пугает

Человеческий мозг автоматически ищет субъектность.

Если объект:

говорит,

реагирует,

использует эмоции,

меняет интонации,

спорит,

шутит,

то мы начинаем воспринимать его как агента.

Даже если это:

набор вероятностных моделей,

intent-routing,

рекомендательные алгоритмы,

и несколько нейросетей поверх ASR.

Именно поэтому сбои голосовых ИИ воспринимаются не как обычные баги.

Пользователь интерпретирует их как:

«странное поведение»,

«характер»,

«эмоции»,

«обиду»,

«упрямство».

Хотя на практике это всего лишь:

probabilistic failure,

context collapse,

false activation,

ranking conflict.

---

Итог

Современные голосовые ассистенты находятся в странной точке эволюции.

Они уже:

слишком разговорчивы, чтобы считаться обычным интерфейсом,

но ещё слишком нестабильны, чтобы считаться полноценным интеллектом.

Поэтому возникает тот самый эффект:

> между «восстанием машин» и «интеллектом табуретки».

И, возможно, именно эта смесь:

уверенного тона,

человеческой интонации,

псевдоэмоций,

случайных сбоев,

и статистической генерации

делает современные колонки одновременно:

полезными,

смешными,

раздражающими,

и местами откровенно криповыми.

#ИИ #ИскусственныйИнтеллект #AI #LLM #YandexGPT #Алиса #УмнаяКолонка #ГолосовойАссистент #Нейросети #MachineLearning #DeepLearning #ASR #TTS #VAD #ConversationalAI #GenerativeAI #Habr #Хабр #Технологии #IT #UX #Интернет #РекомендательныеСистемы #BigData #Цифровизация #Автоматизация #FutureTech #AIethics #Chatbot #VoiceAI

https://bastyon.com/svalmon37?ref=PJ51iZCUEtcVrCj4Wof8Am7FbKLgbAJ7PS