Mulight 沐光 (@0xMulight)

Gemini의 tool-calling 기능을 2,600만 파라미터의 소형 모델로 증류한 Needle이 공개됐다. GPU 없이 로컬에서 매우 낮은 지연으로 동작하며, 엣지 디바이스나 브라우저에서 함수 호출 기능을 구현하는 데 적합하다.

Mulight 沐光 (@0xMulight)

Gemini의 tool-calling 기능을 2,600만 파라미터의 소형 모델로 증류한 Needle이 공개됐다. GPU 없이 로컬에서 매우 낮은 지연으로 동작하며, 엣지 디바이스나 브라우저에서 함수 호출 기능을 구현하는 데 적합하다.

Design Arena (@Designarena)

Design Arena의 370만+ 사용자 기반에서 생성된 슬라이드 작업을 바탕으로 한 랭킹 서비스와, 오픈소스 agent harness를 수정해 이미지 생성 등 도구 호출을 지원하는 평가/실행 인프라를 소개합니다. 슬라이드 생성 에이전트 평가 파이프라인에 관심 있는 개발자에게 실용적인 참고 사례입니다.

@AnthropicAI @Zai_org Slide Arena is powered by 3.7M+ users on Design Arena, creating slides for real-world use cases Check out the leaderboard live at https://t.co/9QNkOYQRqN The harness is a modified version of our open-source agent harness, with access to tool calls like generate_image,

stevibe (@stevibe)

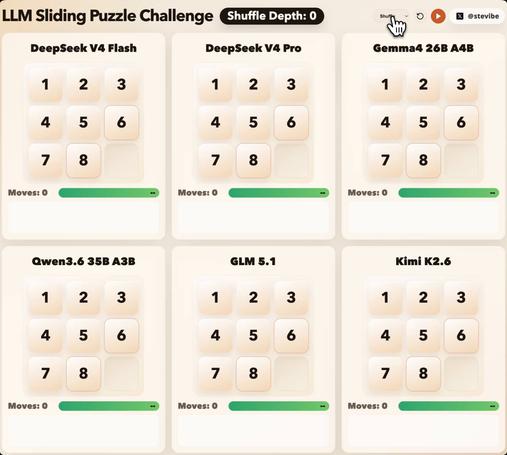

여러 오픈소스 LLM에 슬라이딩 퍼즐과 도구 호출 과제를 주고 장기 추론 능력을 비교한 테스트입니다. 6개 모델 중 5개가 실패했고 1개만 성공했다는 점에서, 단순 벤치마크보다 실제 추론·툴 사용 능력을 드러내는 흥미로운 평가 사례입니다.

Six open-source LLMs. One sliding puzzle. A brutal test of long-horizon reasoning and tool calling. Five of them broke. One didn't. I gave each model a move_tile tool and a scrambled 3×3 board, then asked it to solve the puzzle through pure turn-by-turn reasoning. The deeper

GPT-Realtime-2: tool calling en paralelo y 128K contexto

¿Cuánto mejoró el tool calling en GPT-Realtime-2? 66.5% en benchmark, 128K contexto y llamadas paralelas. Probalo paso a paso con Pruebas GPT-Realtime-2...

https://blog.donweb.com/pruebas-gpt-realtime-2-herramientas-tool-calling/

#gptrealtime2 #openai #toolcalling #agentesdevoz #realtimeapi

From the .NET blog...

In case you missed it earlier...

Microsoft Agent Framework – Building Blocks for AI Part 3

https://devblogs.microsoft.com/dotnet/microsoft-agent-framework-building-blocks-for-ai-part-3/ #dotnet #AI #csharp #AIagents #MicrosoftAgentFramework #multiagent #ToolCalling #workflows

Python Trending (@pythontrending)

Apple Silicon용 로컬 AI 엔진 Rapid-MLX가 소개됐다. Ollama보다 4.2배 빠르고, 캐시된 TTFT 0.08초, 100% tool calling을 지원하며, 도구 파서·프롬프트 캐시·reasoning separation·클라우드 라우팅 등 고급 기능을 제공하는 것이 특징이다.

From the .NET blog...

Microsoft Agent Framework – Building Blocks for AI Part 3

https://devblogs.microsoft.com/dotnet/microsoft-agent-framework-building-blocks-for-ai-part-3/ #dotnet #AI #csharp #AIagents #MicrosoftAgentFramework #multiagent #ToolCalling #workflows

Sudo su (@sudoingX)

같은 로컬 모델을 OpenClaw와 Hermes Agent에 적용해 비교한 결과, OpenClaw는 도구 호출이 불안정했지만 Hermes는 안정적으로 에이전트 루프를 수행했다. 문제의 핵심은 모델보다 프레임워크가 컨텍스트 예산을 과도하게 소모하는 데 있다는 점을 강조한다.

i have been saying this for months. ran the same local model through openclaw and hermes agent back to back, openclaw could not reliably call a tool, hermes ran clean agentic loops. it is not the model that is broken, it is the framework eating half the context budget on its