Mulight 沐光 (@0xMulight)

Gemini의 tool-calling 기능을 2,600만 파라미터의 소형 모델로 증류한 Needle이 공개됐다. GPU 없이 로컬에서 매우 낮은 지연으로 동작하며, 엣지 디바이스나 브라우저에서 함수 호출 기능을 구현하는 데 적합하다.

Mulight 沐光 (@0xMulight)

Gemini의 tool-calling 기능을 2,600만 파라미터의 소형 모델로 증류한 Needle이 공개됐다. GPU 없이 로컬에서 매우 낮은 지연으로 동작하며, 엣지 디바이스나 브라우저에서 함수 호출 기능을 구현하는 데 적합하다.

Github Awesome (@GithubAwesome)

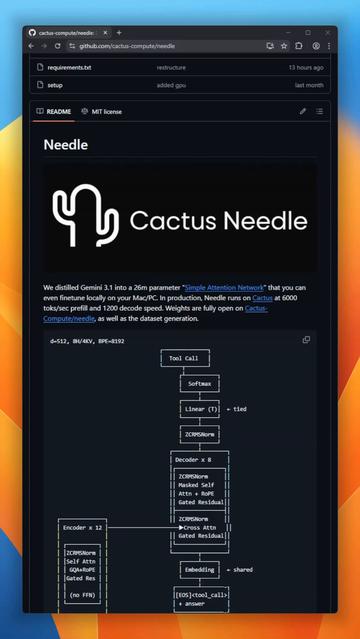

Cactus Compute의 Needle은 2,600만 파라미터 규모의 소형 언어모델로, 마이크로컨트롤러나 Raspberry Pi Zero 같은 초소형 임베디드 기기에서도 동작할 수 있도록 설계됐다. 저사양 하드웨어에서 함수 호출을 지원하는 점이 주목된다.

Every "small" language model that does function calling still wants gigabytes of RAM and a real GPU. Needle by Cactus Compute is 26 million parameters, small enough to run on a microcontroller, a Raspberry Pi Zero, or any embedded device you've got lying around. Built

Tool Calls en Claude: el costo que no ves venir

Cuánto cuestan realmente las tool calls en Claude API en 2026, qué es Tool Search, cómo Programmatic Tool Calling ahorra 37% de tokens y por qué explota...

https://blog.donweb.com/costos-herramientas-claude-api-tool-use/

Ботинок — консольный AI-агент для тех, у кого мало VRAM

Эта статья — не туториал и не обзор. Это история о том, как я искал инструмент для своих задач, не нашёл, расстроился, а потом успокоился и написал свой. Речь пойдёт о Ботинке — консольном AI-агенте для работы по SSH. Но сначала немного контекста. Я работаю с Linux-серверами уже лет пятнадцать. За это время видел разные эпохи: когда всё настраивали руками, когда появился Ansible, когда все бросились в Kubernetes, когда устали от Kubernetes и вернулись к простым docker-compose. Скрипты-костыли множились, документация устаревала, а сервера как требовали внимания, так и требуют. И вот теперь добавился ещё один слой — LLM. Можно спросить у модели, как настроить nginx, и получить рабочий конфиг. Можно попросить проанализировать логи. Но каждый раз копировать-вставлять между терминалом и чатом — это отдельный вид боли. Хочется, чтобы модель жила прямо в консоли, понимала контекст сервера и могла сама выполнить рутину. Статья будет полезна тем, кто: Работает с серверами по SSH и устал от рутины Интересуется AI-агентами, но хочет что-то лёгкое и локальное Имеет ограниченные ресурсы (не у всех есть 24GB VRAM) Хочет понять, как строится архитектура агента с инструментами Зачем ещё один AI-агент? Ситуация знакомая: есть задачи, которые хочется поручить AI — проанализировать логи, написать код, найти информацию в интернете. Но мне нужен был именно консольный агент — работаю в терминале, хожу по серверам по SSH, не хочу отвлекаться на GUI. На волне хайпа попробовал OpenClaw — хайповый проект 2025-2026 года, self-hosted AI-агент для автоматизации жизненных задач. Идея в целом норм: агент работает 24/7, отвечает в Telegram/WhatsApp, умеет чистить почту, управлять календарём, чекиниться на рейсы. Четырёхслойная архитектура, куча интеграций, активное сообщество. Но на практике для моих задач оказалось слишком тяжело : Оверсложнённая архитектура — Gateway, Integration, Execution, Intelligence — это отлично для энтерпрайза, но перебор для «зайти на сервер и поправить конфиг» Ориентация на lifestyle-автоматизацию — почта, календарь, бронирования. А мне нужно: логи, systemd, docker, nginx Постоянно висящий сервис — 24/7 демон, который кушает ресурсы. А я хочу: запустил — поработал — закрыл Мессенджер как интерфейс — удобно для личного ассистента, но для админской работы нужен терминал и SSH OpenClaw крут для своей ниши — персональный ассистент в Telegram. Но моя задача другая: консольный агент для системного администрирования . Зайти по SSH, диагностировать проблему, поправить, уйти. Без демонов, без мессенджеров, без оверхеда. Так родился Ботинок. Ключевая идея: не сервис, а инструмент Здесь важно остановиться на главном. Ботинок — это не фоновый сервис и не постоянно висящая служба. Это обычное приложение: запустил, поработал, закрыл. Никаких веб-серверов, демонов, системных служб. Идея пришла из наблюдения за тем, как работают разработчики с Cursor, Windsurf и подобными IDE . Там ты открыв Читать полностью

https://habr.com/ru/articles/1015126/

#ollama #aiagent #python #llm #functioncalling #консоль #terminal

Manus元リードが語る「function callingをやめた理由」— 2年のエージェント開発から得た実践知見

https://qiita.com/nogataka/items/9924c97a74f63c5452eb?utm_campaign=popular_items&utm_medium=feed&utm_source=popular_items

dominik kundel (@dkundel)

Responses API의 출시 기념(생일) 트윗으로, 사용자가 이 API의 기능을 더 많이 발견했다는 축하와 함께 주요 진화사항을 소개합니다. 지금은 에이전트화된 API로 멀티모달 입력(텍스트·이미지·파일), 함수 호출(function calling) 등을 지원한다고 명시되어 있어 개발자용 인터페이스와 기능 확장 측면에서 중요한 업데이트입니다.

Happy birthday to the Responses API! 🎉 Excited that more people have found the power of this API. Since launching the capabilities have just continued to accumulate and it's now a truly agentic API with: - Multimodal inputs with text + image + file inputs - Function calling

Я сделал Telegram-бота, который собирает корзину в ВкусВилл по одному сообщению. Вот как это работает

Каждую неделю я трачу 15-20 минут на заказ продуктов во «ВкусВилл». Сценарий обычно один и тот же: открыть каталог, найти молоко среди 15 похожих карточек, добавить, искать хлеб, сомневаться между бородинским и чиабаттой, снова добавить, потом сыр, потом что-то к чаю. К пятой позиции я уже не уверен, кто тут клиент: я или бесконечная лента товаров. В какой-то момент поймал себя на мысли: я трачу больше времени на поиск гречки, чем гречка потом варится. По данным Platforma (2021), россияне в среднем проводят от 19 до 49 минут в месяц на выбор продуктов онлайн с мобильного (жители Москвы — в 2,5 раза больше). При этом 65% покупателей называют экономию времени главной причиной онлайн-покупки продуктов (РБК, 2022) - данные несколько устаревшие, но все же. Парадокс понятный: мы идём в онлайн, чтобы сэкономить время, и там же это время сливаем в рутину. Я решил проверить простую гипотезу: если человек обычно заказывает одно и то же, можно ли собрать корзину по одной фразе вроде: > «Собери завтрак на двоих» Спойлер: можно. Я сделал Telegram-бота, который понимает обычный язык, сам ищет товары в каталоге «ВкусВилл» и отдаёт готовую ссылку на корзину. > Дисклеймер: это личный open-source проект. Я не связан с компаниями ВкусВилл или Яндекс. Бот использует публичный API ВкусВилл и Yandex Cloud AI Studio на общих условиях. Код доступен на GitHub под лицензией Apache 2.0. Кому будет полезно: разработчикам, которые думают о ботах с ИИ; тем, кто хочет разобраться в function calling или MCP; и всем, кому интересно, как LLM может автоматизировать рутину. Как «угнать за 60 секунд» завтрак

https://habr.com/ru/articles/1000734/

#mcp #telegrambot #python #aiogram #functioncalling #owen #вкусвилл

Каждую неделю я трачу 15-20 минут на заказ продуктов во «ВкусВилл». Сценарий обычно один и тот же: открыть каталог, найти молоко среди 15 похожих карточек, добавить, искать хлеб, сомневаться между...

Anthropic just rolled out Claude Code at $200/month, while the new Claude 4 version climbs to the top of Berkeley’s tool‑calling leaderboard, beating open‑source rivals. Find out how Claude 4’s function‑calling shines and why Goose stays free. #Claude4 #FunctionCalling #BerkeleyLeaderboard #LLMBenchmarking

🔗 https://aidailypost.com/news/claude-code-usd-200mo-goose-free-claude-4-tops-berkeley-toolcalling

Avi Chawla (@_avichawla)

Function Calling과 MCP가 LLM의 도구 접근 방식에서 어떻게 다른지 시각적으로 설명합니다. 과거 AI 워크플로는 전통적 Function Calling에 의존했으나, 현재는 에이전트/LLM용 도구 접근을 표준화하는 MCP가 보편화되었고, 해당 시각 자료는 Function Calling과 MCP가 내부적으로 어떻게 작동하는지 비교해 이해하기 쉽게 정리해 줍니다.

Function calling & MCP for LLMs, explained visually! Before MCPs became popular, AI workflows relied on traditional Function Calling for tool access. Now, MCP is standardizing it for Agents/LLMs. The visual below explains how Function Calling and MCP work under the hood.