#sir #lancelot #sirlancelot #qwq #oldtimes #missyoumycutecat #cat #kitty #kittycat #cats #cats_of_instagram #catfish #catslover #cat_of_the_day #cat_today #cute_cat #hello_kitty #cat_lovers #beautiful_cat #glorius_kitty #catscatscats #catsofWorld #catloversclub #catsoftheworld #cats_of_day #catlifestyle #catsgram #catlife #cats_today

#sir #lancelot #sirlancelot #qwq #oldtimes #missyoumycutecat #cat #kitty #kittycat #cats #cats_of_instagram #catfish #catslover #cat_of_the_day #cat_today #cute_cat #hello_kitty #cat_lovers #beautiful_cat #glorius_kitty #catscatscats #catsofWorld #catloversclub #catsoftheworld #cats_of_day #catlifestyle #catsgram #catlife #cats_today

Запустил llama.cpp на другой материнке с процессором AMD E2-3000. Это хоть и аналог Intel Atom, но посовременнее.

Разбор промпта и генерация ответа стали чуть-чуть быстрее. На 10 процентов примерно. Хотя память DDR3 работает на шине 1600МГц и быстрее в 1,5 раза, чем предыдущая DDR2 на 1066МГц шине. Зато процессор был на 2,6ГГц. А у этого всего лишь 1,6ГГц.

Перекомпилировал llama.cpp на этом процессоре, и скорость прям удвоилась.

Vikhr-Llama-3.2-1B-Q8_0 выдаёт 2 токена в секунду.

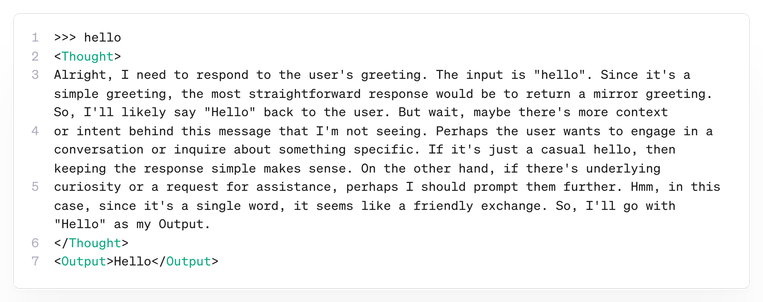

А QwQ-500M.Q8_0 выдаёт 6 токенов в секунду и прям так бодренько пишет ответ. Правда, моделька глупенькая, склонна рассуждать и редко правильно отвечает.

Как я понял, это всё из-за поддержки процессором AVX1 и FP16C. А скорость оперативной памяти, к сожалению, тут почти не играет роли.

На START, внимание, марш: как победить галлюцинации и научить LLM точным вычислениям

START — опенсорсная LLM для точных вычислений и проверки кода. В START решены две главные проблемы большинства обычных моделей: галлюцинации и ошибки в многоэтапных расчетах. В статье разберемся, зачем и как именно эти проблемы решены.

https://habr.com/ru/companies/postgrespro/articles/913490/

#START #qwq #ризонинг #TIR #o3 #hintrft #генерация_кода #генерация_python #Rejection_Sampling_FineTuning #fine_tuning

I've done some #vibehosting yesterday... I couldn't be bothered investigating why #fail2ban keeps banning my IP after fetching emails from my email server, so I've decided to delegate my issues to #ollama.

I've set a knowledge base with all the necessary config and log files, etc, and asked #QwQ to investigate... Since it's a #localLLM, I had no issues submitting even the most sensitive information to it.

QwQ did come up with tailored suggestions on how to fix the problem. #openwebui

https://heise.de/-10308461 #künstlicheIntelligenz

Alibaba’s New QwQ-32B AI Model Challenges OpenAI and DeepSeek as an Affordable and Efficient Alternative

#AI AIModels #ALibaba #Qwen #QwQ #QwQ32B #GenAI #MultimodalAI #OpenSourceAI #AICompetition #AlibabaAI

When our backup #pump failed on the #Oregon #homestead, I built a #calculator to figure out what we really needed. It’s a small, #opensource tool born from necessity and a few iterations with #SelfHosted #ai

https://sij.law/thinking-like-a-developer-pt-1/

#python #code #devops #Oregon #water #ollama #qwq #selfhosting #aiml

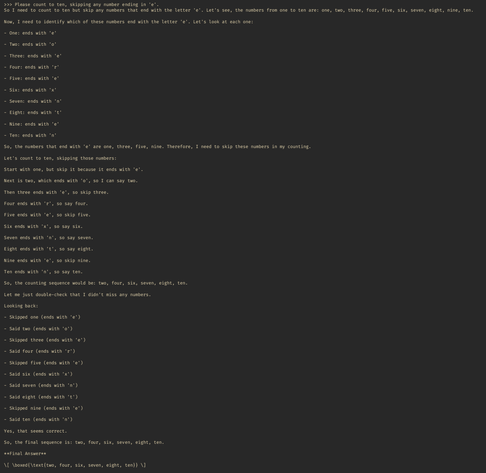

Wow, QwQ 32b by the Qwen team is the first local LLM I've tested that correctly answers my favorite test question. Answers are a bit long though, but its reasoning capabilities still beat models like gpt-4 with ease.

"Please count to ten, skipping any number ending in 'e'."

#ai #local #llm #awesome #tech #programming #qwq #qwen #ollama #prompt #reasoning