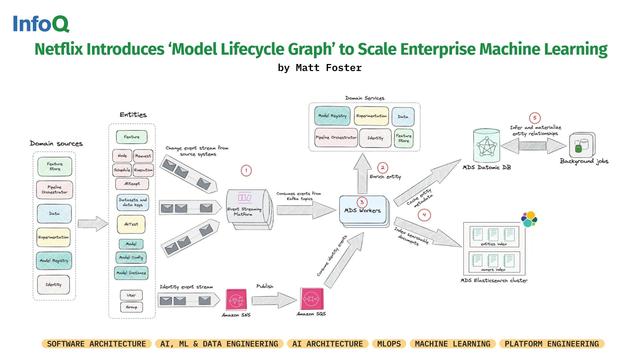

AI systems are no longer just models.

Models can propose.

Systems must verify.

#AI #AISecurity #AIGovernance #AgenticAI #RuntimeVerification #AISecurity #CyberSecurity #SoftwareEngineering #MachineLearning #MLOps #LLMOps #RiskManagement

AI: AI Systems Are No Longer Just Models, and Runtime Verification Is Becoming the New Security Boundary

AI systems are increasingly being discussed as if the model were the system. That was never entirely true, but it is becoming dangerously misleading. Moreover, modern AI applications are not simply…