Visualizing LLM embeddings on a sphere

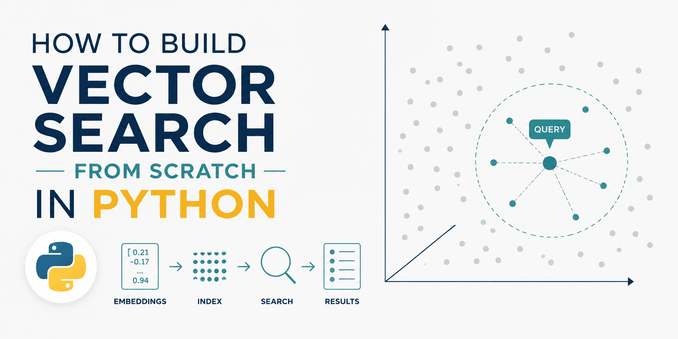

이 프로젝트는 OpenAI의 text-embedding-3-small 모델로 생성한 1002개 단어 임베딩을 PCA와 UMAP을 이용해 3차원 구면 좌표로 축소하고, React Three Fiber를 활용해 인터랙티브 3D 시각화를 제공합니다. UMAP의 haversine 메트릭을 사용해 임베딩을 구면(S²) 위에 직접 매핑함으로써 평면 3D 공간에서 발생하는 클러스터링 왜곡을 방지합니다. 프론트엔드와 백엔드가 분리되어 있어 API 키 없이도 즉시 시각화 가능하며, Python 스크립트로 임베딩 재생성 및 좌표 재계산도 지원합니다. AI 개발자가 LLM 임베딩의 공간적 관계를 직관적으로 이해하고 분석하는 데 유용한 도구입니다.