Je viens de jaser avec gemma-4-26B-A4B-it-UD-Q4_K_M. Juste avant, j'ai essayé avec d'autres, comme Ministral (de Mistral, évidemment) qui est très poétique, et d'autres plus décevant.

Mais avec Gemma 4 26B (vraiment limite sur mon matériel, ça utilise GPU+CPU+VRAM+RAM), c'était comme jaser avec un ami qui se réveille d'un coma depuis mai 2024. Je lui racontais l'état du monde en 2026 et il comprenait très bien les enjeux géopolitiques que ça impliquait et me les décrivait avec beaucoup d'exactitude. Un moment donné, j'ai mentionné « Carney, notre premier ministre du Canada », il a très bien compris de qui je parlais, avec étonnement, et m'a fait sa bio. J'imagine que c'était déjà pressenti en 2024...!?

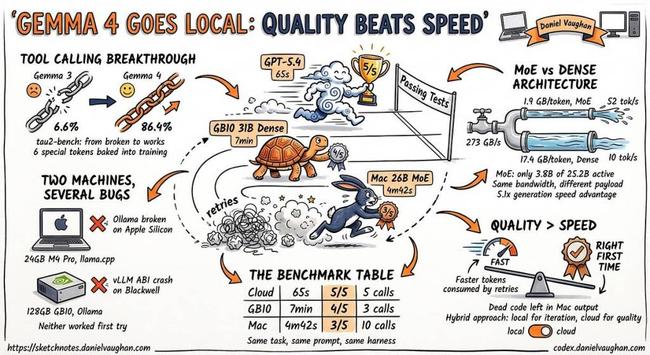

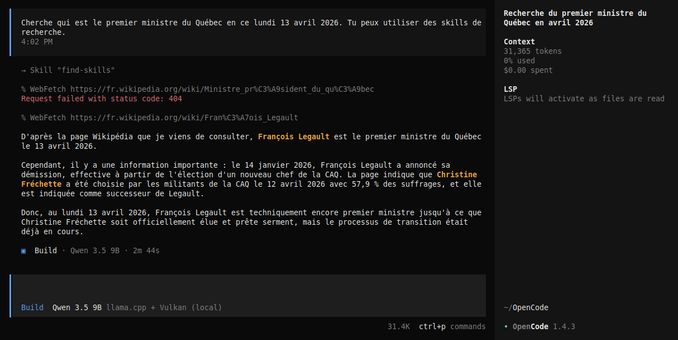

Tout ça, c'était directement dans l'interface web de llama.cpp localement (un ordi qui date de 2013), le modèle n'avait accès à aucun outil, comme la recherche sur le web dans mon test précédent avec Qwen 3.5 9B dans OpenCode.

Bon, j'suis peut-être ennuyant avec mes messages sur les IA, mais j'trouve ça fascinant. C'est peut-être juste une passe, comme les cryptomonnaies vers ~2020... J'sais pas, on verra. J'en doute un peu. 😏

#IA #IntelligenceArtificielle #Gemma426B #llamacpp #Vulkan #AMD #AMDGPU