Huawei Cloud incorpora nova geração da IA DeepSeek no Brasil

Миф о «равных весах»: что на самом деле скрывается внутри малых моделей

Последние годы развитие LLM шло по пути экстенсивного масштабирования: считалось, что чем больше весов и данных, тем умнее модель. В индустрии даже сложилась жесткая классификация по количеству параметров: 7B, 8B, 32B. Она же создает иллюзию, что модели одной весовой категории обладают сопоставимыми аналитическими, генеративными и логическими характеристиками, что в корне противоречит современным эмпирическим наблюдениям. Но действительно ли «вес» модели все еще определяет ее качество в 2026 году? Или компактная архитектура способна конкурировать с гигантами, требующими H100 и сотни гигабайт VRAM? В этой статье мы не будем рассуждать об этом абстрактно: возьмем реальные модели из каталога FMC и посмотрим на практике, как размер влияет на качество reasoning, генерации и прикладную эффективность — и влияет ли вообще.

https://habr.com/ru/companies/selectel/articles/1043278/

#mlops #selectel #llmмодели #qwen #phi4 #mistral #gptoss #deepseek #ai #aiагенты

Миф о «равных весах»: что на самом деле скрывается внутри малых моделей

Последние годы развитие LLM шло по пути экстенсивного масштабирования: считалось, что чем больше весов и данных, тем умнее модель. В индустрии даже сложилась жесткая классификация по количеству параметров: 7B, 8B, 32B. Она же создает иллюзию, что модели одной весовой категории обладают сопоставимыми аналитическими, генеративными и логическими характеристиками, что в корне противоречит современным эмпирическим наблюдениям. Но действительно ли «вес» модели все еще определяет ее качество в 2026 году? Или компактная архитектура способна конкурировать с гигантами, требующими H100 и сотни гигабайт VRAM? В этой статье мы не будем рассуждать об этом абстрактно: возьмем реальные модели из каталога FMC и посмотрим на практике, как размер влияет на качество reasoning, генерации и прикладную эффективность — и влияет ли вообще.

https://habr.com/ru/companies/selectel/articles/1043278/

#mlops #selectel #llmмодели #qwen #phi4 #mistral #gptoss #deepseek #ai #aiагенты

Как и зачем мы сделали собственный OCR-бенчмарк

Однажды нам понадобилось выбрать OCR-модель для RAG-пайплайна. Казалось бы, задача простая: смотришь на лидерборды, берешь лучшую, PROFIT. Но быстро выяснилось, что, во-первых, то, что прекрасно срабатывает на каких-нибудь английских юридических документах, может не потянуть такие штуки как научные формулы, паспортные данные и таблицы на русском языке. А во-вторых, даже если крутой по всем параметрам бенчмарк для оценки качества распознавания говорит, «всё прочитали правильно, я проверил», точность ответов пользователю, который совершает запрос к чат-боту с RAG под капотом, может страдать. Почему так происходит, зачем мы потратили время на сборку собственного OCR-бенчмарка и пожалели ли мы об этом, рассказываю дальше.

https://habr.com/ru/companies/cloud_ru/articles/1043144/

#ocr #rag #LLM #deepseek #glm #markdown #векторный_поиск #data_science #computer_vision

DeepSeek теперь участвует сразу в трёх гонках ИИ. https://webno.ru/novosti-i-stati/deepseek-teper-uchastvuet-srazu-v-tryoh-gonkah-ii/

DeepSeek takes first BIG step to move to commercialize its low cost AI offerings.

This a cannon blast across the bow of OpenAI, Antrpoic, Google and the other guys!

DeepSeek is finalizing its first external fundraising round of ~ US$7.4B at a valuation of ~ US$60B.

Big question - how/when will US VCs try to get in on this action without triggering red flags in outbound investing and/or export control regulations??? https://www.scmp.com/tech/big-tech/article/3355818/deepseek-nears-us7b-haul-first-ever-funding-round-backing-tencent-catl #AI #DeepSeek #LiangWenfeng #China #USA #Investing #FundRaising #VentureCapital #VCs #EquityMarkets #Competition #Valuation #High-FlyerQuant #OpenModels #Commercialization

#DeepSeek #AI #Funding #TechNews

https://meyka.com/blog/deepseek-targets-7-billion-in-first-ever-fundraising-round-sources-say/

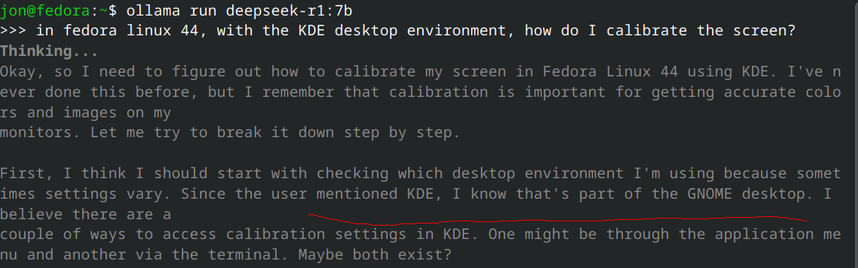

KDE is on gnome apparently.

👉 Ein (1) Tool für alle KI-Modelle! 🤖

Und das aus der sicheren Schweiz!🇨🇭

#MONO ist die #KI Oberfläche für alle KI-Modelle und ermittelt das beste KI-Modell automatisch anhand deiner jeweiligen Anfrage. Oder du wählst es selbst. Wirklich cool!

Kostenloses Probeabo über diesen Link:

https://mono.chat/didi-bachmann

Nutze DIESEN Link für die Anmeldung und erhalte 2 Wochen Gratis-Nutzung. Viel Spass!

#OpenAI #ChatGPT #Claude #Grok #Gemini #Perplexity #Mistral #DeepSeek #NanoBanana #Moonshot #ZAI