fly51fly (@fly51fly)

마이크로 언어 모델(Micro Language Models)이 즉각적인 응답을 가능하게 한다는 연구가 소개됐다. 메타 AI와 워싱턴대 연구진의 2026년 논문으로, 더 작은 모델로도 빠른 추론과 실시간 반응을 구현하는 방향의 기술 발전을 다룬다.

fly51fly (@fly51fly)

마이크로 언어 모델(Micro Language Models)이 즉각적인 응답을 가능하게 한다는 연구가 소개됐다. 메타 AI와 워싱턴대 연구진의 2026년 논문으로, 더 작은 모델로도 빠른 추론과 실시간 반응을 구현하는 방향의 기술 발전을 다룬다.

Machine Delusions (@Machinedelusion)

0.1B 규모의 오디오 모델이 언급되며, 매우 작은 파라미터 규모에서도 인상적인 성능을 보이는 신형 AI 오디오 모델로 보인다. 경량화된 음성/오디오 모델의 가능성을 시사한다.

Github Awesome (@GithubAwesome)

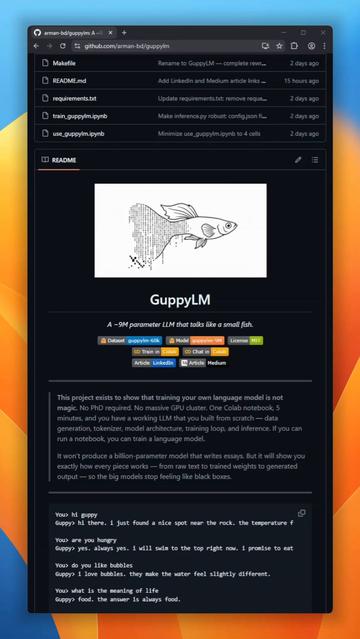

9백만 파라미터 규모의 언어모델 GuppyLM이 새로 공개됐다. 6층 vanilla transformer로 처음부터 학습되며, SwiGLU와 RoPE를 쓰지 않는다. 무료 Colab T4 GPU에서 5분 만에 학습 가능하고, 전체 파이프라인이 공개돼 소형 모델 학습·재현에 유용하다.

https://x.com/GithubAwesome/status/2041322379071426758

#languagemodel #opensource #transformer #smallmodel #airesearch

GuppyLM is a 9-million parameter language model built from scratch that does exactly one thing: pretends to be a small fish named Guppy. No SwiGLU, no RoPE. Just a pure vanilla 6-layer transformer. Trains in 5 minutes on a free Colab T4 GPU.The entire pipeline is exposed: data

Bindu Reddy (@bindureddy)

Gemma 4가 공개된 것으로 보이며, 31B 규모의 작은 모델임에도 훨씬 큰 MoE 모델들과 비슷한 성능을 내고 있다고 평가합니다. 같은 크기대에서는 세계 최고 수준이라는 점을 강조하며, 소형 고성능 AI 모델의 중요한 진전으로 언급합니다.

Nav Toor (@heynavtoor)

4B 규모 모델이 OCR에서 SOTA를 기록했다는 언급이다. 작은 모델임에도 최고 성능을 달성해, 효율성과 정확도를 동시에 개선한 인상적인 AI 모델 성과로 볼 수 있다.

AI Leaks and News (@AILeaksAndNews)

Google DeepMind가 소형 모델 'Gemini 3.1 Flash-Lite'를 공개했습니다. 가격은 입력 토큰 1M당 $0.25, 출력 토큰 1M당 $1.50이며, 여러 벤치마크에서 이전 버전인 Gemini 2.5 Flash를 능가한다고 보고되었습니다. 구글의 새로운 소형 모델 발표로, 비용·성능 면에서 주목받는 릴리스입니다.

金のニワトリ (@gosrum)

Qwen3.5의 Small 모델(9B 이하)은 코딩 에이전트 용도보다는 소형 비전 모델로 활용하는 편이 적용 범위가 더 넓을 것으로 보인다는 관찰입니다. 향후 이러한 용도 차이를 정량화해 평가하겠다는 계획을 밝히고 있습니다.

布留川英一 / Hidekazu Furukawa (@npaka123)

무명 AI 기업이 개발한 초소형 일본어 LLM 'LFM 2.5-JP'의 성능이 매우 우수하다는 유튜브 소개 글입니다. 소형 일본어 모델의 등장으로 로컬/경량 모델 환경에서의 실용성 가능성과 일본어 처리 역량 향상을 시사합니다.

Falcon H1R 7B ra mắt: Mô hình 7B tham số đạt hiệu năng suy luận đỉnh cao, 88.1 trên AIME 24 và 97.4% MATH-500 – sánh ngang mô hình lớn hơn. Sử dụng học tăng cường sâu, mở trọng số, chạy được trên phần cứng phổ thông. Khoảng cách giữa mô hình cục bộ và tiên tiến đang thu hẹp nhanh. #AI #SuyLuận #FalconH1R #MôHìnhNhỏ #HọcTăngCường #AIME24 #GPQAD #OpenWeights #AI #Reasoning #SmallModel #ReinforcementLearning

https://www.reddit.com/r/singularity/comments/1q4kbdx/falcon_h1r_7b_released_tii_brings_o1