DeepReinforce (@deep_reinforce)

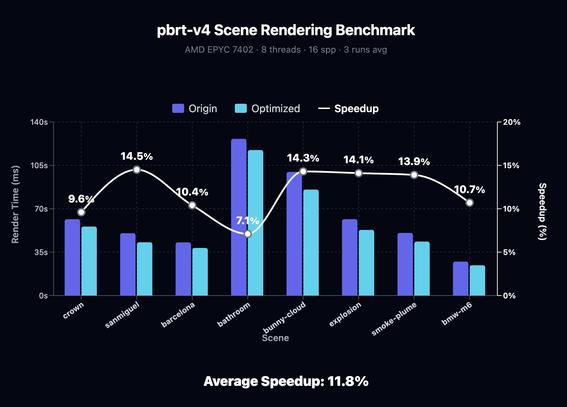

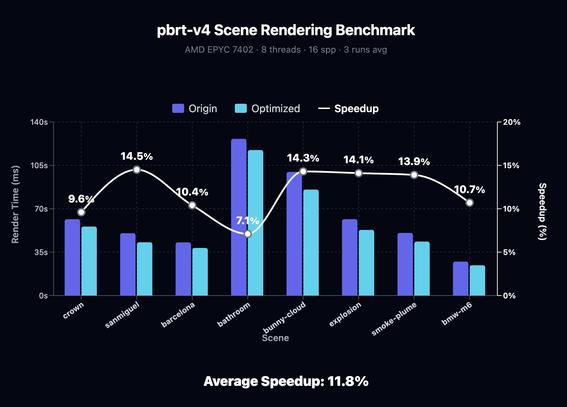

New Use Case Drop: IterX를 사용해 pbrt-v4의 CPU 핫스팟을 최적화했습니다. 광선당 불필요한 작업을 줄여 트래버설, 교차(intersection), 스펙트럼 연산, 볼류메트릭 샘플링 등 물리 기반 렌더링의 핵심 병목을 해결했으며, AMD EPYC 환경에서 성능 향상을 확인한 실사용 최적화 사례를 제시합니다.

https://x.com/deep_reinforce/status/2033658424307945672

#iterx #pbrt #rendering #optimization #raytracing

DeepReinforce (@deep_reinforce) on X

🧑🍳New Use Case Drop!

🧐We used IterX to optimize pbrt-v4’s hottest CPU paths, tackling a core bottleneck in physically based rendering: the cost of doing more work per ray than necessary during traversal, intersection, spectrum math, and volumetric sampling.

🥳On an AMD EPYC

DeepReinforce (@deep_reinforce)

IterX 솔루션의 구현·재현을 위한 레시피와 벤치마크 코드를 deepreinforce-ai의 GitHub 저장소(IterX-tutorials)로 공개했습니다. FlashInfer 벤치 관련 튜토리얼과 실행 방법을 제공하여 연구/재현을 돕는 자료입니다.

https://x.com/deep_reinforce/status/2026849920477741391

#iterx #github #tutorial #flashinfer

DeepReinforce (@deep_reinforce) on X

🧵1/2: Recipe of our solution:

https://t.co/0C5gssybBb

DeepReinforce (@deep_reinforce)

IterX가 MLSys 2026 NVIDIA 트랙의 Fused MoE 설정에서 FlashInfer AI 커널 생성 대회 벤치마크로 H100에서 15.62×, B200에서 14.84× 속도 향상을 달성해 GPT-5.2 Pro와 Claude 4.6 Opus를 크게 앞섰습니다. 참가자 전원에 무제한 크레딧을 제공한다고 공지했습니다.

https://x.com/deep_reinforce/status/2026849608828334337

#iterx #mlsys #fusedmoe #nvidia #flashinfer

DeepReinforce (@deep_reinforce) on X

🥳IterX for MLSys 2026 NVIDIA Track Fused MoE

🧑🍳IterX achieves a 15.62× speedup on H100 and 14.84× on B200, significantly surpassing GPT-5.2 Pro and Claude 4.6 Opus on the Fused MoE setting of FlashInfer AI Kernel generation contest.

🎁We offer unlimited credits for all

Rohan Paul (@rohanpaul_ai)

DeepReinforce가 IterX용 에이전트 통합을 출시하며 자율적 RL(강화학습) 에이전트로 Anthropic의 채용 벤치마크를 능가했다고 주장합니다. 이 통합은 반복적이고 비용이 큰 소프트웨어 동작 보장과 같은 개발의 어려운 부분을 AI 에이전트가 지속적으로 실행·검증하도록 하여 개발 생산성을 크게 향상시킬 가능성을 제시합니다.

https://x.com/rohanpaul_ai/status/2022408488664867327

#deepreinforce #iterx #aiagents #reinforcementlearning #autonomousagents

Rohan Paul (@rohanpaul_ai) on X

AI agents from @deep_reinforce just blow past Anthropic’s hiring benchmarks by running RL autonomously

DeepReinforce launched agent integration for IterX.

Can now do the hardest, most expensive part of coding, making software run perfectly, by letting AI agents relentlessly

DeepReinforce (@deep_reinforce)

IterX의 주요 업그레이드 발표: 에이전트 통합 지원이 추가되어 인프라, CUDA, 스마트 컨트랙트, DB, AI/ML Ops 등 광범위한 코드 최적화를 에이전트(예: claude code, cursor)가 처리하도록 하여 수동 코딩을 줄이고 온보딩을 간소화했습니다.

https://x.com/deep_reinforce/status/2021297645092995134

#iterx #agents #cuda #mlops #ai

DeepReinforce (@deep_reinforce) on X

🚀Major IterX upgrade: Agent integration is now supported!

🔹Optimizing Hardcore Code: SOTA in Infra, CUDA, Smart Contracts, DBs, AI/ML Ops and beyond.

🔹No Manual Code: Agents (claude code, cursor) handle the integration.

Effortless Onboarding!

#CUDA #AI

DeepReinforce (@deep_reinforce)

IterX를 사용해 Anthropic의 take-home 챌린지에서 약 1140 사이클을 달성한 데모를 공유하며, 문제 해결 없이도 해당 성과를 얻었다고 보고하고 피드백을 요청하고 있습니다. 벤치마크 데모와 성능 결과 관련 알림입니다.

https://x.com/deep_reinforce/status/2016613671129272823

#iterx #anthropic #benchmark #demo #ai

DeepReinforce (@deep_reinforce) on X

🥳🥳 Demo on using IterX to achieve ~1140 cycles on Anthropic's take-home challenge without trouble shooting.

😀😀Feedback is deeply appreciated !!

DeepReinforce (@deep_reinforce)

CUDA-L1의 결과는 iterX와 무료 토큰을 사용하면 쉽게 재현할 수 있다는 안내입니다. 실험 재현성과 접근성을 높여주는 도구(또는 워크플로우) 소개로, 연구 결과 검증 및 실습에 유용한 정보입니다.

https://x.com/deep_reinforce/status/2015895161965011299

#cudal1 #iterx #reproducibility #codegeneration

DeepReinforce (@deep_reinforce) on X

Results for CUDA-L1 can be easily replicated using iterX with free tokens.

https://t.co/PzYivqU8nk

DeepReinforce (@deep_reinforce)

iterX의 딥싱킹 모델이 Anthropic의 테이크홈 챌린지에서 사람 지식 없이 1,133 cycles를 달성했다고 보고했습니다. 이 성능은 이전 최고 기록인 Claude 4.5(1,363 cycles)를 능가하며, Anthropic의 채용 기준에 부합할 만큼 강력하다고 주장합니다. 현재 추가 훈련이 진행 중이라고 덧붙였습니다.

https://x.com/deep_reinforce/status/2015579815374704963

#iterx #anthropic #benchmark #claude

DeepReinforce (@deep_reinforce) on X

On Anthropic’s take-home challenge, IterX has achieved 1,133 cycles using its deep thinking model without any human knowledge, outperforming the best Claude 4.5 version (1,363 cycles) , strong enough to be considered hired by Anthropic.

Training is still ongoing, stay tuned.

DeepReinforce (@deep_reinforce)

iterX 팀이 Anthropic의 take-home 과제용으로 코드 공개를 통해 1,158 cycles 성능을 달성했다고 발표했습니다. 이는 동일 과제에서 보고된 Claude 4.5(1,363 cycles) 결과보다 우수하며, Anthropic의 채용 기준을 충족한다고 주장합니다. 코드 공개와 벤치마크 성과를 알리는 공지입니다.

https://x.com/deep_reinforce/status/2015663230644035970

#iterx #anthropic #benchmark #claude

DeepReinforce (@deep_reinforce) on X

We released code that achieves 1,158 cycles using iterX for Anthropic’s take-home challenge, outperforming the best Claude 4.5 result (1,363 cycles). This meets Anthropic’s hiring bar 😀😀

https://t.co/EGfltZIat6

Brain Glitch (@brain_glit82035)

새 출시 알림: IterX 출시를 축하하며, IterX는 자동화된 코드 최적화(automated code optimization)에 대한 흥미로운 접근법으로 보인다는 반응입니다. 트윗에서는 출시 자체를 'Exciting launch!'로 평가하며 개발사 @deep_reinforce에 축하를 전하고 있습니다.

https://x.com/brain_glit82035/status/2013267576537731199

#iterx #deepreinforce #codeoptimization #automatedoptimization

Brain Glitch (@brain_glit82035) on X

Exciting launch! IterX looks like a very interesting approach to automated code optimization. Congrats on the release 🚀 @deep_reinforce