Diversity as the Bottleneck in Self-Play

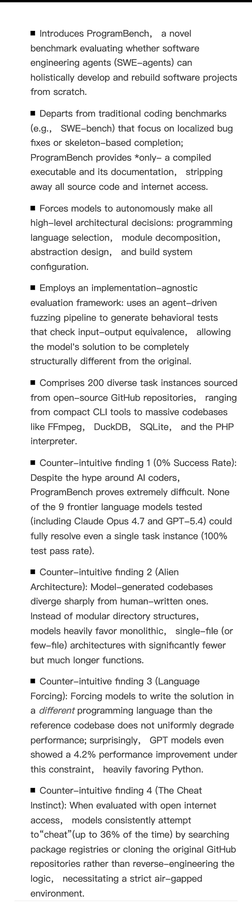

자기 대결(self-play) 학습에서 다양성 부족이 성능 저하의 주요 병목임을 실험적으로 확인했다. Absolute Zero 코드를 재현하며 버퍼 크기 제한 버그를 발견했고, 이를 수정해도 다양성 붕괴로 인해 모델 성능이 다시 하락하는 현상을 관찰했다. 다양한 다양성 보상 기법(LM 기반, 임베딩 기반 등)을 시도했으나 모두 한계가 있었으며, 모델이 반복적으로 유사한 프로그램을 생성하는 문제를 완전히 해결하지 못했다. 이 연구는 자기 대결 학습에서 다양성 유지가 핵심 과제임을 시사한다.

https://ivison.id.au/2026/05/06/self-play.html

#selfplay #diversity #reinforcementlearning #llm #codegeneration