Blog alert!

This time on checking your options when a cloud service goes down. Are you aware of what happens in your cloud?

Blog alert!

This time on checking your options when a cloud service goes down. Are you aware of what happens in your cloud?

This little GLiNet GL-X2000 is set up with a EioT Club Cellular data plan and it saved my butt today. There was an infrastructure related outage with Comcast this afternoon, my system just failed over to the GLiNet router and it kept me going! It's not gaming fast, but it did keep everything alive and reasonably quick! Color me impressed.

Строим шину данных для микросервисов на ZeroMQ: failover, гарантии доставки и E2E-шифрование

Асинхронная клиент-серверная библиотека для обмена сообщениями между микросервисами на базе ZeroMQ. Реализует гарантированную доставку сообщений (At-Least-Once) с персистентной файловой очередью при обрывах связи, автоматический failover сервера переадресации (клиенты могут подхватывать роль сервера на лету) и два уровня защиты: шифрование канала (CurveZMQ) и сквозное шифрование сообщений (HMAC). Лёгкая альтернатива брокерам вроде RabbitMQ, не требующая отдельного сервера.

https://habr.com/ru/articles/1030020/

#python #zeromq #zmq #failover #atleastonce #endtoend_шифрование #микросервисы #распределенные_системы #hmac #криптография

Resiliencia multi-nube: arquitectura celular en AWS y Azure

Resiliencia multi-nube: cómo implementar arquitectura celular event-driven entre AWS y Azure para failover automático en menos de 6 minutos. Guía técnic...

https://donweb.news/resiliencia-multi-nube-arquitectura-celular-event-driven/

Turns out, failover success is subjective. Apparently, being ‘active’ just means you get tested harder. Ever wondered how ‘best intentions’ can invent new incidents? Let’s talk IT wisdom in the replies.

Find out more in Episode 12 : The Failover That Failed Successfully

https://youtube.com/shorts/L3s3K2E4-1I

Listen here : https://ithorrorstories.eu/#ep12

All other things : https://links.ithorrorstories.eu/

#podcasts #failover #drtest #disaster #technology #operationalreadyness #tech

Ever run a failover test that worked perfectly… and still felt like everything was falling apart?

In Episode 12, we take you into a disaster recovery test during a busy release weekend — where the tech held up, but communication didn’t.

Subcontractors weren’t aligned, assumptions didn’t match reality, and suddenly a ‘simple test’ turned into a full coordination puzzle.

No production impact — but plenty of lessons.

Because resilience isn’t just about systems… it’s about people, timing, and actually talking to each other.

Listen now to IT Horror Stories with Jack Smith

You can find us on Spotify, Apple Music, Youtube, Deezer and of course at ITHorrorStories.eu

You are one of us.

For those who run #ProsodyIM as #xmpp server, I did something simple but effective in my failover architecture:

Perfect solution? Of course not.

Effective solution? Hell yeah.

During a busy release weekend, a planned failover exposed not technical flaws, but something more familiar: misaligned teams, unclear responsibilities, and communication that didn’t quite arrive when it should have. Production stayed safe — but confidence took a hit.

This episode dives into how a “simple test” turned into a coordination challenge, and why resilience is just as much about people and processes as it is about systems.

Find all links to listen on our website : https://ithorrorstories.eu/#ep12

#podcast #datarecovery #failover #test #technology

You can find our podcast on :

Spotify : https://open.spotify.com/show/7LqbtykS0IQctSCucvQVHW

Apple Music : https://podcasts.apple.com/us/podcast/it-horror-stories-with-jack-smith/id1812612272

YouTube : https://music.youtube.com/playlist?list=PL9A9yzpnkOdVQvmFjgTsZRrE-zDCuIVcX

Deezer : https://link.deezer.com/s/30dyH3RoKvN8N24zgsbhj

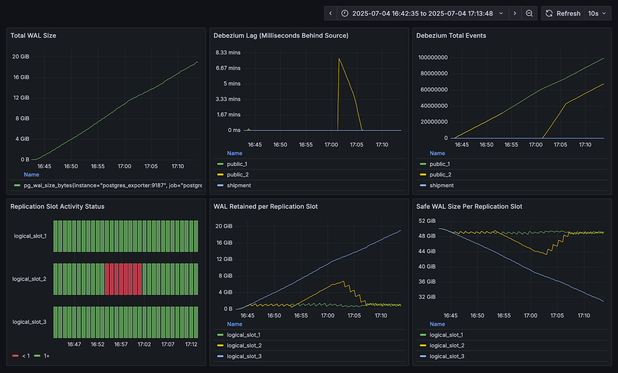

[Перевод] Осваиваем replication slots в Postgres: как предотвратить разрастание WAL и другие проблемы в продакшене

Логическая репликация в Postgres редко ломает прод внезапно — чаще она долго и методично копит проблему, пока replication slot удерживает всё больше WAL, потребитель отстаёт, а свободное место на диске начинает таять. В этой статье разбирается именно такая зона риска: как устроена работа replication slots, почему одних базовых настроек здесь недостаточно и какие практики реально помогают держать под контролем WAL, публикации, heartbeats, failover и мониторинг. Материал особенно полезен тем, кто работает с CDC, Debezium и production-инстансами Postgres, где цена ошибки измеряется уже не теорией, а стабильностью системы. Разбор PostgreSQL

https://habr.com/ru/companies/otus/articles/1018444/

#PostgreSQL #replication_slots #логическая_репликация #WAL #CDC #Debezium #pgoutput #failover #мониторинг_Postgres

Содержание Используйте модуль вывода логического декодирования pgoutput Задайте максимальный размер replication slot Включите Heartbeats Используйте публикации на уровне таблиц Используйте фильтры по...

Мониторинг SQL Server Always On в Zabbix

Если у вас стоит Always On Availability Groups, вы наверняка бывали в такой ситуации: в SSMS всё зелёное, дашборд показывает «Synchronized», а пользователи звонят с жалобами на тормоза. Смотришь на secondary — а там redo_queue_size 600 МБ, реплика отстаёт на полчаса. Ни одного алерта. У нас это случилось на продуктивном кластере с 1С: secondary молча отвалился в SYNCHRONIZING, а мы узнали только при плановом переключении. Полтора часа redo queue. Стало понятно, что встроенный дашборд SSMS — это не мониторинг. Дальше — как мы это закрыли Zabbix'ом за вечер.

https://habr.com/ru/companies/cloud4y/articles/1017578/

#SQL_Server #Always_On #Zabbix #мониторинг #DMV #WSFC #кворум #failover #DBA